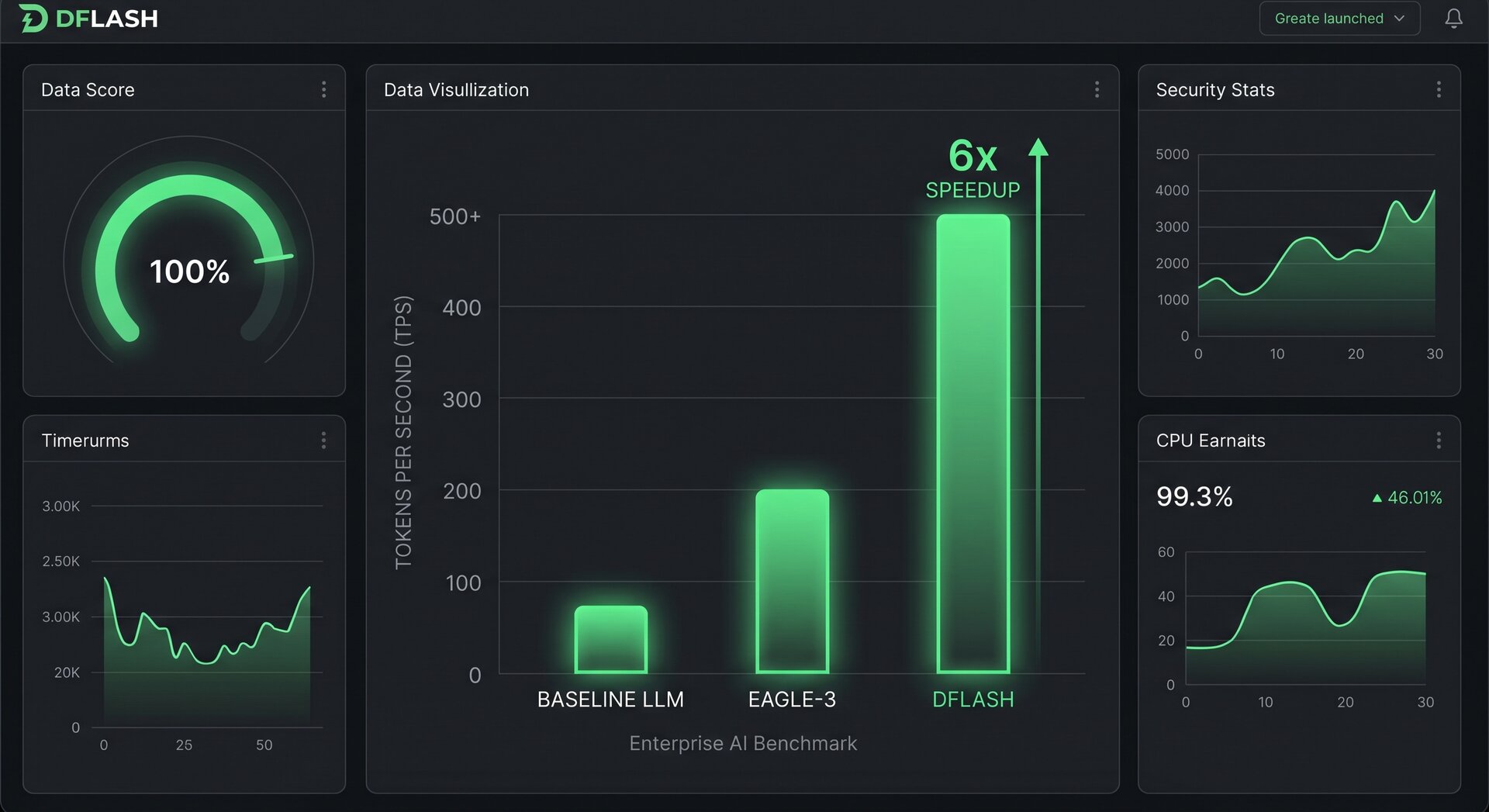

Was wäre, wenn LLM-Inferenz nicht 2–3-mal schneller werden könnte, sondern bis zu 6-mal — ohne jeglichen Qualitätsverlust? Genau das verspricht DFlash, eine neue Methode aus dem Z Lab (veröffentlicht 2026), die Speculative Decoding mit Block-Diffusion kombiniert. In diesem Artikel erklären wir, wie DFlash funktioniert, warum es bestehende Methoden wie EAGLE-3 deutlich übertrifft — und warum wir es für den nächsten großen Sprung in der KI-Inferenz halten.

Was ist DFlash?

DFlash (Block Diffusion for Flash Speculative Decoding) ist eine neue, leichtgewichtige Methode zur drastischen Beschleunigung von Large Language Models. Entwickelt wurde sie von Jian Chen, Yesheng Liang und Zhijian Liu vom Z Lab und in einem arXiv-Paper (2602.06036, 2026) veröffentlicht.

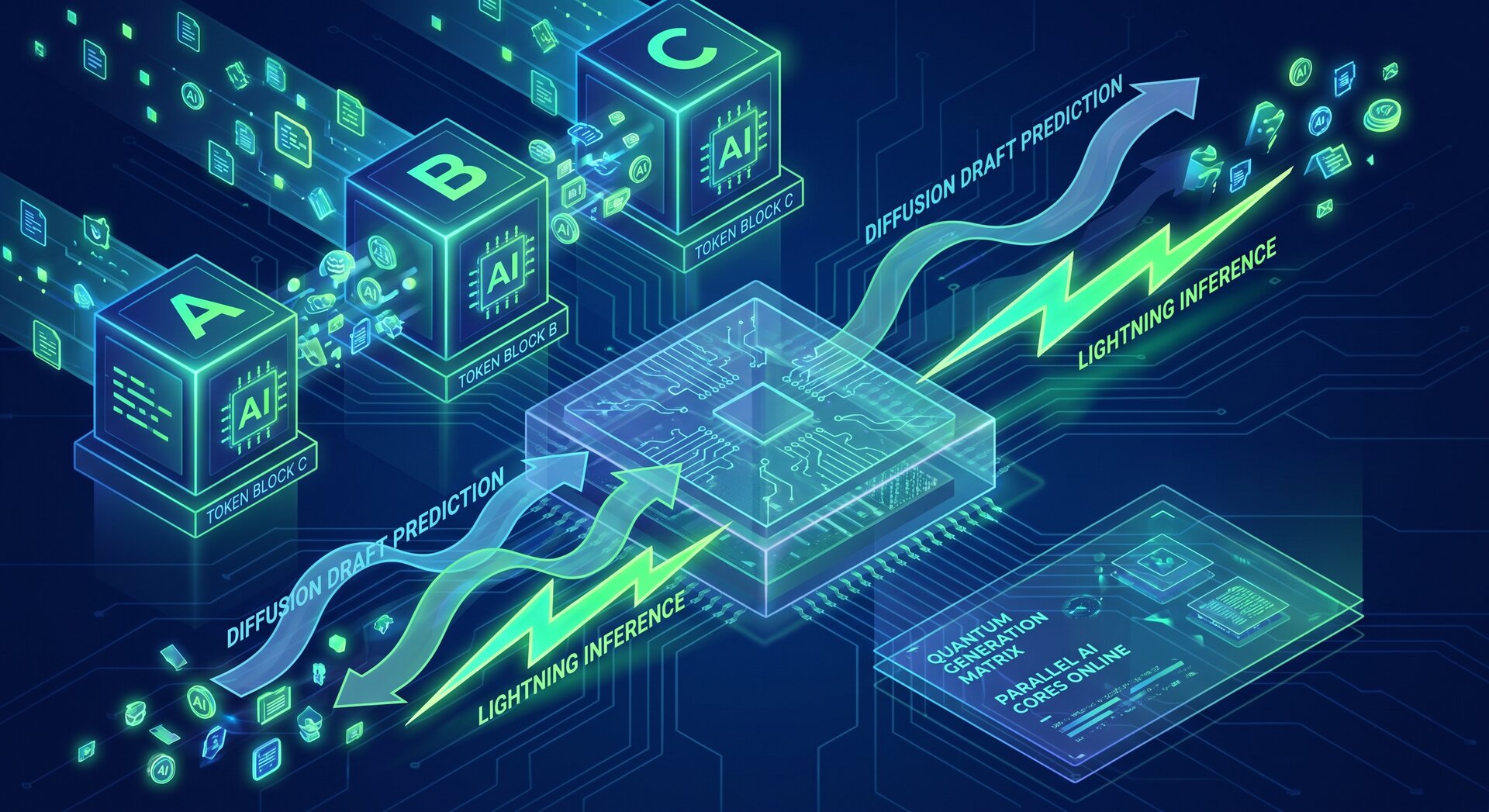

Die Kernidee: Statt Tokens sequenziell Schritt für Schritt zu generieren, entwirft ein kleines Block-Diffusion-Modell einen ganzen Block von Tokens in einem einzigen parallelen Forward-Pass — konditioniert auf die internen Repräsentationen des großen Zielmodells. Das große Modell überprüft den Entwurf dann in einem Schritt und akzeptiert korrekte Tokens. Das Ergebnis: bis zu 6-fache lossless Beschleunigung auf Qwen3-8B — deutlich mehr als jede bisherige Methode.

Das Problem: Warum ist LLM-Inferenz so langsam?

Große Sprachmodelle generieren Text sequenziell: jedes Token hängt vom vorherigen ab. Das ist fundamental und kann durch mehr Hardware allein nicht gelöst werden. Speculative Decoding ist ein bewährter Ansatz, diesen Flaschenhals zu umgehen:

- Ein kleines, schnelles Draft-Modell schlägt mehrere Token vor

- Das große Zielmodell überprüft alle Vorschläge gleichzeitig in einem einzigen Forward-Pass

- Korrekte Tokens werden akzeptiert, falsche verworfen

- Da Verifikation parallel stattfindet, ist der Gesamtdurchsatz höher — bei identischer Ausgabequalität

Der Haken: Bisherige Draft-Modelle wie EAGLE-3 (aktueller State-of-the-Art) generieren ihre Vorschläge immer noch autoregressiv — also ebenfalls Schritt für Schritt. Das begrenzt den praktischen Speedup auf etwa 2–3×. Zudem ist EAGLE-3 auf eine einzige Transformer-Schicht beschränkt, weil mehr Tiefe die Latenz zu sehr erhöhen würde.

Die Lösung: Block-Diffusion als Drafter

DFlash löst dieses Problem elegant: Statt autoregressiv zu arbeiten, nutzt das Draft-Modell Block-Diffusion — ein Verfahren, das einen ganzen Block von Tokens gleichzeitig in einem einzigen Forward-Pass erzeugt. Das hat einen entscheidenden Vorteil:

Die Kosten eines Diffusion-Drafters sind weitgehend konstant, egal wie viele Tokens er produziert. Ein mehrschichtiges DFlash-Modell, das 16 Tokens entwirft, hat niedrigere Latenz als ein einschichtiger EAGLE-3-Drafter, der nur 8 Tokens erzeugt.

Das bedeutet: DFlash kann sich ein tieferes, ausdrucksstärkeres Modell leisten — und liefert damit hochwertigere Vorschläge — ohne den Geschwindigkeitsvorteil zu verlieren.

Wie DFlash technisch funktioniert

1. Feature Fusion: Das Zielmodell weiß es besser

Die entscheidende Erkenntnis hinter DFlash: Die versteckten Repräsentationen (Hidden States) eines großen autogressiven LLMs enthalten bereits implizit Informationen über mehrere zukünftige Tokens. Statt den Drafter also von Grund auf zu fragen, konditioniert DFlash das Draft-Modell auf diese wertvollen Informationen.

Konkret: Nach dem Prefill oder nach jeder Verifikation extrahiert DFlash Hidden Features aus Schichten, die gleichmäßig über das gesamte Zielmodell verteilt sind, und kombiniert sie über eine leichtgewichtige Projektion zu einem kompakten Kontext-Feature-Vektor.

2. KV Injection: Jede Schicht profitiert

Ein kritischer Unterschied zu EAGLE-3: Während EAGLE-3 die Zielmodell-Features nur in die erste Schicht des Draft-Modells einspeist (und das Signal mit zunehmender Tiefe verwässert), injiziert DFlash die fusionierten Features in jede einzelne Schicht des Drafters über den KV-Cache. Das bedeutet: Mit wachsender Modelltiefe wächst auch die Akzeptanzrate — ein Eigenschaft, die EAGLE-3 grundsätzlich fehlt.

3. Paralleles Drafting: Ein Pass für den gesamten Block

Konditioniert auf den reichhaltigen Kontext aus dem Zielmodell, generiert der DFlash-Drafter den nächsten Block von Tokens (typischerweise 15–16 Tokens) in einem einzigen, nicht-kausalen Forward-Pass. Nicht-kausal bedeutet: Jeder Token im Entwurf kann auf alle anderen Tokens im Block achten — das ist konzeptionell anders als bei autogressiven Modellen.

Das Draft-Modell selbst ist leichtgewichtig: Es verwendet die Embedding-Schicht und den LM-Head des Zielmodells — nur die wenigen mittleren Transformer-Schichten werden neu trainiert. Das minimiert den Trainingsaufwand und die Modellgröße.

DFlash vs. EAGLE-3: Die Zahlen sprechen für sich

Alle Benchmarks wurden auf Qwen3-8B mit greedy decoding (Temperatur = 0) durchgeführt:

| Benchmark | Baseline (kein Spec-Dec) | EAGLE-3 Speedup | DFlash Speedup |

|---|---|---|---|

| GSM8K | 1× | 2,13× | 5,20× |

| MATH-500 | 1× | 2,18× | 6,17× |

| AIME 2024 | 1× | 2,25× | 5,91× |

| AIME 2025 | 1× | 2,18× | 5,85× |

| HumanEval | 1× | 2,48× | 5,20× |

| MBPP | 1× | 2,27× | 4,75× |

| LiveCodeBench | 1× | 2,24× | 5,43× |

| MT-Bench | 1× | 1,90× | 2,92× |

DFlash liefert auf nahezu allen Benchmarks mehr als 2,5-mal höheren Speedup als EAGLE-3 — bei mathematischen Reasoning-Tasks sogar über 6×. Und das bei identischer Ausgabequalität, da die Verifikation durch das Zielmodell jeden Token garantiert.

Auch unter Sampling (Temperatur = 1) und mit aktiviertem Thinking-Modus (Reasoning-Modelle) bleibt DFlash stark: circa 4,5-fache Beschleunigung für Reasoning-Modelle wie Qwen3 im Extended-Thinking-Modus.

Welche Modelle unterstützt DFlash?

Z Lab stellt fertige DFlash-Draft-Modelle auf HuggingFace bereit — eine beeindruckend breite Palette:

- Gemma 4 — gemma-4-26B-A4B-it, gemma-4-31B-it (Google)

- Qwen3.6 — 27B und 35B-A3B (MoE, Alibaba)

- Qwen3.5 — 4B, 9B, 27B, 35B-A3B, 122B-A10B

- Qwen3-Coder — Next und 30B-A3B

- Kimi K2.5 (Moonshot AI)

- MiniMax M2.5 (Preview)

- GPT-OSS — 20B und 120B (OpenAI Open-Source-Modelle)

- Llama 3.1 8B (Meta)

- In Kürze: DeepSeek V4 Flash/Pro, MiniMax M2.7

Auch Red Hat AI stellt bereits DFlash-Spekulatoren auf HuggingFace zur Verfügung (u.a. für Gemma 4 31B).

Unterstützte Backends

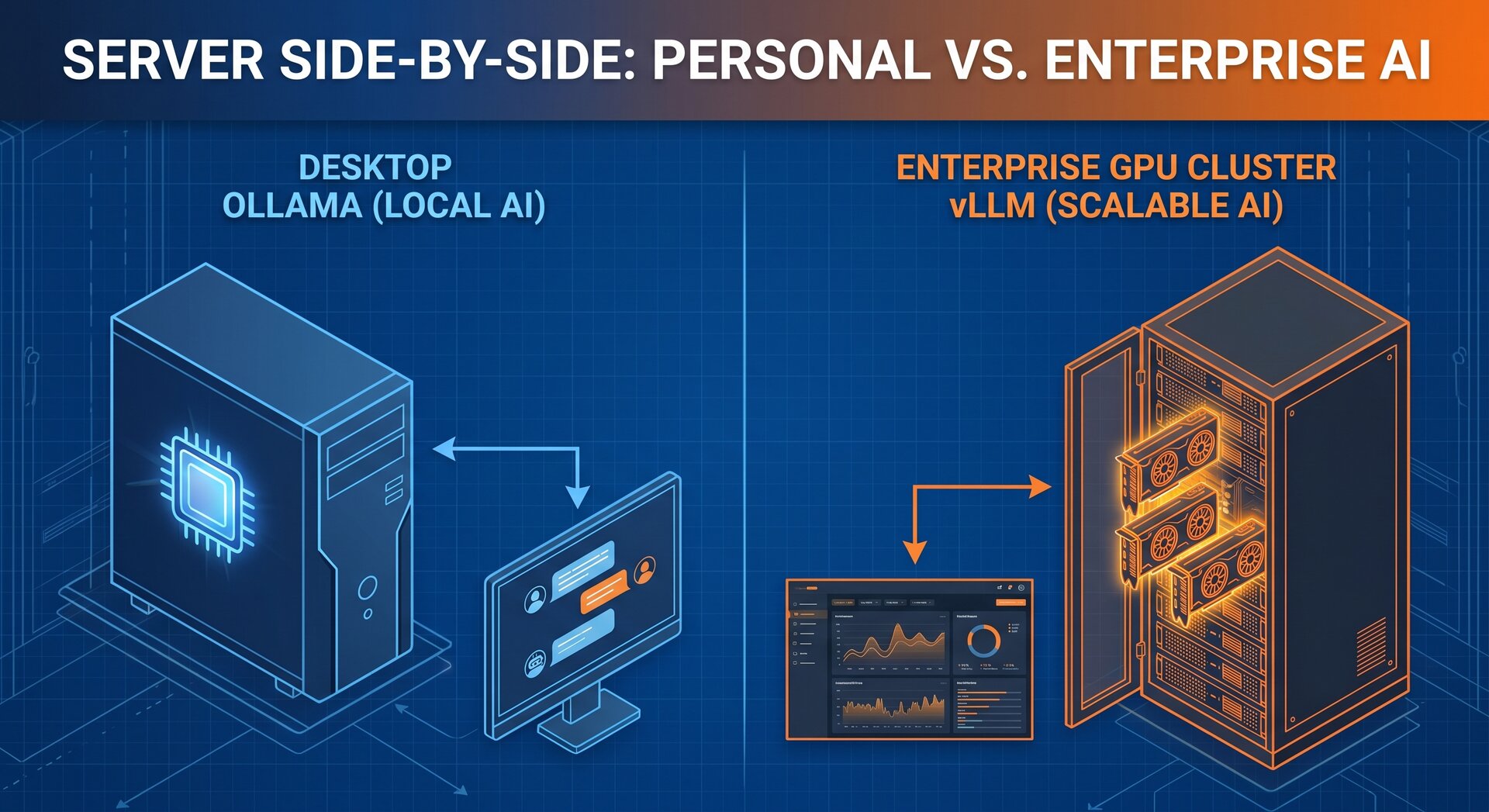

DFlash ist heute in alle wichtigen Inferenz-Frameworks integriert:

- vLLM ab v0.20.1+ — native Core-DFlash-Unterstützung, produktionsreif

- SGLang — Produktions-Serving, von Modal Labs mitentwickelt

- Transformers (HuggingFace) — für schnelle Experimente (Qwen3, LLaMA)

- MLX (Apple Silicon) — für lokale Tests auf M-Series-Macs

Schnellstart mit vLLM

DFlash lässt sich mit einem einzigen zusätzlichen Parameter aktivieren — der bestehende vLLM-Serve-Befehl wird lediglich um eine speculative-config erweitert:

2

3

4

5

6

7

8

--speculative-config '{

"method": "dflash",

"model": "z-lab/Qwen3.5-27B-DFlash",

"num_speculative_tokens": 15

}' \

--attention-backend flash_attn \

--max-num-batched-tokens 32768

Die OpenAI-kompatible API bleibt vollständig identisch — keine Code-Änderungen in den Anwendungen notwendig.

Schnellstart mit SGLang

2

3

4

5

6

7

8

9

10

--model-path Qwen/Qwen3.5-35B-A3B \

--speculative-algorithm DFLASH \

--speculative-draft-model-path z-lab/Qwen3.5-35B-A3B-DFlash \

--speculative-num-draft-tokens 16 \

--tp-size 1 \

--attention-backend trtllm_mha \

--speculative-draft-attention-backend fa4 \

--mem-fraction-static 0.75 \

--trust-remote-code

Warum DFlash der nächste große Sprung ist

DFlash verändert die Grundannahmen der KI-Inferenz in mehrfacher Hinsicht:

- Lossless: Die Verifikation durch das Zielmodell garantiert, dass die Ausgabequalität exakt identisch zum nicht-beschleunigten Betrieb ist — kein Trade-off wie bei Quantisierung

- Drop-in: Bestehende vLLM- und SGLang-Deployments erfordern nur minimale Konfigurationsänderungen

- Skalierbar: Je tiefer das Draft-Modell, desto besser — ohne Latenz-Penalty

- Kompatibel: DFlash lässt sich mit Quantisierung (FP8, AWQ) kombinieren für maximale Effizienz

- Universell: Funktioniert für Sprachgenerierung, Code, Mathematik und Reasoning-Modelle

Konkret bedeutet das: Ein Deployment mit vLLM oder SGLang, das heute 100 Anfragen pro Minute verarbeitet, kann mit DFlash — bei gleicher Hardware — potenziell 400–600 Anfragen pro Minute bewältigen. Für Betreiber eigener KI-Infrastruktur ist das ein massiver Hebel.

DFlash in Bitenos Infrastruktur

Wir beobachten DFlash sehr genau und testen es auf unserer Nvidia-Dynamo-basierten KI-Infrastruktur. Besonders interessant für uns: Für Modelle wie Qwen3.6-35B-A3B und Gemma 4, die wir bereits im Einsatz haben, existieren bereits fertige DFlash-Draft-Modelle. Die Integration in unser LiteLLM-gestütztes API-Gateway ist dadurch nahezu transparent für die nachgelagerten Anwendungen.

Wenn Sie mehr darüber erfahren möchten, wie Sie DFlash in Ihrer eigenen KI-Infrastruktur einsetzen können — oder wenn Sie Unterstützung beim Aufbau einer produktiven LLM-Infrastruktur suchen: Sprechen Sie uns an.

Fazit: Speculative Decoding hat gerade einen Quantensprung gemacht

DFlash ist mehr als eine Optimierung — es ist ein Paradigmenwechsel. Die Erkenntnis, dass Diffusion-Modelle als hocheffiziente Drafter eingesetzt werden können, die vom Wissen des Zielmodells profitieren, öffnet einen völlig neuen Designraum für Inferenz-Architekturen.

Wenn sich die Ergebnisse in der Breite bestätigen — und die bisherigen Benchmarks sind sehr überzeugend — wird DFlash in den nächsten Monaten zu einem Standard-Baustein jedes produktiven LLM-Deployments werden, ähnlich wie PagedAttention oder Flash Attention heute.

Wer jetzt schon vLLM v0.20.1+ oder SGLang einsetzt, kann DFlash mit einer Zeile Konfiguration aktivieren. Es gibt keinen Grund, damit zu warten.