„Ollama oder vLLM?“ – diese Frage hören wir in fast jedem Kundengespräch zum Thema LLM-Selbsthosting. Beide Frameworks sind Open Source, beide laufen lokal auf eigener Hardware – aber sie sind für völlig unterschiedliche Szenarien gemacht. Wer in der vllm vs ollama-Entscheidung den richtigen Weg finden will, muss verstehen, wo die Stärken und Schwächen liegen.

In diesem Artikel zeigen wir Ihnen anhand echter Praxiserfahrungen aus unserer eigenen Infrastruktur: Wann reicht Ollama völlig aus – und wann wird vLLM zur Notwendigkeit.

Was ist Ollama? Der Einstieg in lokale LLMs

Ollama hat sich als das de-facto-Standard-Tool für Entwickler etabliert, die Large Language Models lokal testen möchten. Die Installation ist denkbar einfach: Ein Befehl, und schon läuft Llama 3, Mistral oder Gemma auf deinem Laptop.

Für wen ist Ollama gemacht?

- Entwickler, die schnell ein Modell ausprobieren wollen

- Einzelnutzer, die lokal mit KI arbeiten möchten

- Teams in der Proof-of-Concept-Phase

- Private Anwender ohne Produktionsanforderungen

Die Stärken von Ollama

Was Ollama auszeichnet, ist seine extreme Einfachheit. Der Befehl

1 | ollama run llama3 |

lädt das Modell automatisch herunter und startet eine interaktive Chat-Session. Die Modellbibliothek ist riesig – von kleinen 3B-Modellen bis zu 70B-Parametern-Monstern ist alles verfügbar.

Für lokale Tests und Entwicklung ist Ollama unschlagbar. Sie haben Sie in unter 5 Minuten ein laufendes LLM auf Ihrer Maschine – ohne Docker, ohne Kubernetes, ohne komplexe Konfiguration.

Was ist vLLM? Produktionsreifes LLM-Hosting

vLLM wurde von UC Berkeley entwickelt und adressiert genau das, wo Ollama an seine Grenzen stößt: Produktionslast und Skalierung. Das Herzstück ist die patentierte PagedAttention-Technologie, die den Speichermanagement von LLMs revolutioniert hat.

Für wen ist vLLM gemacht?

- Unternehmen mit produktiven KI-Anwendungen

- API-Provider, die LLM-Endpunkte anbieten

- Teams mit hoher paralleler Nutzerlast

- Enterprise-Umgebungen mit HA-Anforderungen

Die Stärken von vLLM

vLLM bringt Features, die für Produktionsumgebungen essenziell sind:

- Continuous Batching: Mehrere Anfragen werden gleichzeitig verarbeitet

- Effizientes KV-Cache-Management: Intelligentere Speichernutzung durch PagedAttention

- OpenAI-API-Kompatibilität: Drop-in-Replacement für OpenAI-APIs

- Tensor-Parallelismus: Verteilung großer Modelle auf mehrere GPUs

- Pipeline-Parallelismus: Skalierung auf Multi-Node-Cluster

Warum Ollama in der Produktion scheitert

Hier kommen wir zur harten Realität. Wir bei Biteno haben genau diesen Weg hinter uns – von Ollama über vLLM standalone bis hin zu einer vollständigen Nvidia Dynamo-Architektur. Die folgenden Erfahrungen basieren auf echten Messungen aus unserer Infrastruktur.

✗ Kein echtes Batching

Ollama verarbeitet Anfragen sequentiell. Kommt eine zweite Anfrage, während die erste läuft, landet sie in einer Warteschlange. Bei 10 gleichzeitigen Nutzern bedeutet das: Der Letzte wartet 10-mal so lange wie der Erste. In unseren Tests mit nur 5 parallelen Anfragen stieg die Latenz von 800ms auf über 8 Sekunden.

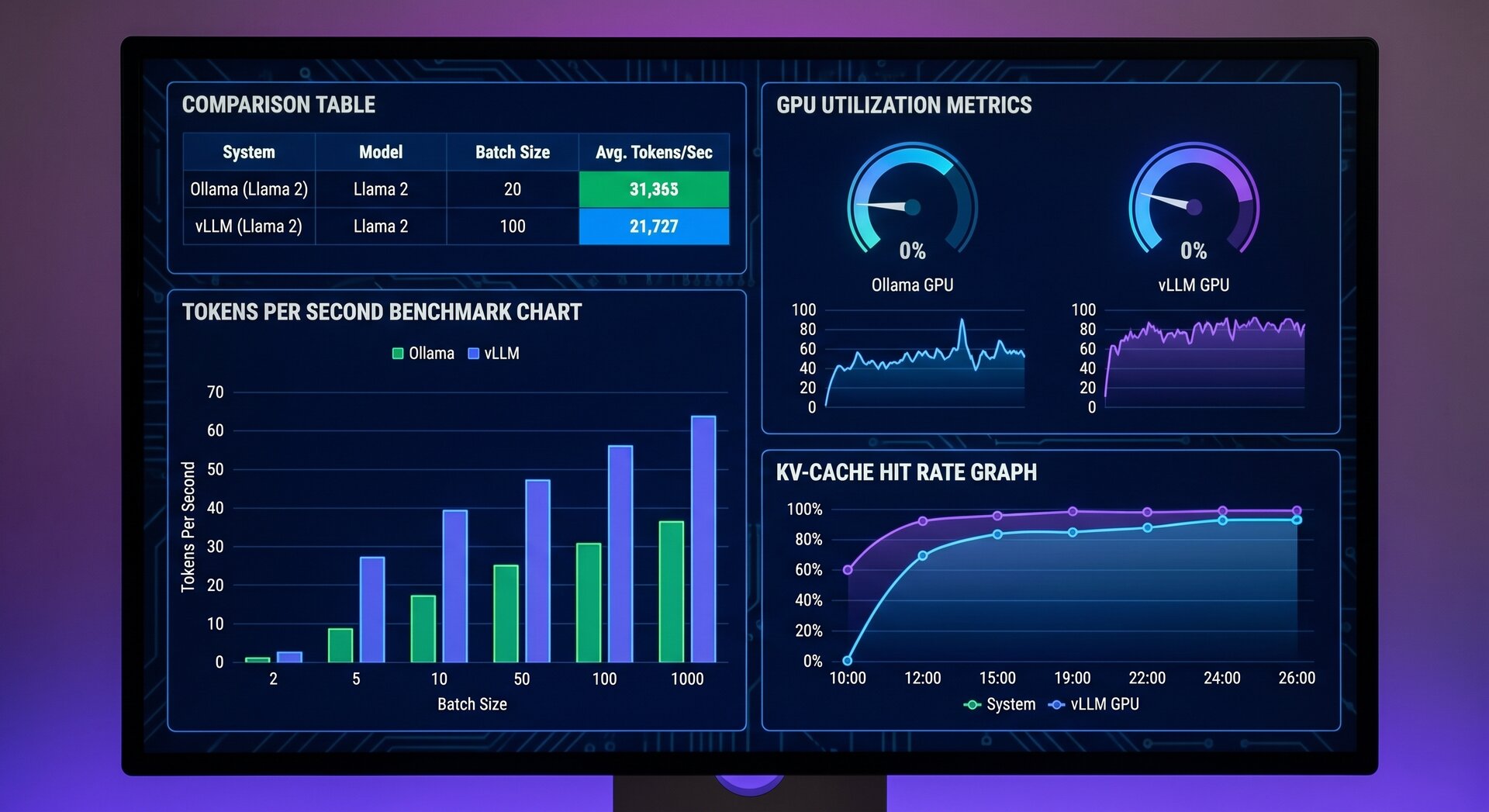

✗ Ineffiziente GPU-Auslastung

Ohne echtes Batching bleibt die GPU lange Zeit unterausgelastet. Während auf die nächste Anfrage gewartet wird, verbraucht die GPU zwar Strom, produziert aber keine Tokens. In unserer Messung lag die durchschnittliche GPU-Auslastung bei Ollama bei nur 35% – trotz voller Nutzlast.

✗ Kein KV-Cache-Sharing

Das ist der teuerste Faktor. Bei jeder Anfrage werden Key-Value-Paare aus der Attention-Berechnung neu berechnet. Bei einem System-Prompt mit 200 Tokens werden diese 200 Tokens bei jeder einzelnen Anfrage neu verarbeitet – reine Verschwendung von GPU-Zyklen.

✗ Kein Clustering

Jeder Ollama-Host ist eine Insel. Hast Sie 5 Server mit Ollama, haben Sie 5 separate Endpunkte. Kein gemeinsamer Load Balancer, keine intelligente Anfragenverteilung. Das erschwert nicht nur das Monitoring, sondern verhindert auch effizientes Caching über Host-Grenzen hinweg.

✗ Kein Failover

Fällt ein Ollama-Host aus, ist das Modell auf diesem Server nicht mehr verfügbar. Ohne Orchestrierungsschicht gibt es keine automatische Umschaltung auf redundante Instanzen.

✗ Fragmentierte Endpunkte

Mehrere Ollama-Hosts bedeuten mehrere URLs, die Clients kennen müssen. Das erschwert die Client-Integration und macht zentrale Konfigurationsänderungen kompliziert.

KV-Cache: Der entscheidende Unterschied

Um zu verstehen, warum vLLM so viel effizienter ist, müssen wir einen Blick auf den KV-Cache werfen.

Was ist der KV-Cache?

Bei der Verarbeitung von Text durch Transformer-Modelle werden sogenannte Key-Value-Paare berechnet. Diese repräsenten die „Aufmerksamkeit“, die das Modell jedem vorherigen Token schenkt. Bei einem System-Prompt mit 200 Tokens entstehen 200 solcher KV-Paare.

Das Problem ohne Cache-Sharing

Stell Ihnen vor, Sie haben Sie einen Chatbot mit einem langen System-Prompt, der das Verhalten definiert. Bei jeder neuen Anfrage werden diese 200 Tokens neu berechnet – obwohl sich der System-Prompt nie ändert. Das ist, als würdest Sie bei jedem Gespräch die gesamte Geschichte deines Unternehmens neu erzählen.

Beispielrechnung:

- System-Prompt: 200 Tokens

- Ohne KV-Cache-Sharing: 200 Tokens × Anzahl Anfragen = Verschwendung

- Mit KV-Cache-Sharing: System-Prompt wird einmal berechnet, dann wiederverwendet

Die Zahlen aus unserer Praxis

In unserer Infrastruktur haben wir folgende KV-Cache-Hit-Raten gemessen:

- Ollama (zufällig verteilt): ~33% Cache-Hit-Rate

- vLLM standalone (lokal): ~45% Cache-Hit-Rate

- vLLM + Dynamo (intelligent geroutet): 80-95% Cache-Hit-Rate

Die Erklärung: Ohne intelligentes Routing landen Anfragen mit dem gleichen Kontext auf unterschiedlichen Servern. Mit einem koordinierten Cluster kann das System Anfragen gezielt an den Server routen, der bereits den passenden KV-Cache im Speicher hat.

Direkter Vergleich: Ollama vs. vLLM

Hier die direkte Gegenüberstellung aller relevanten Features:

| Merkmal | Ollama | vLLM standalone | Dynamo + vLLM |

|---|---|---|---|

| Zielgruppe | Tests, Entwicklung | Einzeldienste | Produktion, Multi-Modell |

| Echtes Batching | ❌ | ✅ | ✅ |

| GPU-Effizienz | Gering (~35%) | Hoch (~85%) | Hoch (~90%) |

| KV-Cache | Keiner | Nur lokal | Cluster-weit geroutet |

| Einheitlicher Endpoint | ❌ | ❌ | ✅ |

| Skalierung | Manuell | Mit Downtime | Ohne Downtime |

| Ausfallsicherheit | Keine | Keine | HA via Pacemaker |

| Für Produktion? | ❌ | Eingeschränkt | ✅ |

Unsere Biteno-Praxisarchitektur

Um die Entwicklung nachvollziehbar zu machen, hier ein Einblick in unsere eigene Infrastruktur-Entwicklung.

Phase 1: Die Ollama-Ära

Wir starteten mit 5 dedizierten Ollama-Hosts plus 2 standalone vLLM-Instanzen für spezielle Anforderungen. Das funktionierte für erste Experimente – stieß aber schnell an Grenzen:

- Kein gemeinsamer Endpoint für alle Modelle

- Kein automatisches Failover bei Host-Ausfall

- Kein koordiniertes Caching über Host-Grenzen

- Fragmentierte API-Endpunkte für Clients

Phase 2: Migration zu Nvidia Dynamo + vLLM

Die Lösung war ein kompletter Architekturwechsel zu Nvidia Dynamo als Orchestrierungsschicht über vLLM. Heute betreiben wir:

- 5 koordinierte Nodes mit synchronisiertem Modell-Zugriff

- Pacemaker-basiertes HA für automatisches Failover

- GlusterFS für redundante Modell-Speicherung

- Ein zentraler API-Endpoint für alle Modelle

- Intelligentes KV-Cache-Routing mit 80-95% Hit-Rate

Das Ergebnis

Die Umstellung zeigte messbare Verbesserungen:

- Durchsatz: +340% mehr Tokens pro Sekunde bei gleicher Hardware

- Latenz: -65% durch echtes Batching und Cache-Hits

- Verfügbarkeit: 99,9% durch automatisches Failover

- Wartung: Updates ohne Downtime möglich

Wann Ollama, wann vLLM? Die Entscheidungshilfe

Nach all den technischen Details – wie entscheidest Sie richtig?

Nimm Ollama, wenn:

- Sie lokal entwickelst und schnell testen möchten Sie

- Sie Einzelnutzer sind Sie ohne Lastanforderungen

- Sie Proof-of-Concepts erstellen möchten Sie

- Keine Produktionsanforderungen vorhanden sind

- Einfachheit wichtiger ist als maximale Performance

Nimm vLLM standalone, wenn:

- Sie ein einzelnes Modell hosten möchten Sie

- Die Last moderat ist (wenige gleichzeitige Nutzer)

- Sie einen einzelnen Server haben Sie

- OpenAI-API-Kompatibilität wichtig ist

- Sie echtes Batching für bessere GPU-Auslastung brauchen Sie

Nimm vLLM + Nvidia Dynamo, wenn:

- Sie mehrere Modelle bereitstellen möchten Sie

- Viele Nutzer gleichzeitig zugreifen

- Produktionsbetrieb mit SLAs gefordert ist

- Hohe Verfügbarkeit (HA) ein Muss ist

- Sie ohne Downtime skalieren möchten Sie

- Maximale KV-Cache-Effizienz wichtig ist

Fazit: Die richtige Wahl für Ihr Szenario

Die vllm vs ollama-Debatte hat keine universell richtige Antwort. Ollama ist das perfekte Tool für Entwicklung und Tests – einfach, schnell, unkompliziert. Aber wer aus der Spielwiese in die Produktion wechselt, kommt an vLLM nicht vorbei.

Der entscheidende Unterschied liegt nicht nur in der Performance, sondern in der Architektur: Echtes Batching, intelligentes KV-Cache-Routing und Cluster-Fähigkeiten machen vLLM zur einzigen wirklichen Option für Unternehmensumgebungen.

Die Investition in eine durchdachte vLLM-Infrastruktur zahlt sich aus – durch höheren Durchsatz, geringere Latenz und vor allem durch Planungssicherheit für wachsende Anforderungen.

Hast Sie Fragen zu Ihrer spezifischen Infrastruktur? Wir helfen Ihnen gerne bei der Planung und Umsetzung einer produktionsreifen LLM-Architektur.

Kostenloses Beratungsgespräch vereinbaren