Warum Open Source KI für Unternehmen immer relevanter wird

Open Source KI hat sich von einem Nischenthema zu einer ernstzunehmenden Alternative für Unternehmen entwickelt. Im Jahr 2026 entscheiden sich immer mehr Organisationen für offene KI-Modelle – und das aus guten Gründen. Die open source ki Bewegung bietet Vorteile, die proprietäre Lösungen oft nicht bieten können: volle Kontrolle über die Daten, keine Abhängigkeit von einzelnen Anbietern und die Möglichkeit, Modelle genau auf eigene Anforderungen anzupassen.

Für Unternehmen, die Wert auf Datenschutz und DSGVO-Konformität legen, ist Open Source KI oft die einzige wirklich zukunftssichere Option. Wenn Sie sensible Unternehmensdaten verarbeiten möchten, ohne dass diese die eigenen Server verlassen, sind offene KI-Modelle die ideale Lösung. Besonders in regulierten Branchen wie dem Gesundheitswesen, der Finanzdienstleistung oder der öffentlichen Verwaltung ist die Datenhoheit unverzichtbar.

Was bedeutet „Open Source“ bei KI-Modellen?

Der Begriff „Open Source“ im Kontext von Künstlicher Intelligenz bedeutet, dass die Modellgewichte (die trainierten Parameter) öffentlich zugänglich sind. Das unterscheidet sich fundamental von proprietären Modellen wie GPT-5 oder Gemini, bei denen lediglich eine API-Schnittstelle zur Verfügung steht.

Bei open source ki Modellen können Sie:

- Das Modell auf eigener Infrastruktur betreiben

- Die Gewichte herunterladen und modifizieren

- Den Quellcode des Trainings einsehen (bei vollständig Open Source)

- Die Modelle für spezifische Anwendungsfälle anpassen (Fine-Tuning)

- Ohne laufende API-Kosten arbeiten

- Die Inferenz auf Ihrer eigenen Hardware durchführen

- Die Modellarchitektur verstehen und debuggen

Wichtig zu verstehen: Nicht jedes „Open Source“-Modell ist gleich. Einige Lizenzen erlauben kommerzielle Nutzung uneingeschränkt, andere haben Einschränkungen bei der Unternehmensgröße oder der Anwendung. Vor dem Einsatz sollten Sie die jeweilige Lizenz genau prüfen. Die Apache 2.0 Lizenz und die MIT Lizenz gelten als besonders unternehmensfreundlich.

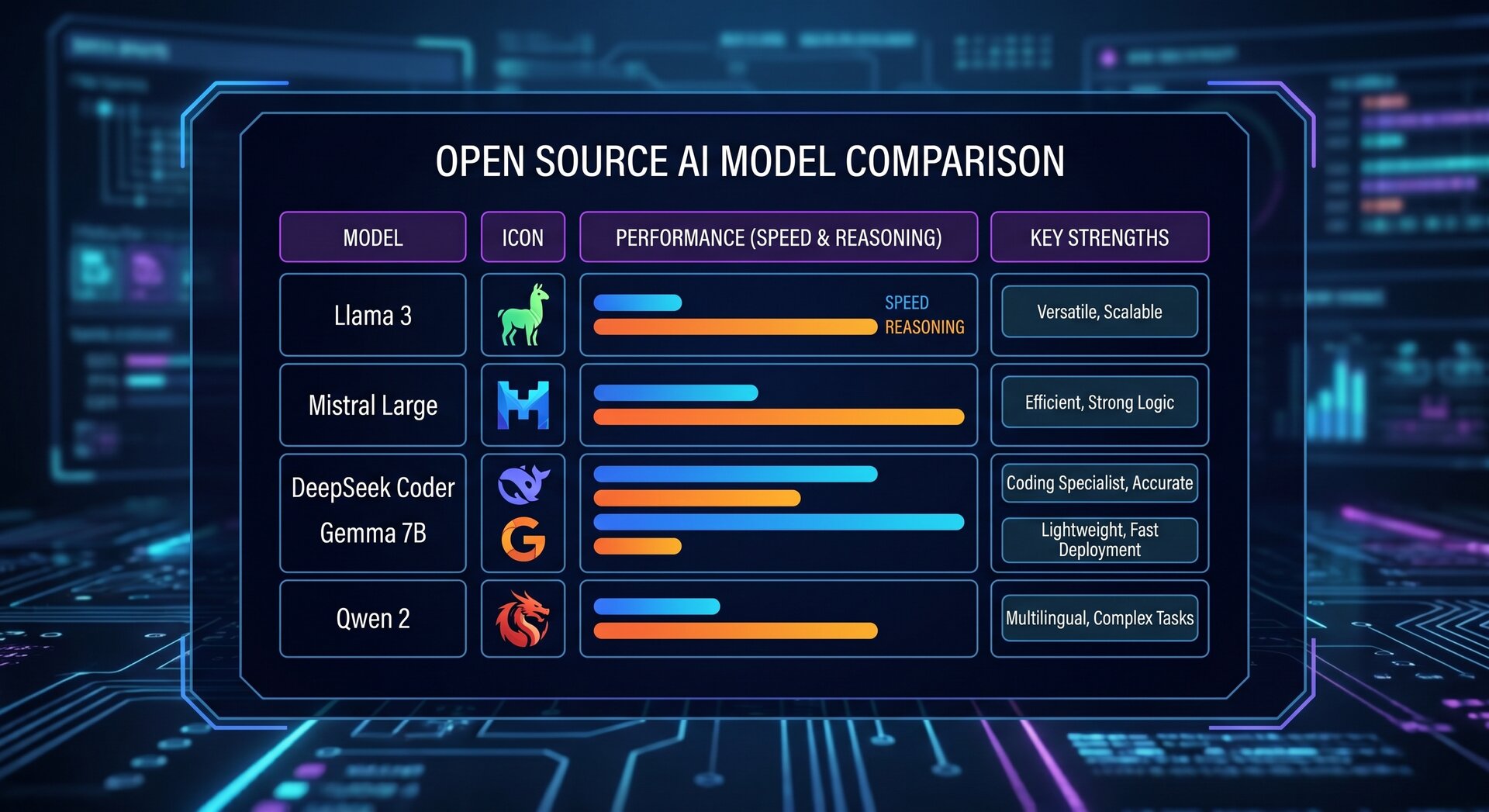

Die besten Open Source LLMs 2026

Der Markt für open source ki Modelle hat sich rasant entwickelt. Hier sind die führenden Modelle, die Unternehmen im Jahr 2026 erfolgreich einsetzen:

Llama 3.x (Meta)

Llamas neueste Versionen gehören zu den vielseitigsten Open Source Modellen überhaupt. Meta hat mit der Llama-Familie Standards gesetzt, die mittlerweile von vielen Unternehmen genutzt werden. Besonders überzeugend ist die Unterstützung deutscher und englischer Sprache auf nativem Niveau. Die Modelle sind in verschiedenen Größen verfügbar – von 8B für den Edge-Einsatz bis zu 70B für maximale Qualität.

Stärken: General Purpose Anwendungen, breite Sprachunterstützung, große Community, vielfältige Modellgrößen

Einsatzgebiete: Dokumentenanalyse, Kundenservice-Chatbots, Content-Erstellung, interne Wissensdatenbanken

Mistral / Mixtral

Das französische Unternehmen Mistral AI hat mit seinen Modellen bewiesen, dass Effizienz nicht auf Kosten der Leistung gehen muss. Mixtral nutzt eine Mixture-of-Experts (MoE) Architektur, die besonders kosteneffizient arbeitet. Nur ein Teil der Modellparameter wird bei jedem Forward-Pass aktiviert, was den Rechenaufwand deutlich reduziert.

Stärken: Hohe Effizienz, kommerzielle Lizenz, exzellente Code-Generierung, MoE-Architektur

Einsatzgebiete: Business-Applikationen, Software-Entwicklung, API-Integration, Echtzeit-Anwendungen

DeepSeek V3/R1

DeepSeek hat mit seinen Reasoning-Modellen für Aufsehen gesorgt. Besonders bei komplexen Denkaufgaben und mathematischen Problemen liefern DeepSeek-Modelle beeindruckende Ergebnisse. Das R1-Modell nutzt Chain-of-Thought-Reasoning, um komplexe Aufgaben Schritt für Schritt zu lösen.

Stärken: Coding, Reasoning, mathematische Problemlösung, Chain-of-Thought

Einsatzgebiete: Technische Dokumentation, Code-Review, komplexe Analysen, Forschung

Qwen3 (Alibaba)

Mit Qwen3 hat Alibaba eines der effizientesten MoE-Modelle veröffentlicht. Die Skalierbarkeit und der Ressourcenverbrauch machen es besonders interessant für Unternehmen mit begrenztem Budget. Qwen3 unterstützt über 100 Sprachen und ist besonders stark in asiatischen Sprachen.

Stärken: MoE-Architektur, sehr effizient, starke Multilingualität, langer Kontext

Einsatzgebiete: Mehrsprachige Anwendungen, skalierbare Deployment-Szenarien, globale Unternehmen

Gemma4 (Google)

Googles Gemma-Familie beeindruckt mit extrem langem Kontextfenster (256K Token) und multimodalen Fähigkeiten. Für Unternehmen, die lange Dokumente verarbeiten müssen, ist Gemma4 oft die erste Wahl. Die Modelle basieren auf derselben Architektur wie Googles kommerzielle Gemini-Modelle.

Stärken: 256K Kontextfenster, multimodal, zuverlässige Leistung, Forschungsbasiert

Einsatzgebiete: Lange Dokumentenanalyse, multimodale Workflows, Forschung, Wissensmanagement

Open Source KI-Tools und Frameworks

Das richtige Modell ist nur die halbe Miete. Um open source ki produktiv einzusetzen, brauchen Sie die passende Infrastruktur. Diese Tools erleichtern den Einstieg und den produktiven Betrieb:

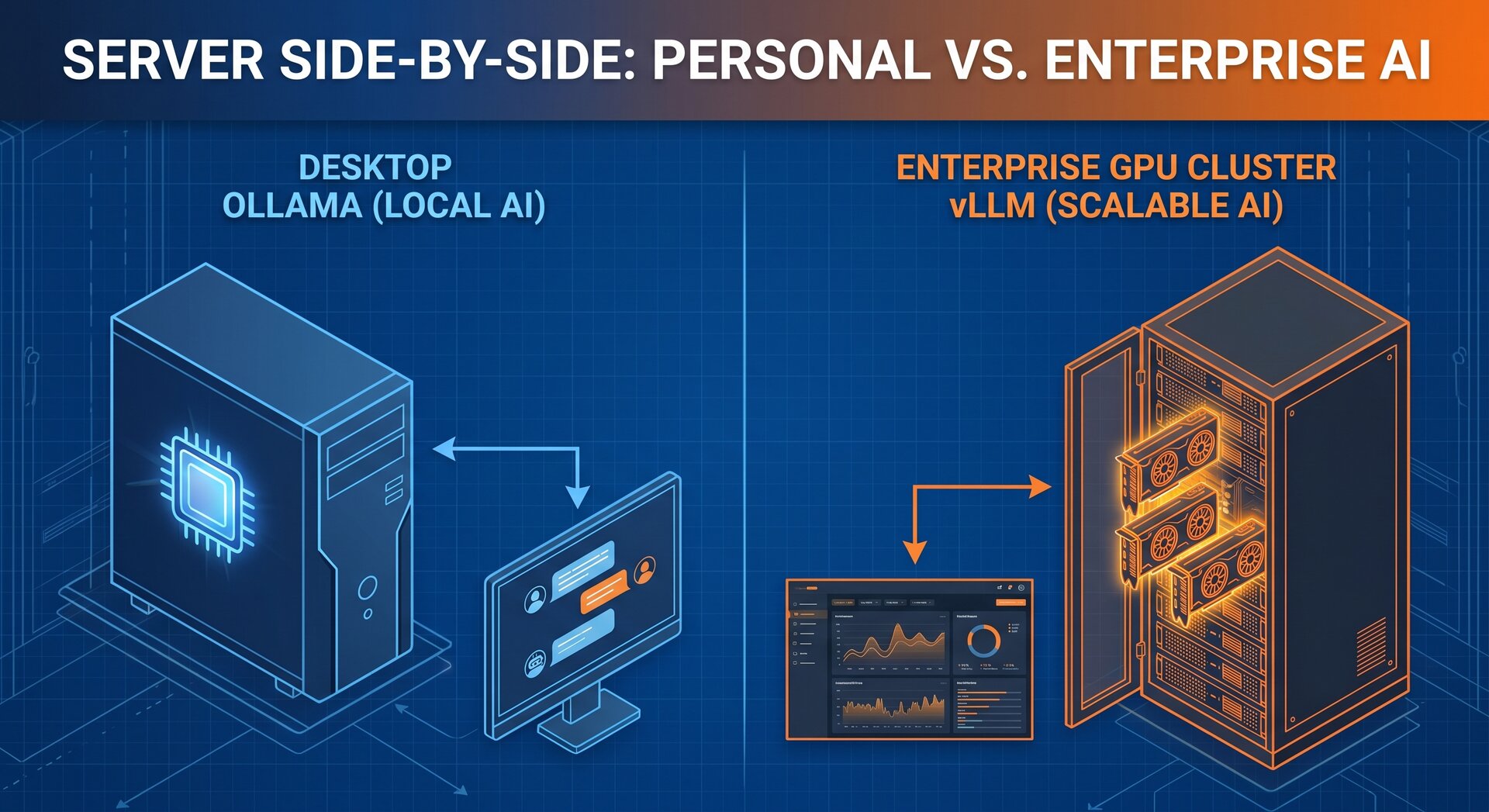

Ollama – Der einfache Einstieg

Ollama macht den Start mit Open Source KI so einfach wie möglich. Mit einem einzigen Befehl können Sie Modelle herunterladen und lokal ausführen. Ideal für erste Experimente und kleinere Deployment-Szenarien. Ollama unterstützt alle gängigen Open Source Modelle und bietet eine einfache CLI sowie eine integrierte API.

vLLM – Für den Produktionsbetrieb

Wenn Sie open source ki im Unternehmenseinsatz betreiben möchten, ist vLLM das bevorzugte Framework. Es optimiert den Durchsatz und die Latenz durch fortschrittliche Paging-Techniken. Continuous Batching und PagedAttention ermöglichen eine deutlich höhere Effizienz als naive Implementierungen. Mehr über vLLM erfahren

SGLang – High Performance

Für besonders anspruchsvolle Workloads bietet SGLang noch höhere Performance als vLLM. Die strukturierte Generierung und optimierte Batch-Verarbeitung machen es zur Wahl für maximale Effizienz. SGLang ist besonders gut für Anwendungen geeignet, die strukturierte Outputs wie JSON benötigen. Details zu SGLang

Open WebUI – Das Benutzerinterface

Ein modernes, anpassbares Web-Interface für alle gängigen Open Source Modelle. Ihre Mitarbeiter können sofort loslegen, ohne technische Details zu verstehen. Open WebUI unterstützt RAG (Retrieval Augmented Generation), Multi-User-Setup und Integration mit verschiedenen Backend-Systemen. Open WebUI vorstellen

LiteLLM – Das API-Gateway

LiteLLM vereinheitlicht den Zugriff auf verschiedene Modelle über eine einheitliche API. Das vereinfacht die Integration in bestehende Systeme enorm und ermöglicht einfaches Load-Balancing zwischen verschiedenen Modellen. LiteLLM übersetzt OpenAI-kompatible API-Calls auf verschiedene Backend-Systeme.

Nvidia Dynamo – Enterprise-Orchestrierung

Für große Enterprise-Deployments bietet Nvidia Dynamo eine vollständige Orchestrierungsebene. Dynamos disaggregierte Architektur ermöglicht die separate Skalierung von Prefill- und Decode-Phasen, was zu erheblichen Kosteneinsparungen führt.

Vorteile gegenüber proprietären Modellen

Der Einsatz von open source ki bietet Unternehmen entscheidende strategische Vorteile:

Datenschutz und DSGVO-Konformität: Ihre Daten verlassen niemals Ihre Infrastruktur. Keine Übertragung zu externen Anbietern, keine unsicheren Datenschutzbestimmungen im Ausland. Das ist besonders wichtig seit den jüngsten Entwicklungen beim EU-US Data Privacy Framework.

Keine laufenden API-Kosten: Nach der initialen Investition in Hardware fallen keine Nutzungsgebühren an. Bei hohem Volumen amortisiert sich die Eigeninfrastruktur schnell. Viele Unternehmen sparen bereits nach 12-18 Monaten gegenüber Cloud-API-Nutzung.

Volle Kontrolle: Sie entscheiden, wann Updates eingespielt werden. Keine überraschenden Änderungen am Modellverhalten, keine Abhängigkeit von Roadmaps externer Anbieter. Das ist kritisch für produktive Systeme, bei denen Konsistenz wichtig ist.

Anpassbarkeit: Fine-Tuning auf eigene Daten, eigene Prompt-Templates, individuelle Sicherheitsrichtlinien. Das Modell arbeitet genau so, wie Sie es benötigen. Sie können sogar die Modellarchitektur modifizieren, wenn nötig.

Kein Vendor Lock-in: Sie können jederzeit zwischen verschiedenen Open Source Modellen wechseln oder mehrere parallel betreiben. Das schafft Verhandlungsposition und Flexibilität.

Nachteile und Herausforderungen

Ehrlichheit ist wichtig: Der Einsatz von open source ki bringt auch Herausforderungen mit sich:

Infrastruktur-Aufwand: Sie benötigen dedizierte Hardware (GPUs) und technisches Know-how für den Betrieb. Das kann eine Herausforderung sein, wenn Ihr Team bisher keine Erfahrung mit GPU-Servern hat.

Wartung und Updates: Neue Modellversionen erscheinen monatlich. Diese müssen selbst getestet und deployed werden. Sicherheitsupdates erfordern aktives Monitoring und schnelles Handeln.

Initialkosten: Die Anschaffung von GPU-Servern ist eine Investition, die sich erst bei entsprechendem Nutzungsvolumen rechnet. Ein Server mit RTX 4090 liegt aktuell bei etwa 4.000-6.000 EUR.

Fachwissen erforderlich: Im Gegensatz zu einfachen API-Lösungen benötigen Sie internes Know-how oder einen kompetenten Partner. Troubleshooting bei GPU-Problemen oder Optimierung des Durchsatzes erfordert spezialisiertes Wissen.

Biteno-Kontext: Unsere Expertise

Bei Biteno setzen wir seit 2025 auf Open Source KI für unsere internen Prozesse und Kundenprojekte. Wir betreiben eigene Infrastruktur mit verschiedenen open source ki Modellen – von Llama über Mistral bis zu spezialisierten Fine-Tunes für spezifische Branchen.

Unsere Erfahrung zeigt: Mit der richtigen Infrastruktur und dem passenden Modell lassen sich 90% der KI-Anwendungsfälle kosteneffizient und datenschutzkonform mit Open Source lösen. Die verbleibenden 10% – komplexeste Reasoning-Aufgaben oder extremste Multimodal-Anforderungen – erledigen wir bei Bedarf über ergänzende Cloud-APIs.

Wir helfen unseren Kunden bei der Auswahl, dem Aufbau und dem Betrieb von Open Source KI-Infrastruktur. Von der ersten Evaluation bis zum produktiven 24/7-Betrieb begleiten wir Sie auf dem gesamten Weg. Unsere Managed Service-Angebote ermöglichen es Unternehmen, die Vorteile selbst gehosteter KI zu nutzen, ohne selbst für Wartung und Updates zuständig zu sein.

Fazit und Handlungsempfehlung

Open Source KI ist 2026 keine Experimentier-Technologie mehr – sie ist bereit für den Unternehmenseinsatz. Mit Modellen wie Llama 3.x, Mistral und DeepSeek stehen Ihnen leistungsfähige Alternativen zu proprietären Lösungen zur Verfügung, die in vielen Anwendungsfällen gleichwertige oder sogar bessere Ergebnisse liefern.

Die Entscheidung für open source ki ist vor allem eine strategische: Kontrolle über Daten, Unabhängigkeit von Anbietern und langfristige Kostenoptimierung stehen gegen initialen Aufwand und Betriebsverantwortung. Für die meisten mittelständischen Unternehmen lohnt sich diese Abwägung zunehmend zugunsten von Open Source.

Möchten Sie erfahren, ob Open Source KI für Ihr Unternehmen die richtige Wahl ist? Kontaktieren Sie uns für ein unverbindliches Beratungsgespräch. Wir analysieren Ihre Anforderungen und entwickeln gemeinsam die passende KI-Strategie – ob mit selbst gehosteter Infrastruktur oder einem Managed Service-Ansatz.