Wer LLMs selbst betreiben will, steht schnell vor einer zentralen Frage: Welche Inferenz-Engine nutze ich? SGLang hat sich in den letzten zwei Jahren zur ernsthaftesten Alternative zu vLLM entwickelt — und übertrifft es in vielen praxisrelevanten Szenarien deutlich. In diesem Artikel erklären wir, was SGLang ist, wie es funktioniert, wo es gegenüber vLLM, TensorRT-LLM und anderen die Nase vorn hat, und warum wir es bei Biteno als Backend unter Nvidia Dynamo einsetzen.

Was ist SGLang?

SGLang (Structured Generation Language) ist ein hochperformantes Open-Source-Serving-Framework für Large Language Models (LLMs) und multimodale Modelle. Es wurde von der LMSYS-Gruppe (UC Berkeley, Stanford, CMU) entwickelt und ist seit 2023 quelloffen verfügbar.

Das Ziel von SGLang: niedrige Latenz und maximaler Durchsatz — von einer einzelnen GPU bis hin zu verteilten Multi-Node-Clustern im Rechenzentrumsmaßstab. Das Projekt gehört heute zum PyTorch-Ökosystem, wurde von a16z mit einem Open Source AI Grant ausgezeichnet und läuft auf über 400.000 GPUs weltweit.

Bekannte Nutzer: xAI, AMD, NVIDIA, Intel, LinkedIn, Cursor, Oracle Cloud, Google Cloud, Microsoft Azure, AWS, Baseten — und bei Biteno als Backend unserer eigenen KI-Infrastruktur.

Das Kernproblem: Warum reicht eine normale Inference-Engine nicht?

Klassische LLM-Inference hat ein Effizienzproblem: Wenn viele Anfragen denselben oder ähnlichen Kontext enthalten — zum Beispiel einen langen System-Prompt in einem Chatbot, oder Dokumente in einem RAG-System — wird dieser Kontext bei jeder Anfrage komplett neu berechnet. Das kostet GPU-Zeit und erhöht die Latenz unnötig.

Gleichzeitig haben LLMs zwei fundamental unterschiedliche Rechenphasen, die bei klassischen Engines auf denselben Ressourcen laufen:

- Prefill: Der Kontext wird verarbeitet — sehr rechenintensiv, profitiert von FLOP-starken GPUs

- Decode: Tokens werden iterativ generiert — speicherbandbreitenintensiv, mit anderen GPU-Anforderungen

SGLang löst beide Probleme mit zwei Schlüsselinnovationen: RadixAttention und Prefill-Decode-Disaggregierung.

Die technischen Kernfunktionen von SGLang

RadixAttention – intelligentes Prefix-Caching

Die wichtigste Innovation von SGLang ist RadixAttention: ein automatisches, token-genaues Prefix-Caching auf Basis eines Radix-Baums (Trie). Was das bedeutet:

- SGLang erkennt automatisch, wenn mehrere Anfragen einen gemeinsamen Kontextpräfix haben

- Der KV-Cache dieses Präfixes wird berechnet, gespeichert und wiederverwendet — ohne Neuberechnung

- Das funktioniert auf Token-Ebene, nicht nur auf Block-Ebene (wie bei vLLM)

Das Ergebnis in der Praxis: Bei Chatbots mit langen System-Prompts 10–20% schnellere Antworten, bei RAG-Anwendungen bis zu 6,4-fach höherer Durchsatz — weil die Dokumenten-Kontexte nicht ständig neu prozessiert werden müssen.

Zero-Overhead CPU-Scheduler

SGLang verwendet einen vollständig in C++/Rust implementierten CPU-Scheduler, der praktisch keinen Overhead gegenüber der eigentlichen GPU-Berechnung erzeugt. Das ist einer der Hauptgründe, warum SGLang bei hoher Last stabiler bleibt als vLLM: Während vLLM unter starker Konkurrenz den Durchsatz reduziert (von 22 auf 16 tok/s), hält SGLang konstant 30–31 tok/s.

Prefill-Decode-Disaggregierung

Genau wie Nvidia Dynamo auf Orchestrierungsebene unterstützt SGLang auf Engine-Ebene die Trennung von Prefill und Decode auf verschiedene GPU-Pools. Das ermöglicht es, rechenintensive Prefill-Operationen und bandbreitenintensive Decode-Operationen unabhängig zu skalieren und zu optimieren.

Continuous Batching & Paged Attention

SGLang implementiert modernes Continuous Batching (Anfragen werden dynamisch zu Batches zusammengefasst, ohne auf den langsamsten zu warten) sowie Paged Attention für effizientes KV-Cache-Management. Diese Techniken sind heute Standard in allen modernen Inferenz-Engines — SGLang hat sie von Anfang an integriert.

Structured Outputs – bis zu 10-fach schneller

SGLang bietet native Unterstützung für strukturierte Ausgaben (JSON, XML, reguläre Ausdrücke) durch eine optimierte Finite-State-Machine-Implementierung mit überlappter Masken-Generierung. Das Ergebnis: strukturierte Outputs werden 3–10-fach schneller als bei Alternativen generiert. Besonders relevant für Anwendungen, die LLMs für strukturierte Datenextraktion nutzen.

Quantisierung: FP4, FP8, INT4, AWQ, GPTQ

SGLang unterstützt alle gängigen Quantisierungsformate und ermöglicht so den effizienten Betrieb großer Modelle auf weniger VRAM — ohne signifikante Qualitätseinbußen. Ein 70B-Modell in FP8 belegt nur halb so viel GPU-Speicher wie in FP16.

Multi-LoRA-Batching

Für Anwendungen, die viele verschiedene Fine-Tuned-Varianten eines Basismodells einsetzen: SGLang kann mehrere LoRA-Adapter gleichzeitig verwalten und Anfragen an verschiedene Adapter in einem einzigen Batch bündeln. Das spart GPU-Ressourcen gegenüber dem Betrieb separater Modell-Instanzen.

Speculative Decoding

SGLang unterstützt Speculative Decoding: Ein kleineres „Entwurfsmodell“ generiert Token-Vorschläge, die dann vom großen Modell in einem Schritt verifiziert werden. Das beschleunigt die Decode-Phase erheblich, ohne Qualitätsverluste.

SGLang vs. vLLM: Der direkte Vergleich

Die Frage, die fast jeder stellt: Ist SGLang wirklich besser als vLLM? Die Antwort ist differenziert — aber für viele Anwendungsfälle klar ja.

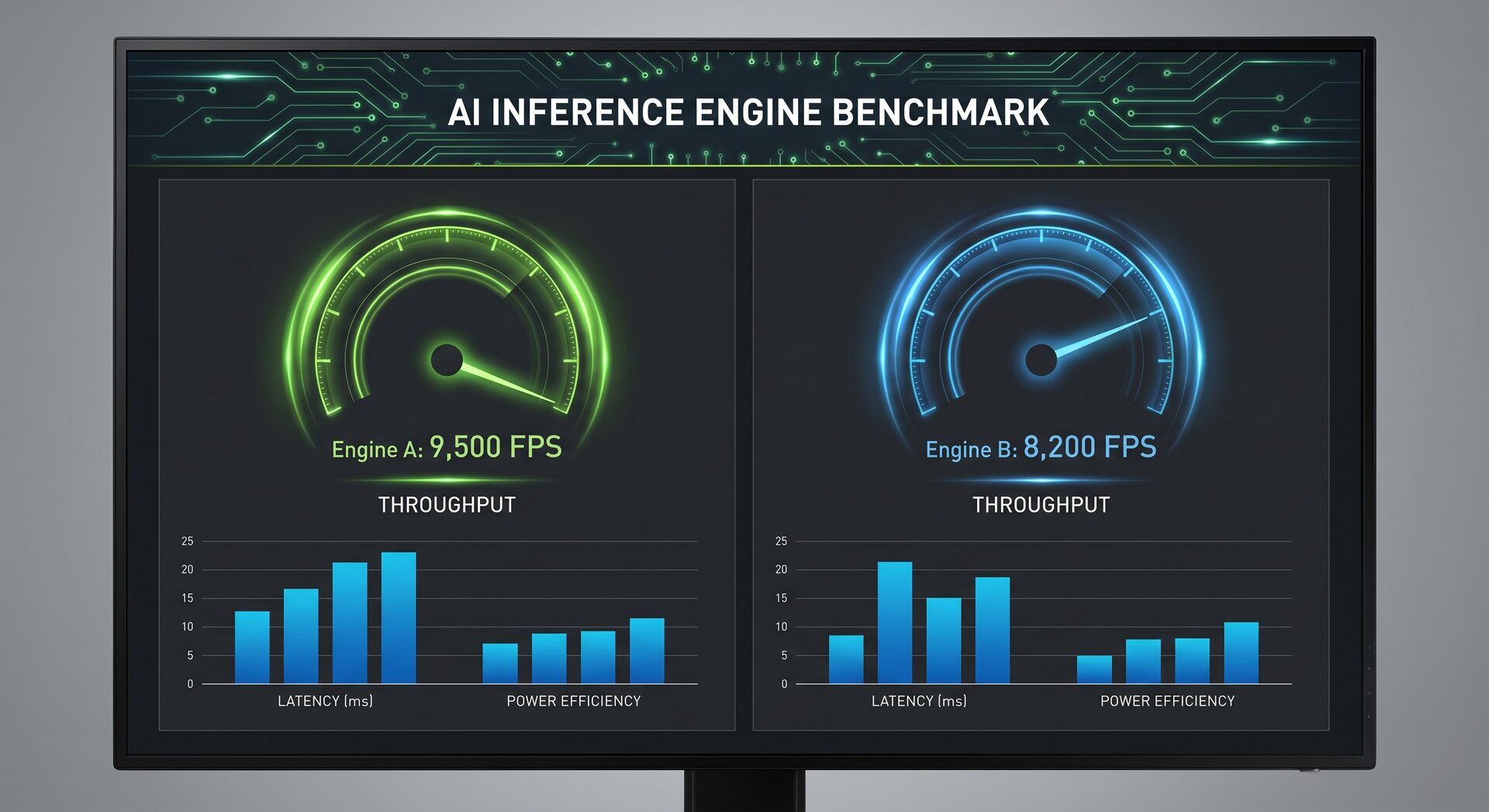

Durchsatz-Benchmarks (H100, Llama 3.1 8B)

- Gesamtdurchsatz: SGLang 16.200 tok/s vs. vLLM 12.550 tok/s → +29% für SGLang

- Output-Token-Durchsatz: SGLang 894 tok/s vs. vLLM 413 tok/s → +116% für SGLang

- Time-to-First-Token (p50): SGLang 79 ms vs. vLLM 103 ms → 23% schneller

- Inter-Token-Latenz: SGLang 6,0 ms vs. vLLM 7,1 ms → 15% schneller

Wichtig: Der Vorteil ist workload-abhängig. Bei 8B-Modellen ist der Abstand 29%, bei 70B+-Modellen schrumpft er auf 3–5%. SGLang glänzt besonders bei prefix-lastigen Workloads (RAG, Multi-Turn-Chats) — genau wegen RadixAttention.

Stabilität unter Last

Besonders auffällig: SGLang bleibt bei hoher Konkurrenz konstant, während vLLM unter Last den Durchsatz reduziert. Das macht SGLang zuverlässiger in Produktionsumgebungen mit variablen Lastspitzen.

GPU-Skalierung

SGLang zeigt mit Tensor-Parallelismus beim Wechsel von 2 auf 4 GPUs einen Durchsatzzuwachs von 88% — deutlich besser als vLLM mit 15–20%. Das macht SGLang attraktiver für horizontale Skalierung.

Wo vLLM die Nase vorn hat

- Hardware-Unterstützung: vLLM unterstützt mehr Hardware-Varianten (TPUs, AWS Trainium)

- Ecosystem-Reife: vLLM hat 3× mehr Contributor und eine breitere Plugin-Landschaft

- Einfache Einrichtung: vLLM ist für Einsteiger oft etwas einfacher zu konfigurieren

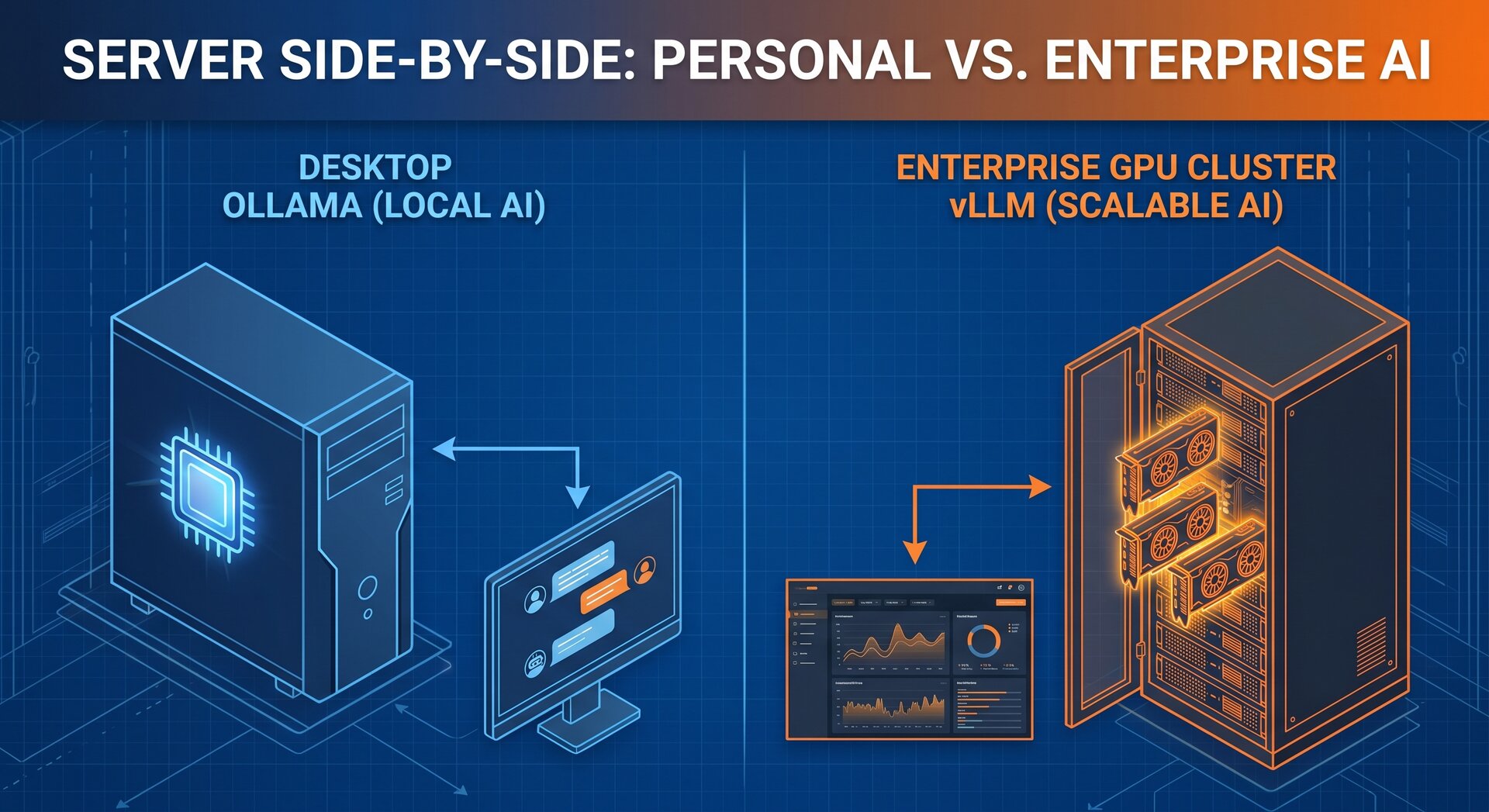

SGLang vs. TensorRT-LLM vs. Ollama

- vs. TensorRT-LLM: TensorRT-LLM ist NVIDIAs eigene hochoptimierte Engine — extrem schnell, aber komplex einzurichten, NVIDIA-only, und erfordert aufwendige Modell-Konvertierung. SGLang ist deutlich flexibler und unterstützt auch AMD und andere Hardware

- vs. Ollama: Ollama ist auf Einfachheit für lokale Einzelnutzer ausgelegt, nicht auf Produktions-Serving mit hohem Durchsatz. Gegenüber HuggingFace-Baseline erreicht SGLang 6,4-fach höheren Durchsatz

- vs. vLLM: Wie oben beschrieben — SGLang ist bei prefix-lastigen Workloads und bei Multi-GPU-Skalierung im Vorteil

Unterstützte Modelle und Hardware

Modelle

SGLang unterstützt praktisch alle relevanten Open-Source-Modelle:

- LLMs: Llama (alle Versionen), Qwen, DeepSeek (V3, R1, V3.2), Kimi, Mistral, Gemma, GPT-kompatible Architekturen und viele mehr

- Multimodale Modelle: LLaVA, Qwen-VL und andere Vision-Language-Models

- Diffusion-Modelle: WAN, Qwen-Image für Bild- und Videogenerierung

- Embedding-Modelle & Reward-Modelle

Hardware

- NVIDIA: GB200, B300, H100, A100, RTX 5090 und weitere

- AMD: Instinct MI355, MI300X — volle Unterstützung inklusive DeepSeek-R1-Optimierungen

- Google TPU — via SGLang-JAX-Backend

- Intel Xeon CPUs

- Huawei Ascend NPUs

SGLang und Nvidia Dynamo: Die ideale Kombination

Ein wichtiger Aspekt für alle, die größere KI-Infrastrukturen betreiben: SGLang ist das am stärksten integrierte Backend in Nvidia Dynamo — NVIDIAs Open-Source-Framework für verteilte Multi-Node-Inferenz. Die Kombination ist mächtig:

- SGLang übernimmt die GPU-nahe Optimierung: RadixAttention, Batching, Quantisierung

- Nvidia Dynamo orchestriert den Cluster: Routing, KV-Cache-Management über Nodes, automatisches Scaling

Das gemeinsame Benchmark-Ergebnis auf NVIDIA GB300 NVL72: 25-fache Inferenz-Performance gegenüber Baseline-Setups. Bei Biteno setzen wir genau diese Kombination ein — SGLang als Inferenz-Engine auf unseren 7 LLM-Hosts, koordiniert durch Nvidia Dynamo.

Schnellstart: SGLang in 5 Minuten

Der einfachste Einstieg über Docker:

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

docker run --gpus all \

--shm-size 32g \

-p 30000:30000 \

lmsysorg/sglang:latest \

python3 -m sglang.launch_server \

--model-path Qwen/Qwen3-8B \

--host 0.0.0.0 \

--port 30000

# Anfrage senden (OpenAI-kompatible API)

curl http://localhost:30000/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "Qwen/Qwen3-8B",

"messages": [{"role": "user", "content": "Was ist SGLang?"}]

}'

Alternativ per pip (für fortgeschrittene Nutzer mit CUDA 12.4+):

2

3

4

5

python3 -m sglang.launch_server \

--model-path meta-llama/Llama-3.1-8B-Instruct \

--port 30000

Die API ist vollständig OpenAI-kompatibel — jede Anwendung, die mit der OpenAI-API arbeitet, lässt sich ohne Code-Änderungen auf SGLang umstellen.

Für wen ist SGLang geeignet?

- ✅ Multi-Turn-Chatbots mit langen System-Prompts → RadixAttention spart massiv Rechenzeit

- ✅ RAG-Systeme mit gleichbleibenden Dokumenten-Kontexten → bis zu 6,4× Durchsatz

- ✅ Structured-Output-Pipelines → 3–10× schneller als Alternativen

- ✅ Multi-GPU-Setups → bessere Skalierungseffizienz als vLLM

- ✅ AMD-GPU-Nutzer → volle MI300X-Unterstützung mit DeepSeek-Optimierungen

- ✅ Produktion unter Last → stabilerer Durchsatz als vLLM bei hoher Konkurrenz

Fazit: SGLang ist heute die erste Wahl für produktives LLM-Serving

SGLang hat sich in kurzer Zeit von einem akademischen Forschungsprojekt zur industriellen Infrastruktur entwickelt — mit 400.000 GPUs im Einsatz, Adoption durch die größten Cloud-Anbieter und Technologieunternehmen der Welt und einer der aktivsten Open-Source-Communitys im KI-Bereich.

Wer heute eine neue LLM-Serving-Infrastruktur aufbaut, sollte SGLang als erste Wahl evaluieren — besonders wenn prefix-lastige Workloads (RAG, Chatbots) oder Multi-GPU-Setups im Spiel sind. Als Backend für Nvidia Dynamo in unserer eigenen Infrastruktur bei Biteno hat es sich in der Praxis bewährt.

Haben Sie Fragen zum Aufbau einer eigenen KI-Inferenz-Infrastruktur mit SGLang und Nvidia Dynamo? Sprechen Sie uns an — wir unterstützen Sie bei Konzeption, Aufbau und Betrieb.