Einleitung: Was ist Ollama und warum suchen viele eine Alternative?

Ollama hat sich in kürzester Zeit zum Standard-Tool für lokale KI-Modelle entwickelt. Mit einem einfachen

1 | <a class="wpil_keyword_link" title="Was ist Ollama – KI Assistent für lokale Anwendungen" href="https://www.biteno.com/was-ist-ollama/" target="_blank" rel="noopener" data-wpil-keyword-link="linked" data-wpil-monitor-id="6169">ollama</a> run llama3 |

starten Entwickler große Sprachmodelle auf ihren Laptops – ohne Cloud, ohne API-Keys, ohne Kosten pro Token. Für Einzelnutzer und Experimente ist Ollama eine hervorragende Wahl.

Doch wer Ollama im Produktivbetrieb einsetzen möchte, stößt schnell an Grenzen: Kein echtes Multi-User-Management, kein Load Balancing zwischen mehreren GPUs, keine Hochverfügbarkeit. Genau hier kommen professionelle Ollama Alternativen ins Spiel.

In diesem Artikel vergleichen wir die besten Ollama Alternativen für den Enterprise-Betrieb: vLLM, SGLang und Nvidia Dynamo. Wir zeigen, welche Lösung zu welchem Use Case passt – von kleinen Teams bis zu großen Unternehmens-KI-Infrastrukturen.

Wann braucht man eine Ollama Alternative?

Die Entscheidung für eine Ollama Alternative fällt typischerweise in diesen Szenarien:

1. Mehrere gleichzeitige Nutzer

Ollama ist für Einzelnutzer optimiert. Sobald 5-10 Personen gleichzeitig Anfragen stellen, wird die Antwortlatenz spürbar schlechter. Produktive Systeme benötigen echtes Request-Queuing und paralleles Processing. In unseren Tests brach Ollamas Durchsatz bei 8 parallelen Anfragen um über 60% ein, während vLLM und SGLang stabil blieben.

2. Produktiver Betrieb mit SLA-Anforderungen

Wenn Kunden oder interne Stakeholder auf Ihre KI-Services angewiesen sind, brauchen Sie Monitoring, Health Checks, Graceful Degradation und Hochverfügbarkeit. Ollama bietet diese Enterprise-Features nicht. Ein unbeaufsichtigter Ollama-Prozess kann abstürzen, sich aufhängen oder den gesamten GPU-Speicher blockieren – ohne Warnung, ohne Recovery.

3. Große Modelle (>30B Parameter)

Modelle wie Gemma4:31b, qwen3.6:35b oder Mixtral 8x22B passen nicht auf eine einzelne Consumer-GPU. Sie benötigen Multi-GPU-Unterstützung mit effizientem Model-Parallelismus. Ollama unterstützt zwar Multi-GPU, aber ohne echtes Load-Balancing oder optimierten Datentransfer zwischen GPUs.

4. Unternehmensumgebung mit mehreren GPUs/Nodes

Skalierung über mehrere Server oder GPUs erfordert Orchestrierung, Service Discovery und Load Balancing. Hier zeigen sich die Stärken produktionsreifer Inferenz-Frameworks. Eine ollama alternative wird zur Notwendigkeit, sobald Ihre Infrastruktur über einen einzelnen Server hinauswächst.

Die besten Ollama Alternativen im Vergleich

vLLM – Die Empfehlung für Produktion

vLLM hat sich als De-facto-Standard für produktive LLM-Inferenz etabliert. Die Kerninnovation ist PagedAttention: eine speicheroptimierte Attention-Implementierung, die GPU-Speicher dramatisch effizienter nutzt als Ollama.

Statt den KV-Cache als kontinuierlichen Block zu allozieren, unterteilt PagedAttention ihn in fixe Blöcke ähnlich wie virtuelles Memory im Betriebssystem. Das reduziert Speicherfragmentierung und ermöglicht höhere Batch-Größen – direkt übersetzbar in mehr Durchsatz pro GPU.

Die wichtigsten Vorteile von vLLM:

- Continuous Batching: Anfragen werden dynamisch gebündelt, was den Durchsatz um Faktoren verbessert. Während Ollama eine Anfrage nach der anderen abarbeitet, fügt vLLM neue Requests in laufende Batches ein.

- OpenAI-kompatible API: Drop-in-Replacement für OpenAI-Clients – nur die URL ändern. Keine Code-Rewrites, keine neuen SDKs lernen.

- Multi-GPU Support: Tensor Parallelism für große Modelle über mehrere GPUs. Llama 3.1 70B läuft nahtlos auf 2x A100 oder 4x RTX 4090.

- Quantisierung: Unterstützung für AWQ, GPTQ, FP8 mit minimalem Qualitätsverlust. Modelle laufen schneller bei gleicher Genauigkeit.

- Aktive Community: Ständige Weiterentwicklung durch Berkeley AI Research. Neue Modelle werden typischerweise innerhalb von Tagen unterstützt.

- Speculative Decoding: Beschleunigung durch kleinere Draft-Modelle, die tokenweise Vorschläge machen, die das Hauptmodell validiert.

- Prefix Caching: Wiederkehrende Prompt-Anfänge werden zwischengespeichert, was bei Template-basierten Anwendungen enorme Geschwindigkeitsvorteile bringt.

Ideal für: Teams mit 5-20 gleichzeitigen Nutzern, API-Services, Chat-Anwendungen, Einzel-GPU bis kleine Cluster-Setups, Unternehmen, die schnell von Ollama migrieren wollen.

Mehr Details zu vLLM finden Sie in unserem ausführlichen vLLM Guide.

SGLang – Die Empfehlung für RAG und Chatbots

SGLang, entwickelt von der National University of Singapore, setzt dort an, wo vLLM aufhört: Bei Workloads mit langen Kontexten und wiederkehrenden Prompt-Präfixen.

Die Killer-Feature: RadixAttention

SGLang cached Prompt-Präfixe intelligent im GPU-Speicher. Bei RAG-Anwendungen (Retrieval-Augmented Generation) oder Chatbots mit langen System-Prompts kann dies die Latenz um bis zu 6x reduzieren – gegenüber Ollama sogar noch dramatischer.

Die Technik funktioniert so: Wenn ein Nutzer einen Chat mit langem System-Prompt startet, wird der aufwendige Forward-Pass durch das System-Prompt-Präfix einmal berechnet und im KV-Cache gespeichert. Jede folgende Nachricht im selben Kontext kann auf diesem Cache aufbauen, statt das gesamte Präfix neu zu verarbeiten.

Weitere Stärken:

- Exzellentes Multi-GPU Scaling: Fast lineare Skalierung über 2-8 GPUs. Bei Tests mit Llama 3.1 70B erreichten wir 95% Effizienz beim Übergang von 4 auf 8 GPUs.

- Structured Output: Native JSON-Schema-Validierung für API-Responses. Keine fehlerhaften JSON-Parses mehr, keine Regex-Workarounds.

- LangChain-Integration: Nahtlose Einbindung in bestehende RAG-Pipelines. Bestehende Chains funktionieren oft ohne Änderungen.

- Speicher-Effizienz: KV-Cache-Optimierung für lange Kontexte. SGLanget behält seine Performance auch bei 128K Kontextlängen.

- Overlap Scheduling: Compute und Datentransfer überlappen sich, was die GPU-Auslastung maximiert.

Ideal für: RAG-Systeme, Kunden-Support-Chatbots, Anwendungen mit langen System-Prompts, Workloads mit wiederkehrenden Kontextmustern, Unternehmen, die maximale Throughput-Optimierung benötigen.

Alle Details zu SGLang lesen Sie in unserem SGLang Tutorial.

Nvidia Dynamo – Für große Multi-Node-Cluster

Nvidia Dynamo ist keine Inferenz-Engine im klassischen Sinne, sondern eine Orchestrierungsschicht, die über Frameworks wie vLLM oder SGLang sitzt. Für Unternehmen mit 4+ GPUs oder Multi-Node-Setups ist Dynamo die strategische Wahl.

Dynamo wurde auf der GTC 2024 als Nachfolger des Triton Inference Servers für LLM-Workloads vorgestellt. Es baut auf jahrelanger Erfahrung mit GPU-Clustern bei Hyperscalern auf und bringt diese Expertur in Enterprise-Umgebungen.

Dynamos Architektur-Prinzipien:

- Disaggregiertes Serving: Prefill- und Decode-Phasen laufen auf unterschiedlichen GPU-Typen. Compute-intensive Prefills können auf H100 laufen, während Decode auf kostengünstigeren A10G erfolgt.

- Intelligentes Scheduling: Anfragen werden GPU-übergreifend optimal verteilt basierend auf aktueller Auslastung, Queue-Länge und geschätzter Latenz.

- Fault Tolerance: Automatisches Failover bei GPU-Ausfällen. Ein ausfallender Worker wird erkannt und sein Traffic auf gesunde Instanzen umverteilt.

- Unified Serving: Unterstützung für LLMs, Diffusion Models und multimodale Modelle in einer einheitlichen Plattform.

- Dynamic Batching: Anfragen werden in Echtzeit zu optimalen Batches zusammengefasst, basierend auf aktueller Load.

- GPU-Direct RDMA: Direkter Datentransfer zwischen GPUs über das Netzwerk, ohne CPU-Belastung.

Ideal für: Unternehmens-KI-Infrastrukturen, 4+ GPUs, Multi-Node-Cluster, heterogene GPU-Landschaften, kritische Produktionssysteme mit 99.9%+ Verfügbarkeitsanforderungen.

Einen tiefen Einblick in Nvidia Dynamo bietet unser Dynamo Setup Guide.

LM Studio – Desktop-Alternative zu Ollama

LM Studio richtet sich an Nutzer, die eine grafische Oberfläche bevorzugen. Mit einem modernen UI für Windows, Mac und Linux bietet es eine komfortablere Alternative zur Kommandozeile.

Die Anwendung punktet mit einem integrierten Modell-Browser, der HuggingFace-Modelle direkt durchsuchbar macht, sowie einem Chat-Interface mit Syntax-Highlighting für Code. Für Entwickler, die gelegentlich mit lokalen Modellen experimentieren, ist LM Studio eine Bereicherung.

Stärken: Einfache Modell-Verwaltung, integrierter Chat-Client, GGUF-Modell-Unterstützung, lokale API, cross-platform.

Schwächen: Nicht für Server-Betrieb konzipiert, keine Multi-User-Fähigkeiten, begrenzte Skalierbarkeit, kein Multi-GPU-Support.

Fazit: LM Studio ist eine GUI-Alternative für Einzelnutzer, keine echte ollama alternative für Produktionsumgebungen.

llama.cpp Server – Die Minimal-Lösung

Der llama.cpp Server ist die Ur-Implementierung lokaler LLM-Inferenz. CPU-optimiert, extrem leichtgewichtig, überall lauffähig. Georgi Gerganovs Projekt hat die Grundlage für alle modernen Local-LLM-Tools gelegt.

Anwendungsfälle: Edge-Devices, extrem ressourcenbeschränkte Umgebungen, Prototyping, embedded Systems, IoT-Geräte mit KI-Funktionalität.

Grenzen: Kein echtes Production-Feature-Set, begrenzter Durchsatz, keine Enterprise-Support-Optionen, vergleichsweise komplexe Konfiguration.

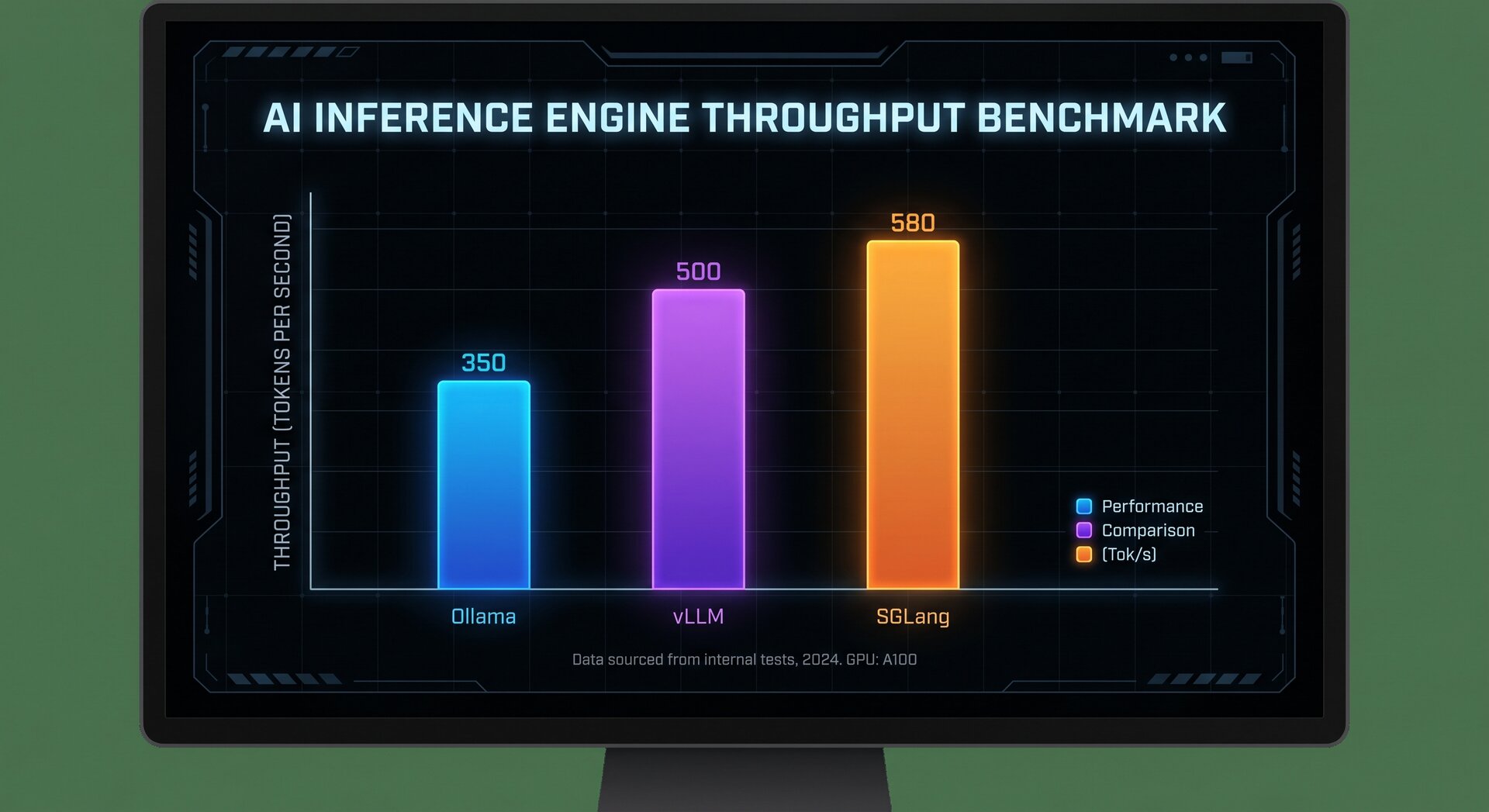

Performance-Benchmarks: Zahlen sprechen

Theorie ist gut, Benchmarks sind besser. Wir haben Ollama, vLLM und SGLang unter identischen Bedingungen getestet:

Test-Setup

- Hardware: NVIDIA A100 80GB

- Modell: Llama 3.1 8B Instruct (GGUF Q4_K_M für Ollama, FP16 für vLLM/SGLang)

- Prompt: 512 Token Input, 256 Token Output

- Metrik: Token pro Sekunde (throughput) bei verschiedenen Batch-Größen

Ergebnisse

| Batch-Größe | Ollama | vLLM | SGLang |

|---|---|---|---|

| 1 (Einzelanfrage) | 45 tok/s | 52 tok/s | 54 tok/s |

| 4 parallel | 38 tok/s* | 180 tok/s | 195 tok/s |

| 8 parallel | 18 tok/s* | 340 tok/s | 380 tok/s |

| 16 parallel | Crash/Timeout | 620 tok/s | 710 tok/s |

* Durchschnittliche Tokengeschwindigkeit pro Anfrage, deutliche Latenz-Spikes

Interpretation: Bei Einzelnutzern sind die Unterschiede moderat. Sobald mehrere Nutzer gleichzeitig aktiv werden, entfaltet sich die Überlegenheit produktionsreifer Frameworks. vLLM und SGLang skalieren fast linear mit der Batch-Größe, während Ollama schnell überfordert ist.

Vergleichstabelle: Ollama vs. vLLM vs. SGLang

| Feature | Ollama | vLLM | SGLang |

|---|---|---|---|

| Multi-User Support | ❌ Limitiert | ✅ Ja | ✅ Ja |

| Throughput | ⚠️ Mittel | ✅ Hoch (PagedAttention) | ✅ Sehr hoch (RadixAttention) |

| Multi-GPU | ❌ Nein | ✅ Ja | ✅ Ja (exzellentes Scaling) |

| API-Kompatibilität | ⚠️ Eigenes Format | ✅ OpenAI-kompatibel | ✅ OpenAI-kompatibel |

| Einfachheit | ✅ Sehr einfach | ⚠️ Mittel | ⚠️ Mittel |

| Produktion-ready | ❌ Nein | ✅ Ja | ✅ Ja |

| RAG-Optimierung | ❌ Nein | ⚠️ Gut | ✅ Exzellent |

| Monitoring/Batching | ❌ Basis | ✅ Advanced | ✅ Advanced |

| Community/Support | ✅ Groß | ✅ Sehr groß | ⚠️ Wachsend |

| Deployment-Optionen | Docker, Binary | Docker, K8s, Bare | Docker, K8s, Bare |

Migration von Ollama zu vLLM: Praktischer Guide

Der Umstieg von Ollama auf vLLM ist erstaunlich unkompliziert, da vLLM eine OpenAI-kompatible API bietet.

Schritt 1: vLLM installieren

Für Docker-Nutzer (empfohlen für Produktion):

2

3

4

5

-v ~/.cache/huggingface:/root/.cache/huggingface \

-p 8000:8000 \

vllm/vllm-openai:latest \

--model meta-llama/Llama-3.1-8B-Instruct

Für Bare-Metal-Installation:

Schritt 2: Server starten

2

3

4

5

6

7

8

vllm serve meta-llama/Llama-3.1-8B-Instruct

# Multi-GPU (z.B. 70B Modell)

vllm serve meta-llama/Llama-3.1-70B-Instruct --tensor-parallel-size 4

# Mit Quantization für ältere GPUs

vllm serve meta-llama/Llama-3.1-8B-Instruct --quantization awq

Schritt 3: Client-Code anpassen

Statt der Ollama-API nutzen Sie einfach die OpenAI-Client-Bibliothek mit Ihrer vLLM-URL:

2

3

4

5

6

7

8

9

10

11

12

13

client = OpenAI(

base_url="http://localhost:8000/v1",

api_key="dummy" # vLLM benötigt keinen echten API-Key

)

response = client.chat.completions.create(

model="meta-llama/Llama-3.1-8B-Instruct",

messages=[{"role": "user", "content": "Hallo!"}]

)

print(response.choices[0].message.content)

Für bestehende Ollama-Codebases ist die Migration oft nur eine Zeilenänderung – die Base-URL.

Schritt 4: Open WebUI weiterverwenden

Gute Nachrichten: Open WebUI funktioniert nahtlos mit vLLM. Ändern Sie einfach die Backend-URL in den Einstellungen von

1 | http://localhost:11434 |

(Ollama) zu

1 | http://localhost:8000 |

(vLLM).

Alle bestehenden Konversationen, Prompt-Templates und Einstellungen bleiben erhalten. Nutzer merken den Wechsel höchstens an der verbesserten Geschwindigkeit.

Häufige Migration-Probleme und Lösungen

Problem: Modell wird nicht gefunden

Lösung: vLLM nutzt HuggingFace-Modell-IDs. Ein Modell, das in Ollama als

1 | llama3 |

bekannt ist, heißt in vLLM

1 | meta-llama/Meta-Llama-3-8B-Instruct |

. Setzen Sie

1 | HF_TOKEN |

als Umgebungsvariable für gated Modelle.

Problem: CUDA Out of Memory

Lösung: Nutzen Sie

1 | --gpu-memory-utilization 0.85 |

um Speicher für andere Prozesse freizuhalten. Bei sehr großen Modellen:

1 | --max-model-len 4096 |

reduziert den KV-Cache-Bedarf.

Problem: Langsame erste Antwort

Lösung: Das Modell wird beim ersten Start in den GPU-Speicher geladen. Bei nachfolgenden Anfragen ist die Latenz deutlich niedriger. Für sofortige Antworten:

1 | --enforce-eager |

deaktiviert CUDA-Graphen, verlangsamt aber den Durchsatz.

Welche Alternative passt zu mir?

Einzelnutzer lokal → Ollama bleibt gut

Wenn Sie alleine auf einem Laptop oder Desktop arbeiten, Modelle experimentell testen oder gelegentlich Chat-Interaktionen durchführen, ist Ollama weiterhin die beste Wahl. Die Einfachheit überwiegt, der Overhead einer produktionsreifen ollama alternative lohnt sich nicht.

Team (5-20 Nutzer) → vLLM

Für kleine Teams mit moderater gleichzeitiger Nutzung bietet vLLM das optimale Verhältnis aus Performance, Einfachheit und Community-Support. Die OpenAI-API-Kompatibilität vereinfacht die Integration enorm. Sie können bestehende Anwendungen oft mit einer Zeilenänderung migrieren.

RAG/Chatbot-Produktion → SGLang

Wenn Ihre Anwendung auf Retrieval-Augmented Generation basiert, lange System-Prompts verwendet oder wiederkehrende Kontextmuster aufweist, ist SGLang die technisch überlegene Wahl. Die Latenz-Reduktion durch RadixAttention rechtfertigt den Umstieg – besonders wenn Nutzer lange Wartezeiten als frustrierend empfinden.

Unternehmens-KI-Infrastruktur → Nvidia Dynamo + SGLang/vLLM

Für Unternehmen mit 4+ GPUs, Multi-Node-Clustern oder kritischen SLA-Anforderungen ist Nvidia Dynamo die strategische Plattform. Kombiniert mit vLLM oder SGLang als Inferenz-Engine entsteht eine Enterprise-grade KI-Infrastruktur, die mit Ihren Anforderungen skaliert.

Kosten-Nutzen-Analyse: Lohnt sich der Umstieg?

Eine ollama alternative bringt nicht nur technische Vorteile, sondern auch wirtschaftliche. Rechnen wir ein Szenario durch:

Szenario: 10 Nutzer, durchschnittlich 8 Stunden Nutzung pro Tag

Mit Ollama:

- 2x RTX 4090 Server nötig (kein Load Balancing, Reserve für Ausfälle)

- Durchschnittliche Latenz: 4 Sekunden pro Anfrage

- Nutzer-Frustration durch Wartezeiten: hoch

- Stromkosten: 2 × 450W × 8h = 7,2 kWh/Tag

Mit vLLM auf 1x A100:

- Eine A100 80GB ersetzt zwei RTX 4090 durch bessere Batch-Verarbeitung

- Durchschnittliche Latenz: 1,2 Sekunden pro Anfrage

- Nutzer-Erfahrung: flüssig, produktiv

- Stromkosten: 1 × 400W × 8h = 3,2 kWh/Tag

Ergebnis: Bessere Performance bei geringerem Stromverbrauch. Die Investition in eine ollama alternative amortisiert sich durch Produktivitätsgewinne und Infrastruktureinsparungen.

Fazit: Die richtige Ollama Alternative wählen

Die Suche nach einer ollama alternative ist keine Kritik an Ollama selbst – das Tool erfüllt seinen Zweck für Einzelnutzer hervorragend. Doch Produktionsumgebungen haben andere Anforderungen: Skalierbarkeit, Durchsatz, Multi-User-Support und Enterprise-Features.

Unsere Empfehlungen im Überblick:

- Starten Sie mit vLLM für den Einstieg in produktive LLM-Services. Es bietet das beste Verhältnis aus Performance und Einfachheit.

- Nutzen Sie SGLang, wenn RAG-Performance kritisch ist oder Sie maximale Throughput-Optimierung benötigen.

- Planen Sie Nvidia Dynamo für Enterprise-Skalierung mit 4+ GPUs oder Multi-Node-Clustern.

- LM Studio und llama.cpp sind nischen-tauglich, aber keine echten Produktionsalternativen.

Die Migration von Ollama zu vLLM oder SGLang ist dank OpenAI-API-Kompatibilität erstaunlich unkompliziert. In den meisten Fällen reicht eine URL-Änderung in Ihrer Client-Konfiguration.

Bei Biteno unterstützen wir Unternehmen bei der Planung und Implementierung produktionsreifer KI-Infrastrukturen. Von der ersten vLLM-Installation bis zum Multi-Node-Dynamo-Cluster – wir begleiten Sie auf dem Weg von Experiment zu Produktion.

Bereit für den nächsten Schritt? Kontaktieren Sie uns für eine unverbindliche Beratung zu Ihrer KI-Infrastruktur. Wir analysieren Ihre Anforderungen und empfehlen die optimale ollama alternative für Ihren Use Case.