Wer heute große Sprachmodelle (LLMs) im eigenen Rechenzentrum betreiben will, stößt schnell an eine harte Grenze: Ein einzelner GPU-Server reicht schlicht nicht aus. Selbst modernste GPUs haben begrenzten VRAM, und Frontier-Modelle wie Gemma4:31b, Qwen3.6 oder Minimax laufen nur sinnvoll, wenn man viele GPUs koordiniert. Genau hier setzt Nvidia Dynamo an — ein quelloffenes, verteiltes Inferenz-Framework, das wir bei Biteno seit einigen Wochen im produktiven Einsatz haben. In diesem Artikel erklären wir, was Nvidia Dynamo ist, wie es technisch funktioniert und warum wir es auf unseren 7 LLM-Hosts einsetzen.

Was ist Nvidia Dynamo?

Nvidia Dynamo (offiziell: NVIDIA Dynamo Distributed Inference Framework) ist ein Open-Source-Framework für verteiltes KI-Inferenz-Serving auf Rechenzentrumsebene. Es wurde entwickelt, um die Komplexität zu managen, die entsteht, wenn große Sprachmodelle nicht mehr auf einer einzigen GPU oder einem einzelnen Server laufen können.

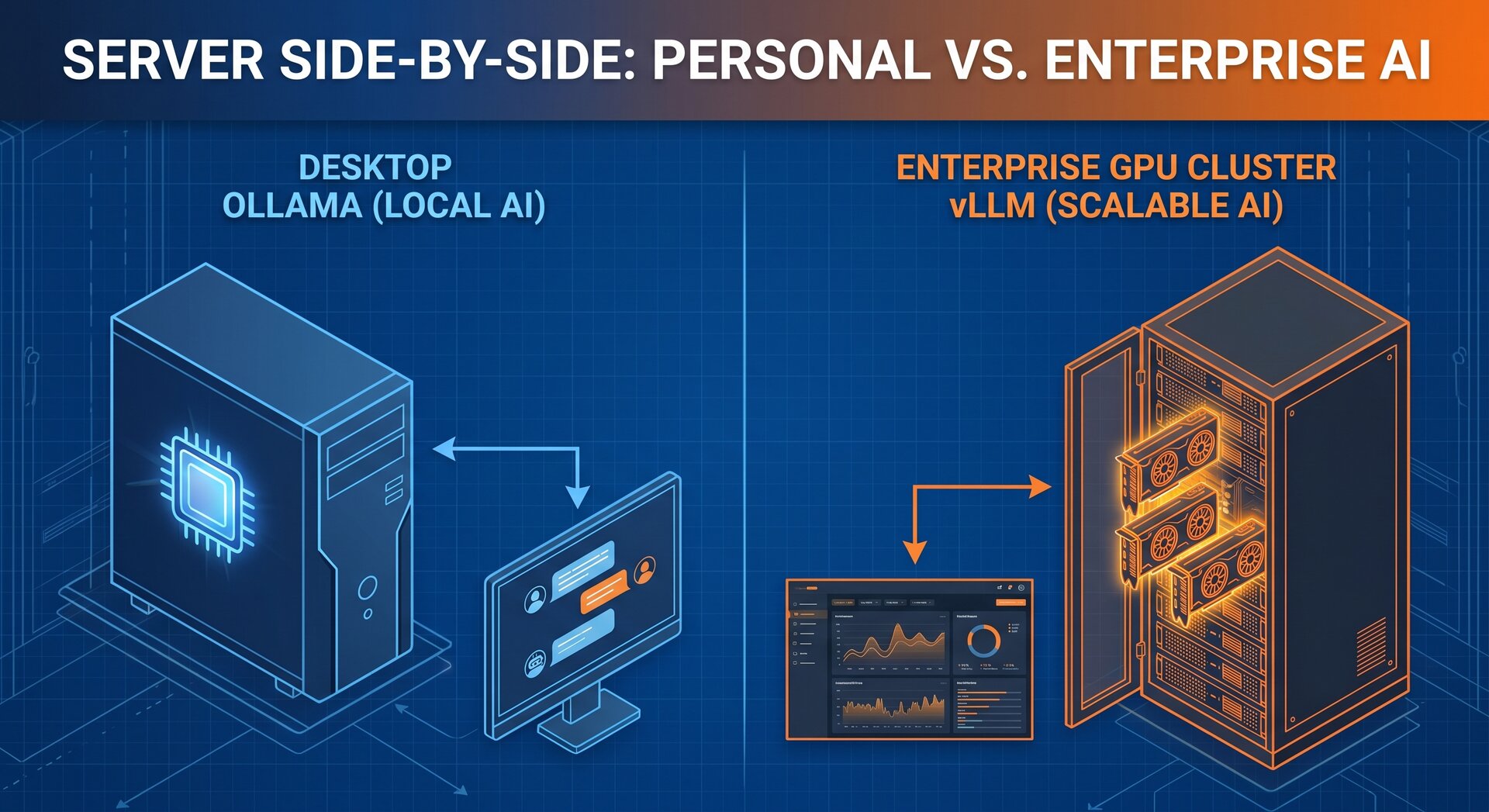

Anders als klassische Inferenz-Engines wie vLLM, SGLang oder TensorRT-LLM — die jeweils einen einzelnen Node optimieren — ist Nvidia Dynamo die Orchestrierungsschicht darüber. Es ersetzt diese Engines nicht, sondern verwandelt sie in ein koordiniertes Multi-Node-System. Dynamo ist in Rust für maximale Performance geschrieben, bietet aber eine Python-API für Erweiterungen.

Das Framework wurde im November 2025 von NVIDIA als Open-Source veröffentlicht und ist seitdem von einer wachsenden Community aus Unternehmen wie Baseten, Mistral AI, Moonshot AI und Alibaba adoptiert worden.

Das grundlegende Problem: Warum braucht man überhaupt verteilte Inferenz?

Moderne LLMs wie DeepSeek-R1 (671 Milliarden Parameter) benötigen im FP8-Format etwa 336 GB GPU-VRAM — allein für die Modellgewichte. Das übersteigt die Kapazität selbst einer einzelnen NVIDIA H100 (80 GB) um ein Vielfaches. Die Lösung: Tensor Parallelismus und Pipeline Parallelismus, bei dem das Modell auf mehrere GPUs aufgeteilt wird.

Doch selbst wenn man das gelöst hat, entstehen neue Probleme:

- Effizienz: Prefill (Kontext verarbeiten) und Decode (Token generieren) haben völlig unterschiedliche GPU-Anforderungen

- KV-Cache: Der Key-Value-Cache wächst mit jedem Token und füllt den GPU-VRAM auf

- Routing: Bei mehreren Replicas muss eine Anfrage intelligent weitergeleitet werden, um doppelte Berechnungen zu vermeiden

- Skalierung: Automatisches Hoch- und Runterskalieren nach Last ist aufwendig

Nvidia Dynamo löst all diese Probleme in einem einheitlichen Framework.

Die Kernfunktionen von Nvidia Dynamo im Detail

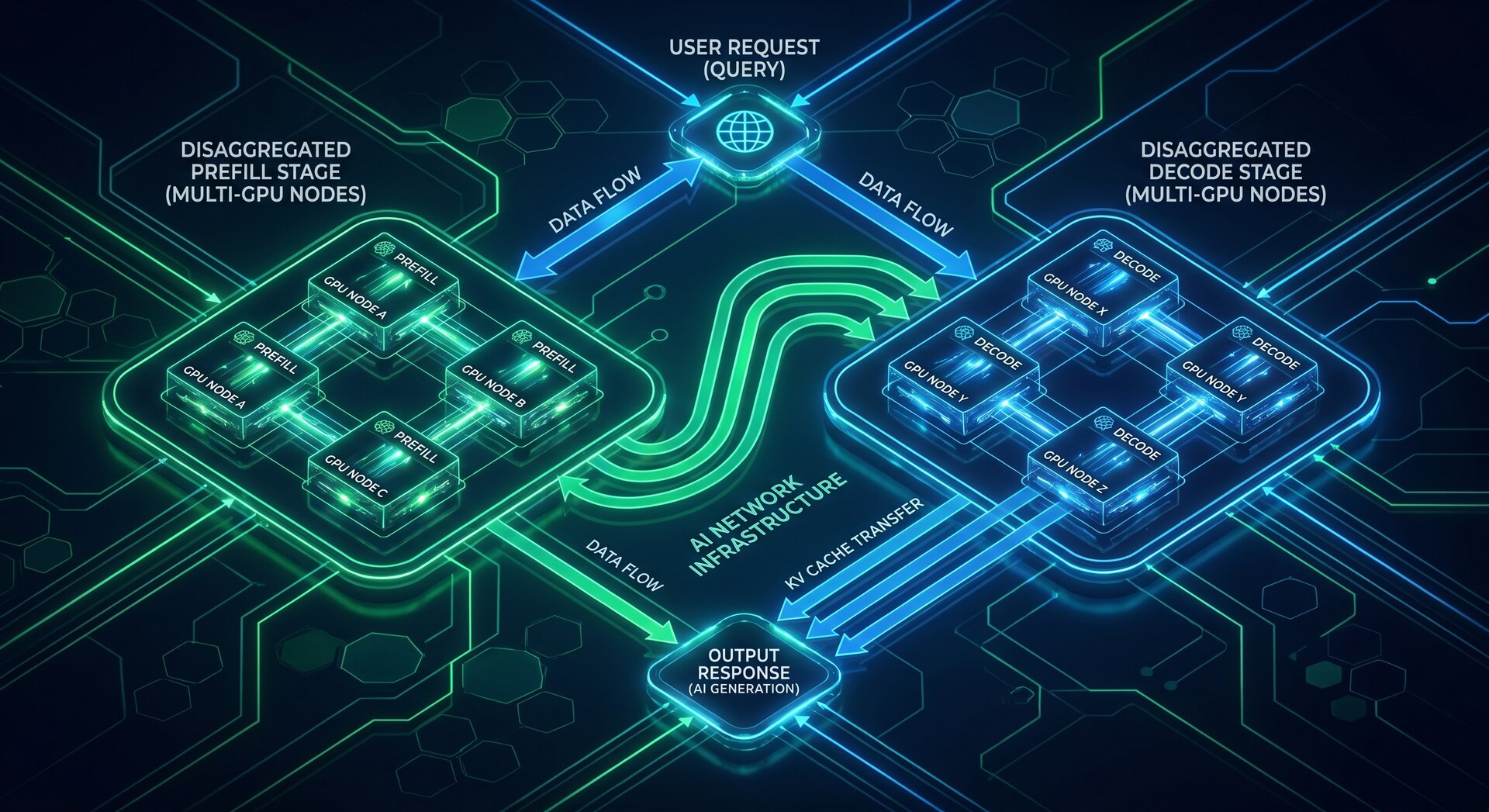

1. Disaggregiertes Serving (Prefill/Decode-Trennung)

Das Herzstück von Nvidia Dynamo ist die Disaggregierung von Prefill und Decode. Was bedeutet das konkret?

Bei jedem LLM-Aufruf gibt es zwei Phasen:

- Prefill: Der gesamte Input-Kontext (Prompt) wird auf einmal verarbeitet. Das ist rechnerisch sehr intensiv und profitiert von hoher FLOP-Leistung

- Decode: Tokens werden iterativ, eines nach dem anderen, generiert. Das ist speicherbandbreiten-intensiv, aber weniger rechenintensiv

In klassischen Setups laufen beide Phasen auf denselben GPUs — was dazu führt, dass teure Hochleistungs-GPUs entweder im Prefill ausgelastet oder im Decode unterbeschäftigt sind. Nvidia Dynamo trennt diese Phasen: Prefill-GPUs und Decode-GPUs können unabhängig skaliert und optimiert werden. Das Ergebnis laut unabhängigen Benchmarks: bis zu 15-fach höherer Durchsatz auf NVIDIA GB200-Systemen im Vergleich zu klassischen Setups.

2. LLM-Aware Router

Der intelligente Router von Dynamo ist KV-Cache-bewusst: Er leitet eingehende Anfragen bevorzugt an den Worker weiter, der bereits den passenden KV-Cache für diesen Kontext gespeichert hat. Das klingt simpel, hat aber massive Auswirkungen: Baseten ( https://www.baseten.co/ ) berichtet von 2-fach schnellerer Time-to-First-Token (TTFT) durch diese optimierte Weiterleitung — weil teure Prefill-Berechnungen einfach nicht wiederholt werden müssen.

3. Mehrstufiges KV-Cache-Management (KVBM)

GPU-VRAM ist teuer und begrenzt. Nvidia Dynamo ermöglicht ein hierarchisches KV-Cache-Offloading:

- GPU-VRAM (schnellste Zugriffe)

- → CPU-RAM (Host Memory)

- → Lokale NVMe SSDs

- → Netzwerkspeicher / S3 / Azure Blob

Das erweitert den effektiven Kontextspeicher dramatisch und macht sehr lange Kontexte (über 100.000 Token) auch auf Systemen mit begrenztem VRAM handhabbar.

4. GPU Planner (SLA-gesteuertes Autoscaling)

Der Planner überwacht die GPU-Auslastung in Echtzeit und skaliert automatisch Prefill- und Decode-Worker nach Bedarf. Entscheidend: Er kennt die definierten Service Level Objectives (SLOs) — also maximale Latenz und minimaler Durchsatz — und skaliert kosteneffizient, ohne GPU-Ressourcen zu verschwenden. Alibaba berichtet von 80% weniger SLA-Verletzungen bei 5% niedrigerem TCO nach der Einführung von Dynamo.

5. NIXL (Low-Latency Communication Library)

NIXL ist die interne Kommunikationsbibliothek von Dynamo, die schnellen Datentransfer zwischen GPUs, CPUs, Netzwerkkomponenten und Massenspeicher ermöglicht. Dell hat durch die Integration von NIXL mit PowerScale-Speicher eine 19-fach schnellere Time-to-First-Token erzielt.

6. AIConfigurator

Welche Prefill-Decode-Aufteilung ist optimal für mein Modell, mein GPU-Budget und meine Latenzanforderungen? Der AIConfigurator simuliert über 10.000 Konfigurationen in Sekunden und empfiehlt die beste Deployment-Strategie — ohne dass man selbst GPU-Stunden für Experimente verbrennen muss.

7. Grove (Kubernetes-Operator)

Grove ist der Kubernetes-Operator von Dynamo und ermöglicht topologie-bewusstes Scheduling: Er weiß, welche GPUs per NVLink verbunden sind, welche über PCIe kommunizieren und welche auf verschiedenen Rack-Ebenen liegen — und platziert Workloads entsprechend optimal. Das ist besonders relevant für Setups mit NVIDIA GB200 NVL72-Systemen, wo 72 GPUs direkt über NVLink verbunden sind.

8. ModelExpress (Schneller Kaltstart)

Ein häufig unterschätztes Problem: Wenn ein neuer Worker-Node hochfährt, muss er die Modellgewichte laden — bei einem 70B-Modell mehrere hundert Gigabyte. ModelExpress überträgt die Gewichte GPU-zu-GPU über NIXL/NVLink und erreicht damit einen 7-fach schnelleren Kaltstart gegenüber klassischem Laden vom Speicher.

Unterstützte Backends

Nvidia Dynamo ist Backend-agnostisch und unterstützt alle wichtigen Inferenz-Engines:

- SGLang — Disaggregiertes Serving, KV-Aware Routing, SLA-Planner, Multimodal

- vLLM — Vollständige Feature-Unterstützung inkl. KV Block Manager

- NVIDIA TensorRT-LLM — Vollständige Feature-Unterstützung

- PyTorch — Für Custom-Modelle und Experimente

Wer heute vLLM betreibt, kann Dynamo als Orchestrierungsschicht darüber legen — ohne vLLM selbst zu ersetzen.

Praxiserfahrung: So setzen wir Nvidia Dynamo bei Biteno ein

Bei Biteno betreiben wir seit einigen Wochen eine produktive Nvidia Dynamo-Infrastruktur. Hier ist unsere konkrete Architektur:

Unsere Infrastruktur (7 LLM-Hosts)

Das Fundament sind 7 dedizierte LLM-Hosts mit GPU-Ausstattung, auf denen die eigentliche KI-Inferenz läuft. Nvidia Dynamo übernimmt die Koordination: intelligentes Request-Routing, KV-Cache-Management und dynamische Lastverteilung zwischen den Nodes.

Hochverfügbare Frontend-Schicht mit Pacemaker & Corosync

Ein kritischer Aspekt, den viele bei KI-Infrastruktur vergessen: die Hochverfügbarkeit der Frontend-Schicht. Bei uns laufen 3 Frontend-Hosts in einem klassischen Linux-HA-Cluster mit Pacemaker und Corosync. Das bedeutet:

- Fällt ein Frontend-Host aus, übernimmt automatisch ein anderer die virtuelle IP

- Kein Single Point of Failure im Request-Eingang

- Seamless Failover für alle Client-Anwendungen

- Dynamo selbst läuft als Ressource im Pacemaker-Cluster

Das ist nicht trivial — die Integration von Dynamos Service Discovery mit Pacemaker erfordert etwas Handarbeit, aber es funktioniert stabil.

Redundante Modellspeicherung mit GlusterFS

LLM-Modelle sind groß: Ein 70B-Modell in FP16 belegt rund 140 GB, in FP8 immerhin noch 70 GB. Wenn man diese Daten nur auf einem einzigen Server speichert, ist das ein erhebliches Risiko. Unsere Lösung: GlusterFS als verteiltes Dateisystem über alle Nodes hinweg.

- Alle Modell-Gewichte liegen repliziert auf mehreren Nodes

- Fällt ein Storage-Node aus, sind alle Modelle weiterhin verfügbar

- Neue LLM-Hosts mounten das GlusterFS-Volume und haben sofort Zugriff auf alle Modelle

- Kein manuelles Kopieren von Modellen beim Hinzufügen neuer Nodes

In Kombination mit ModelExpress (Dynamos schnellem Kaltstart-Mechanismus) sorgt das dafür, dass neue Worker-Nodes in akzeptabler Zeit einsatzbereit sind.

Fazit aus dem Produktivbetrieb

Nvidia Dynamo ist nicht einfach — das müssen wir klar sagen. Die Installation ist aufwendig, die Konfiguration hat Lernkurven, und die Integration von HA-Clustering (Pacemaker/Corosync) mit Dynamos Service Discovery braucht Zeit. Aber das Ergebnis ist außerordentlich: Wir können Modelle koordiniert über alle 7 LLM-Hosts verteilen, haben keine echten Ausfälle mehr durch die redundante Frontend-Schicht und wissen, dass unsere Modell-Daten durch GlusterFS sicher sind. Wer ernsthaft LLMs on-premise betreiben will, kommt an Nvidia Dynamo kaum vorbei.

Installation: So startet man mit Nvidia Dynamo

Für erste Experimente auf einem einzelnen System (Single-Node) ist der Einstieg überraschend einfach:

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

docker run --gpus all --network host --rm -it \

nvcr.io/nvidia/ai-dynamo/sglang-runtime:1.1.0

# Im Container: Frontend und Worker starten

python3 -m dynamo.frontend --http-port 8000 --discovery-backend file &

python3 -m dynamo.sglang --model-path Qwen/Qwen3-0.6B --discovery-backend file &

# Anfrage senden (OpenAI-kompatible API)

curl -s localhost:8000/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "Qwen/Qwen3-0.6B",

"messages": [{"role": "user", "content": "Hello!"}],

"max_tokens": 100

}'

Die API ist vollständig OpenAI-kompatibel — bestehende Anwendungen können ohne Code-Änderungen umgestellt werden. Alternativ zur Container-Variante lässt sich Dynamo auch per pip installieren:

2

3

# oder für vLLM:

uv pip install --prerelease=allow "ai-dynamo[vllm]"

Für Multi-Node-Produktivbetrieb empfiehlt sich die Kubernetes-basierte Dynamo Platform mit dem Grove-Operator — dann lässt sich ein gesamtes Deployment mit einer einzigen YAML-Datei beschreiben.

Nvidia Dynamo vs. klassischer vLLM-Betrieb: Die wichtigsten Unterschiede

- Single-Node vs. Multi-Node: vLLM optimiert einen Node, Dynamo koordiniert viele

- Stateless vs. KV-aware: Standard-Load-Balancer verteilt rein nach Last, Dynamo kennt KV-Cache-Überlappung

- Feste Ressourcen vs. dynamisches Scaling: Dynamo skaliert Prefill- und Decode-Pools unabhängig nach SLOs

- Manuelles Routing vs. Orchestrierung: Dynamo ersetzt selbstgebaute Orchestrierungsskripte durch ein produktionsreifes Framework

Benchmarks und reale Ergebnisse

- 7× höherer Durchsatz pro GPU — DeepSeek-R1 auf GB200 NVL72 mit Dynamo vs. B200 ohne (SemiAnalysis InferenceX)

- 750× höherer Durchsatz — DeepSeek-R1 auf GB300 NVL72 (InferenceXv2)

- 2× schnellere TTFT — KV-Aware Routing, Qwen3-Coder 480B (Baseten)

- 10× schnellere Inferenz — Mistral Large 3 auf GB200 NVL72 (Mistral AI)

- 10× schnellere Inferenz — Kimi K2 auf GB200 (Moonshot AI)

- 80% weniger SLA-Verletzungen bei 5% niedrigerem TCO (Alibaba)

- 19× schnellere TTFT — Dell PowerScale + NIXL (Dell Technologies)

Wer sollte Nvidia Dynamo einsetzen?

Nvidia Dynamo ist die richtige Wahl, wenn:

- Sie LLMs auf mehreren GPUs oder Nodes koordinieren müssen

- Sie KV-Cache-Routing brauchen, um redundante Berechnungen zu vermeiden

- Sie Prefill und Decode unabhängig skalieren wollen

- Sie automatisches Scaling mit definierten Latenz-SLAs benötigen

- Sie eine produktionsreife, supportierte Lösung wollen (NVIDIA AI Enterprise)

Wenn Sie ein einzelnes Modell auf einer einzigen GPU betreiben, reicht weiterhin eine klassische Inferenz-Engine (vLLM, SGLang) ohne Dynamo aus.

Fazit: Nvidia Dynamo ist das Betriebssystem der KI-Infrastruktur

NVIDIA selbst bezeichnet Dynamo als das „Betriebssystem der KI“ — und das ist keine Übertreibung. Genauso wie ein Betriebssystem die Komplexität von Hardware abstrahiert und koordiniert, abstrahiert Dynamo die Komplexität verteilter GPU-Cluster für KI-Inferenz.

Für Unternehmen, die ernsthaft Large Language Models on-premise betreiben wollen — mit Hochverfügbarkeit, Effizienz und der Skalierbarkeit, um mit wachsenden Modellen Schritt zu halten — ist Nvidia Dynamo heute die stärkste Open-Source-Lösung am Markt. Die Lernkurve ist real, aber die Ergebnisse sprechen für sich.

Haben Sie Fragen zu einer eigenen KI-Inferenz-Infrastruktur mit Nvidia Dynamo? Als IT-Dienstleister aus Stuttgart unterstützen wir Sie gerne bei Konzeption, Aufbau und Betrieb — sprechen Sie uns an.