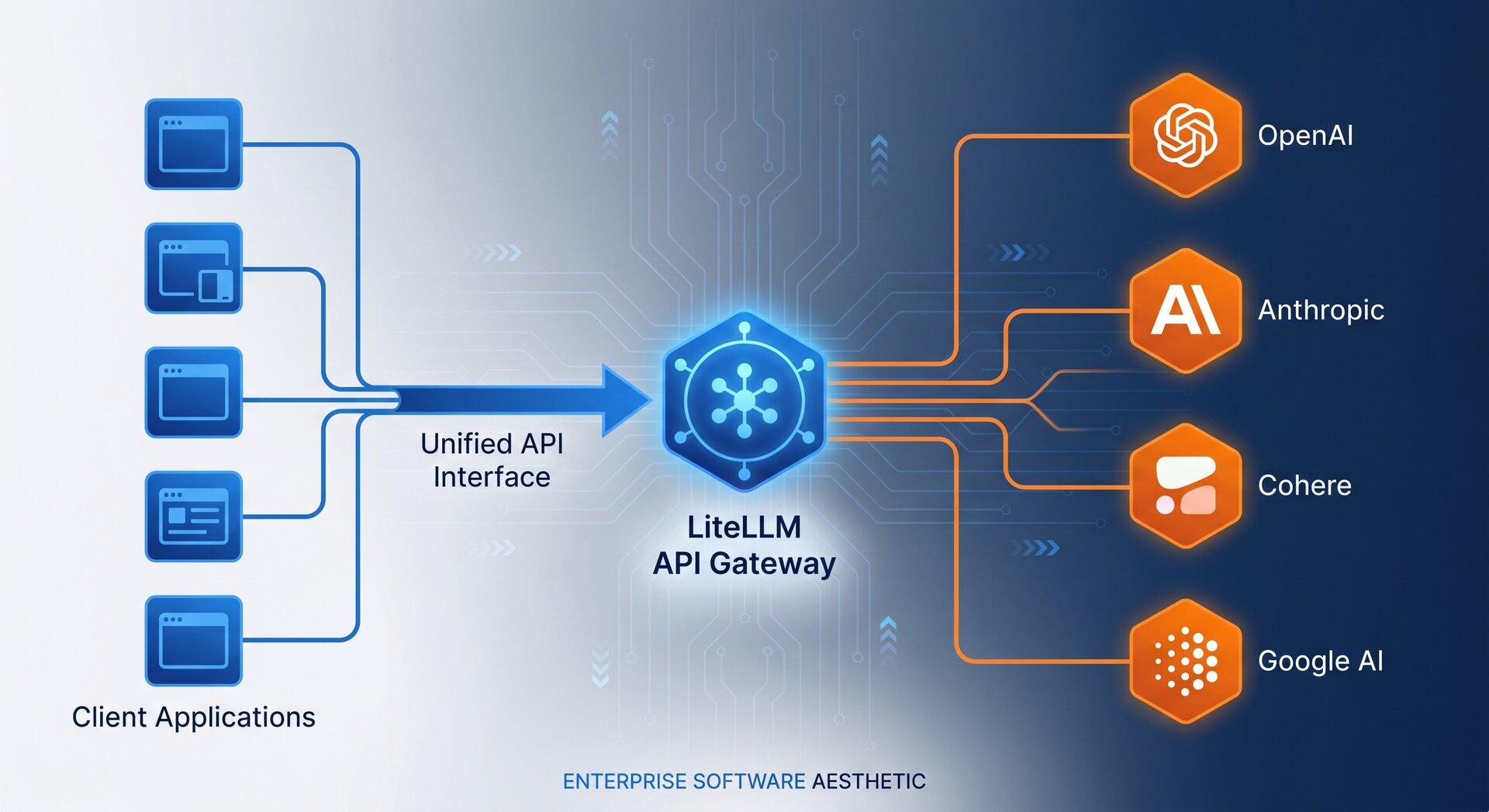

Unternehmen, die Künstliche Intelligenz in ihre Prozesse integrieren möchten, stehen vor einer Herausforderung: Die verschiedenen KI-Modelle nutzen unterschiedliche APIs und Schnittstellen. OpenAI bietet eine Programmierschnittstelle an, Anthropic eine andere, Google wieder eine ganz eigene Lösung. Möchten Sie das Modell wechseln, müssen Sie den Code Ihrer Anwendungen anpassen – ein zeitaufwändiger und fehleranfälliger Prozess. LiteLLM löst dieses Problem elegant: Der Open-Source-Proxy bietet eine einheitliche Schnittstelle für über 100 verschiedene KI-Anbieter. In diesem Artikel erklären wir Ihnen, was LiteLLM ist, wie es funktioniert und warum es sich besonders für Unternehmenseinsatz eignet.

Was ist LiteLLM?

LiteLLM ist ein Open-Source-API-Proxy und LLM-Gateway, das Entwicklern und Unternehmen eine einheitliche Schnittstelle zu über 100 verschiedenen KI-Modellanbietern bietet. Das Projekt wurde von BerriAI entwickelt und ist auf GitHub unter dem Namen BerriAI/litellm öffentlich verfügbar. Die Kernidee ist simpel, aber effektiv: Statt dass Ihre Anwendungen direkt mit den APIs von OpenAI, Anthropic oder Google kommunizieren, sprechen sie mit LiteLLM – und LiteLLM kümmert sich um die Übersetzung zu den jeweiligen Anbietern.

LiteLLM bietet zwei Hauptbetriebsmodi: Zum einen das Python SDK, das Entwickler direkt in ihre Anwendungen integrieren können. Zum anderen den Proxy-Server, der sich besonders für Team-Einsatz und Unternehmensumgebungen eignet. Der Proxy-Server läuft als eigenständiger Dienst und bietet eine OpenAI-kompatible REST-API, gegen die alle Ihre Anwendungen sprechen können. Diese Architektur ermöglicht es, das KI-Modell zentral zu verwalten, ohne Code-Änderungen in den einzelnen Anwendungen vornehmen zu müssen.

Warum LiteLLM? Die sechs Kernfunktionen im Überblick

LiteLLM überzeugt durch eine Vielzahl von Funktionen, die den Betrieb von KI-Anwendungen im Unternehmenskontext deutlich vereinfachen. Hier sind die sechs wichtigsten:

1. Unified API – Ein Code für alle Modelle

Mit LiteLLM schreiben Sie Ihren Code einmal und können nahtlos zwischen verschiedenen KI-Modellen wechseln. Ob OpenAI GPT-4, Anthropic Claude, Google Gemini oder selbst gehostete Modelle – der Code bleibt identisch. LiteLLM übersetzt die Anfragen in das jeweilige Format des Anbieters. Das reduziert den Vendor-Lock-in erheblich und gibt Ihnen die Freiheit, das für Ihren Anwendungsfall beste Modell zu wählen.

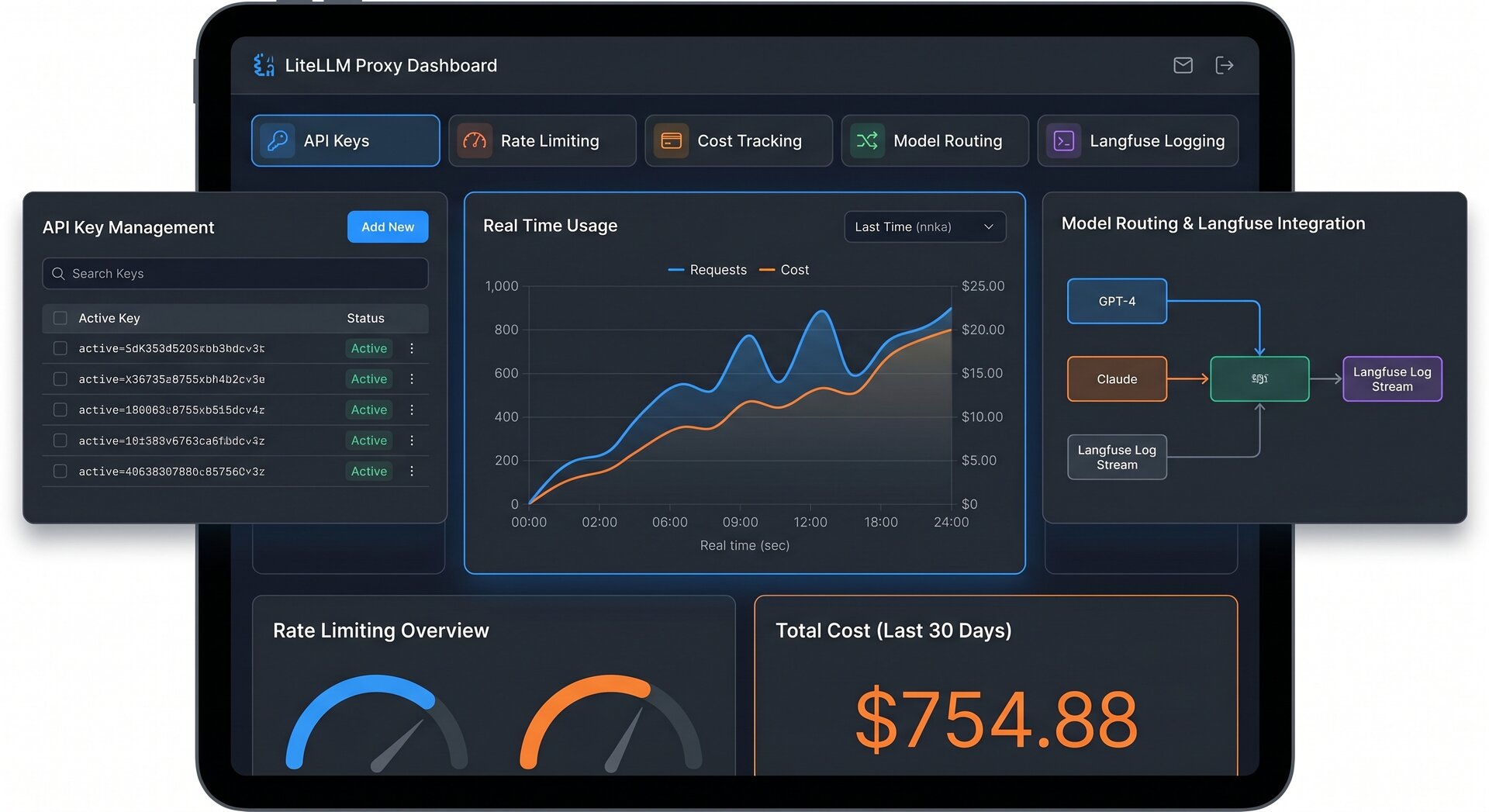

2. API-Key-Management mit Budgets und Limits

LiteLLM ermöglicht die Erstellung virtueller API-Schlüssel mit individuellen Budgets und Rate-Limits. Sie können beispielsweise für jedes Team oder jede Anwendung separate Keys erstellen und deren monatliche Ausgaben begrenzen. Das verhindert Überraschungen auf der nächsten Cloud-Rechnung und gibt Ihnen volle Kontrolle über die KI-Nutzung in Ihrem Unternehmen.

3. Rate Limiting – Schutz vor Überlastung

Durch konfigurierbare Rate-Limits schützen Sie sich vor unkontrollierten Kosten und API-Überlastungen. LiteLLM kann Anfragen drosseln oder in Warteschlangen einreihen, wenn bestimmte Schwellenwerte erreicht werden. Das ist besonders wichtig bei öffentlich zugänglichen Anwendungen oder bei internen Tools mit vielen Nutzern.

4. Modell-Aliase – Abstraktion der Infrastruktur

Mit Modell-Aliasen können Sie interne Bezeichnungen wie „gpt-4“ auf beliebige Modelle abbilden – auch auf selbst gehostete Open-Source-Varianten. Ein Aufruf an „gpt-4“ kann intern beispielsweise auf ein lokales Llama-3-Modell über Ollama oder einen vLLM-Server weitergeleitet werden. Ihre Anwendungen merken davon nichts, die Änderung erfolgt zentral in der LiteLLM-Konfiguration.

5. Load Balancing und Fallback

LiteLLM unterstützt die Verteilung von Anfragen auf mehrere Endpunkte sowie automatische Fallback-Mechanismen. Wenn ein Anbieter ausfällt oder langsam reagiert, wird die Anfrage automatisch an einen Alternativ-Endpunkt weitergeleitet. Das erhöht die Verfügbarkeit Ihrer KI-Anwendungen deutlich und ermöglicht High-Availability-Setups ohne komplexe eigene Entwicklung.

6. Observability – Logging und Monitoring

Jede Anfrage durch LiteLLM kann protokolliert werden – inklusive Modell, verwendete Tokens, Latenz, Kosten und Nutzer-Informationen. Die Integration mit Tools wie Langfuse, Prometheus, Datadog oder anderen Monitoring-Lösungen gibt Ihnen vollständige Transparenz über Ihre KI-Nutzung. Das ist nicht nur für die Kostenkontrolle wichtig, sondern auch für Compliance-Anforderungen in regulierten Branchen.

LiteLLM als Proxy-Server für Teams

Der Proxy-Server ist das Herzstück für den Unternehmenseinsatz von LiteLLM. Er wird typischerweise als Docker-Container betrieben und stellt eine OpenAI-kompatible API auf einem definierbaren Port bereit. Die Konfiguration erfolgt über eine YAML-Datei, in der Sie Ihre Modelle, API-Keys und Regeln definieren.

Hier ein Beispiel für eine

1 | litellm_config.<a class="wpil_keyword_link" title="Was ist YAML? Einfach erklärt." href="https://www.biteno.com/was-ist-yaml/" target="_blank" rel="noopener" data-wpil-keyword-link="linked" data-wpil-monitor-id="6244">yaml</a> |

2

3

4

5

6

7

8

9

10

11

12

13

14

- model_name: gpt-4

litellm_params:

model: ollama/llama3

api_base: http://localhost:11434

- model_name: claude-3

litellm_params:

model: anthropic/claude-opus-4-7

api_key: os.environ/ANTHROPIC_API_KEY

- model_name: azure-gpt

litellm_params:

model: azure/gpt-4

api_base: https://my-resource.openai.azure.com

api_key: os.environ/AZURE_API_KEY

Nach dem Start steht Ihnen eine Swagger-UI zur Verfügung, die die API-Dokumentation und Testmöglichkeiten bietet. Anwendungen können nun gegen

1 | http://localhost:4000 |

Unterstützte Anbieter und Modelle

LiteLLM unterstützt eine beeindruckende Vielfalt an KI-Anbietern und Modellen. Hier eine Auswahl der wichtigsten:

Cloud-Provider:

- OpenAI (GPT-4, GPT-3.5, DALL-E, Whisper)

- Anthropic (Claude 3 Opus, Sonnet, Haiku)

- Google Vertex AI (Gemini, PaLM)

- Azure OpenAI Service

- AWS Bedrock

- Cohere, Mistral AI, Groq und viele weitere

Lokale und Open-Source-Modelle:

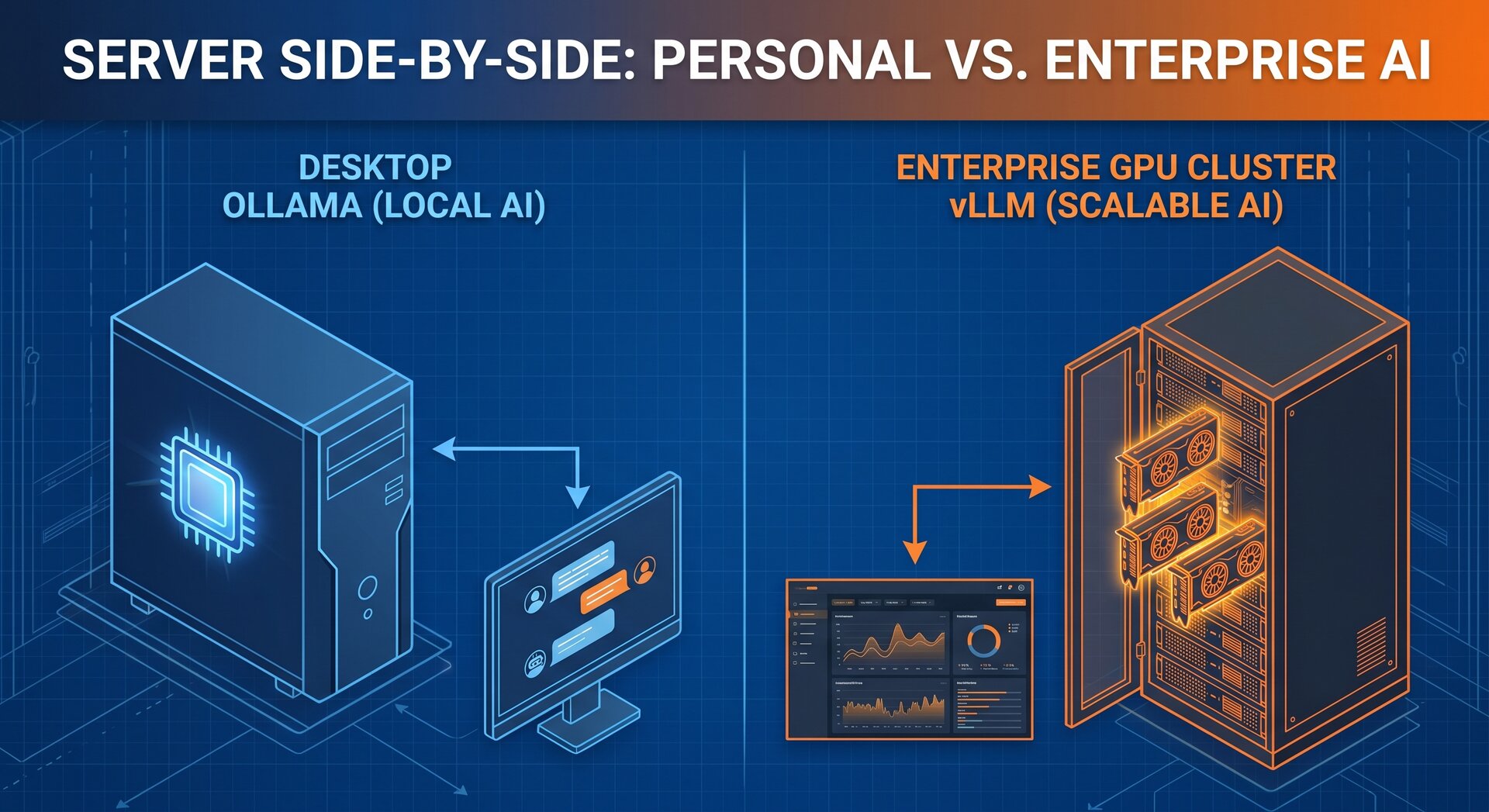

- Ollama – für lokale Modellausführung

- vLLM – Hochleistungs-Inferenz-Engine

- SGLang – Programmierframework für LLMs

- Nvidia Dynamo – Enterprise-Inferenz-Plattform

- HuggingFace Transformers

- LM Studio und weitere lokale Endpunkte

Diese Breite Unterstützung macht LiteLLM zu einer zukunftssicheren Wahl, da Sie jederzeit zwischen Anbietern wechseln oder hybride Setups aus Cloud und eigenen Servern betreiben können.

LiteLLM und Langfuse: Vollständiges Monitoring

Für Unternehmen ist Transparenz über KI-Nutzung essenziell. LiteLLM integriert sich nahtlos mit Langfuse, einer Open-Source-Plattform für LLM-Observability. Jede Anfrage wird protokolliert: Welches Modell wurde verwendet? Wie viele Tokens wurden verbraucht? Was waren die Kosten? Wie hoch war die Latenz? Wer hat die Anfrage gestellt?

Diese Daten ermöglichen eine präzise Kostenkontrolle pro Abteilung oder Anwendung. Sie können sehen, welche Teams wie viel für KI ausgeben und Budgets entsprechend anpassen. Für Unternehmen in regulierten Branchen bietet Langfuse zudem Audit-Trails und die Nachvollziehbarkeit aller KI-Interaktionen – eine wichtige Grundlage für Compliance-Anforderungen.

Praxisbeispiel: LiteLLM bei Biteno

Bei der Biteno GmbH setzen wir LiteLLM als zentralen Gateway für unsere gesamte KI-Infrastruktur ein. Alle internen Anwendungen – sei es n8n für Automatisierungen, RAG-Systeme für Wissensmanagement, Code-Assistenten oder der Open WebUI-basierte Webchat – sprechen OpenAI-kompatibel gegen unseren LiteLLM-Proxy.

Die Konfiguration sieht dabei wie folgt aus: LiteLLM verwaltet alle API-Schlüssel zentral, definiert Modell-Aliase und setzt Rate-Limits für verschiedene Nutzergruppen. Das Logging läuft über Langfuse, sodass wir jederzeit nachvollziehen können, welche Anwendungen welche Modelle nutzen und welche Kosten entstehen. Hinter LiteLLM betreiben wir einen Nvidia Dynamo-Cluster mit vLLM und SGLang für die eigentliche Modellausführung.

Der entscheidende Vorteil: Wenn wir ein Modell wechseln möchten – beispielsweise von einem Cloud-Provider auf ein selbst gehostetes Modell oder umgekehrt – müssen wir keine einzige Zeile Code in unseren Anwendungen ändern. Die Anpassung erfolgt ausschließlich in der LiteLLM-Konfiguration. Das spart Entwicklungszeit und reduziert das Risiko von Fehlern erheblich.

LiteLLM im Vergleich zu Alternativen

Wie schneidet LiteLLM im Vergleich zu anderen Lösungen ab?

Im Vergleich zu direkter API-Integration: Ohne LiteLLM müssen Sie für jeden Anbieter separate Integrationen pflegen und bei einem Wechsel den Code anpassen. LiteLLM abstrahiert diese Komplexität und reduziert den Vendor-Lock-in erheblich.

Im Vergleich zu OpenRouter: OpenRouter ist ein kommerzieller Aggregator-Dienst, der ähnliche Funktionen bietet. LiteLLM bietet jedoch den Vorteil der Self-Hosting-Option: Ihre Daten verlassen nicht Ihre Infrastruktur, und Sie haben volle Kontrolle über Konfiguration, Logging und Sicherheit.

Im Vergleich zu einem eigenen Proxy: Ein selbst entwickelter Proxy mag auf den ersten Blick attraktiv erscheinen, bindet jedoch Entwicklungsressourcen und erfordert kontinuierliche Wartung. LiteLLM ist ein ausgereiftes, aktiv gepflegtes Open-Source-Projekt mit einer grossen Community und spart Ihnen erhebliche Entwicklungszeit.

Schnellstart mit LiteLLM

Der Einstieg in LiteLLM ist denkbar einfach. Für einen ersten Test mit einem lokalen Modell über Ollama genügen wenige Befehle:

2

3

4

5

6

7

8

9

pip install litellm

# Start mit lokalem Ollama-Modell

litellm --model ollama/llama3 --port 4000

# Oder als OpenAI-kompatibler Proxy

export OPENAI_API_KEY="sk-..."

litellm --model gpt-4 --port 4000

Nach dem Start steht Ihnen eine OpenAI-kompatible API auf Port 4000 zur Verfügung. Sie können nun beliebige Anwendungen dagegen testen, die die OpenAI-API unterstützen.

Für den produktiven Einsatz empfehlen sich Docker-Deployment und die YAML-basierte Konfiguration. Die offizielle Dokumentation bietet umfassende Anleitungen für verschiedene Deployment-Szenarien, inklusive Kubernetes-Integration und High-Availability-Setups.

Fazit: LiteLLM als strategische Infrastrukturkomponente

LiteLLM ist weit mehr als nur ein technisches Hilfsmittel – es ist eine strategische Infrastrukturkomponente für Unternehmen, die Künstliche Intelligenz produktiv einsetzen möchten. Die Abstraktion der verschiedenen KI-APIs, das zentrale API-Key-Management, die Budgetkontrolle und die umfassende Observability machen LiteLLM zur idealen Lösung für den Enterprise-Einsatz.

Besonders überzeugend ist die Flexibilität: Sie bleiben unabhängig von einzelnen Anbietern, können jederzeit zwischen Modellen wechseln und sowohl Cloud- als auch On-Premise-Modelle in einer einheitlichen Architektur betreiben. Die Integration mit Tools wie Langfuse gibt Ihnen zudem die Transparenz und Kontrolle, die für professionellen KI-Betrieb unerlässlich sind.

Möchten auch Sie LiteLLM in Ihrer Infrastruktur evaluieren oder benötigen Sie Unterstützung beim Aufbau einer Enterprise-KI-Umgebung? Unser Team berät Sie gerne. Kontaktieren Sie uns für ein unverbindliches Gespräch über Ihre Anforderungen.