KI-Agenten versprechen Automatisierung, Effizienzgewinne und neue Geschäftsmodelle. Doch während IT-Verantwortliche sich mit Modellauswahl, API-Integration und Prompt Engineering beschäftigen, lauert die größte Gefahr an anderer Stelle: Datenschutz und Compliance. Ein falsch konfigurierter KI-Agent kann binnen Sekunden personenbezogene Daten an Server in den USA übertragen – und damit einen DSGVO-Verstoß auslösen, der das Unternehmen Millionen kosten kann.

Die gute Nachricht: Die größten Risiken bei KI-Agenten sind nicht technischer, sondern regulatorischer Natur – und lösbar, wenn man die richtigen Fragen stellt. In diesem Leitfaden zeigen wir Ihnen, welche DSGVO-Fallstricke bei Cloud-KI, lokalem Hosting und ISO-Zertifizierungen wirklich relevant sind – und wie Sie KI-Agenten rechtskonform in Ihr Unternehmen integrieren und wie Sie den KI-Agenten DSGVO konform betreiben.

1. Die DSGVO-Fallstricke bei Cloud-KI (OpenAI, Anthropic, Google)

Warum Cloud-KI datenschutzrechtlich heikel ist

Die meisten KI-Agenten nutzen Cloud-APIs von OpenAI (ChatGPT, GPT-4), Anthropic (Claude) oder Google (Gemini). Diese Dienste bieten State-of-the-Art-Modelle – aber zu welchem Preis?

Problem 1: Datenübertragung in Drittländer

Sobald ein KI-Agent personenbezogene Daten (Namen, E-Mail-Adressen, Vertragsinhalte) an eine Cloud-API sendet, verlassen diese Daten Ihr Unternehmen. Bei den meisten US-amerikanischen Anbietern bedeutet das:

- Datenverarbeitung auf Servern außerhalb der EU (oft USA, Irland oder Singapur)

- Kein gleichwertiges Datenschutzniveau wie in der EU (siehe Schrems-II-Urteil)

- Möglicher Zugriff durch US-Behörden (CLOUD Act, FISA 702)

Die DSGVO fordert in Art. 44 ff. besondere Garantien für Drittlandstransfers. Ein einfacher AV-Vertrag reicht nicht aus – Sie benötigen Standardvertragsklauseln (SCC) plus zusätzliche technische Maßnahmen (z. B. Verschlüsselung, Anonymisierung).

Problem 2: Zweckbindung und Modelltraining

Viele Cloud-Anbieter haben ihre Nutzungsbedingungen nachgebessert, aber Vorsicht bei den Details:

- OpenAI: Enterprise-Kunden können das Training mit ihren Daten deaktivieren (Data Retention Policy). Bei kostenlosen/Standardaccounts ist das nicht garantiert.

- Google Gemini: Google nutzt Nutzerdaten zur Verbesserung seiner Dienste – auch wenn das mittlerweile für zahlende Kunden ausgeschlossen werden kann.

- Anthropic: Claude verspricht standardmäßig keine Nutzung von Kundendaten für Training.

IT-Verantwortliche müssen prüfen:

- Gibt es einen expliziten Opt-out für Modelltraining?

- Werden Chat-Logs und Prompts dauerhaft gespeichert?

- Wie lange werden Daten aufbewahrt (Aufbewahrungspflicht vs. Löschfristen)?

Problem 3: Auftragsverarbeitungsvertrag (AVV) fehlt oder ist unzureichend

Die DSGVO verlangt in Art. 28, dass Sie mit jedem Dienstleister, der personenbezogene Daten verarbeitet, einen AVV abschließen. Cloud-KI-Anbieter stellen zwar AVV-Templates bereit – aber diese sind oft:

- Einseitig formuliert (wenig Haftung auf Anbieterseite)

- Nicht auf deutsche Rechtslage angepasst (z. B. fehlen Regelungen zu Subauftragsverarbeitern)

- Unklar bei Subprozessoren (Google nutzt Hunderte Subunternehmen – welche genau?)

Empfehlung: Lassen Sie den AVV von einem Datenschutzbeauftragten oder Fachanwalt prüfen. Insbesondere bei sensiblen Daten (§ 203 StGB, Berufsgeheimnis) ist höchste Vorsicht geboten.

2. Was bedeutet „Hosting in Deutschland“ wirklich?

Das Missverständnis: Server-Standort ≠ Datenschutz

Viele Anbieter werben mit „Hosting in Deutschland“ oder „EU-Datenzentren“. Das klingt nach DSGVO-Konformität – ist aber nur die halbe Wahrheit.

Was „deutsches Hosting“ NICHT automatisch bedeutet:

Kein Zugriff durch US-Muttergesellschaft

- Wenn ein US-Unternehmen (z. B. Google, Microsoft, AWS) eine deutsche Tochter betreibt, können US-Behörden unter dem CLOUD Act trotzdem Zugriff auf Daten fordern.

- Ausnahme: Echte Datentreuhänderschaft (z. B. T-Systems als Treuhänder für Microsoft Cloud Deutschland – mittlerweile eingestellt).

Keine automatische Rechtmäßigkeit der Verarbeitung

- Selbst wenn Daten in Deutschland liegen: Fehlt die Rechtsgrundlage (z. B. Einwilligung, berechtigtes Interesse), ist die Verarbeitung illegal.

Kein Schutz vor Subauftragsverarbeitern in Drittländern

- Ein deutscher Server kann Daten an ausländische Analysedienste, CDNs oder Support-Teams weiterleiten.

Was „Hosting in Deutschland“ hingegen bietet:

- Geringeres Risiko bei Datenpannen (dt. Aufsichtsbehörden sind zuständig, keine internationalen Rechtsstreits)

- Kürzere Latenzzeiten (relevant für Echtzeit-KI-Agenten)

- Politische Signalwirkung (wichtig für Kunden im öffentlichen Sektor, Gesundheitswesen, Finanzbranche)

Entscheidend ist die Frage:

- Wo liegt die Datenhoheit? (technisch + rechtlich)

- Wer kann auf die Daten zugreifen? (Anbieter, Subunternehmer, Behörden)

- Welche Verschlüsselung wird eingesetzt? (Transport, Speicher, Ende-zu-Ende)

Mehr dazu lesen Sie in unserem Beitrag Cloud-Strategie für mittelständische IT-Infrastrukturen.

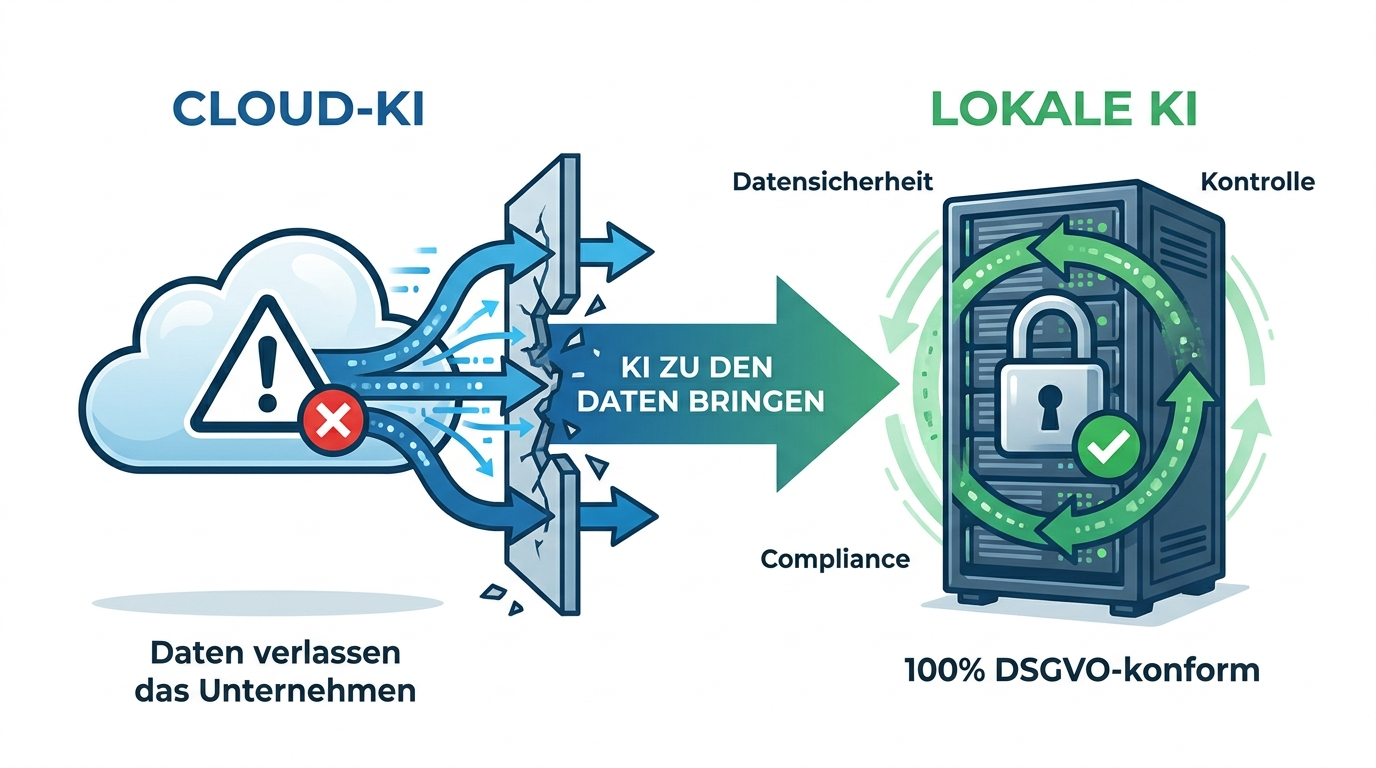

3. Lokale Modelle vs. Cloud-Modelle: Ein ehrlicher Vergleich

Die Wahrheit über On-Premise-KI

Lokale KI-Modelle (z. B. Llama 3, Mistral, Falcon) versprechen volle Datenkontrolle. Doch lohnt sich der Aufwand wirklich? Hier eine ehrliche Gegenüberstellung:

| Kriterium | Cloud-KI (GPT-4, Claude, Gemini) | Lokale Modelle (Llama 3, Mistral) |

|---|---|---|

| Datenschutz | ⚠️ Datenübertragung an Drittanbieter | ✅ Vollständige Kontrolle über Daten |

| Performance | ✅ State-of-the-Art (GPT-4, Claude 3) | ⚠️ Schlechter bei komplexen Aufgaben |

| Kosten | 💰 Pay-per-Token (planbar, aber skaliert) | 💰💰 Hohe Infrastrukturkosten (GPU-Server) |

| Wartung | ✅ Keine (SaaS) | ⚠️ Hoher Admin-Aufwand (Updates, Monitoring) |

| Latenz | ⚠️ Abhängig von Internetverbindung | ✅ Schnell (lokales Netzwerk) |

| Compliance | ⚠️ AVV + Drittlandtransfer erforderlich | ✅ Einfacher DSGVO-konform |

| Skalierbarkeit | ✅ Unbegrenzt | ⚠️ Hardwarelimitiert |

Wann lohnt sich ein lokales Modell?

✅ Ja, wenn:

- Sie mit hochsensiblen Daten arbeiten (Gesundheit, Finanzen, Anwaltskanzleien)

- Sie hohe Volumen verarbeiten (Kostenersparnis ab ~10.000 API-Calls/Monat)

- Sie Offline-Betrieb benötigen (Produktionsumgebungen ohne Internetanbindung)

- Sie spezielle Finetuning-Anforderungen haben

❌ Nein, wenn:

- Sie maximale Modellqualität brauchen (GPT-4 ist aktuell überlegen)

- Sie keine dedizierte GPU-Infrastruktur haben (NVIDIA A100/H100 kostet 10.000–50.000 €)

- Ihr IT-Team keine ML-Ops-Erfahrung hat

Hybrid-Ansatz: Das Beste aus beiden Welten

Viele Unternehmen nutzen eine Zwei-Stufen-Architektur:

- Datenvorbereitung & Anonymisierung lokal (z. B. Entfernen von PII, Pseudonymisierung)

- Verarbeitung in der Cloud (nur anonymisierte Daten an GPT-4/Claude)

- Ergebnisse zurück on-premise (Deanonymisierung, Ausgabe an Nutzer)

Technische Umsetzung:

- Regex-basierte PII-Filterung

- Named Entity Recognition (NER) zur Erkennung personenbezogener Daten

- Tokenisierung & Hashing vor Cloud-Upload

4. ISO 27001 und was sie für KI-Agenten bedeutet

Warum ISO 27001 kein Datenschutz-Allheilmittel ist

Viele Anbieter werben mit ISO 27001-Zertifizierung als Qualitätsmerkmal. Doch was sagt diese Norm wirklich aus?

ISO 27001 im Überblick:

- Was es ist: Internationale Norm für Informationssicherheits-Managementsysteme (ISMS)

- Was es prüft: Prozesse, Risikoanalyse, Notfallpläne, Zugangskontrollen

- Was es NICHT prüft: Rechtmäßigkeit der Datenverarbeitung nach DSGVO

Wichtig: ISO 27001 ist ein technisch-organisatorisches Framework, kein Datenschutz-Zertifikat. Ein Unternehmen kann ISO-zertifiziert sein und trotzdem gegen die DSGVO verstoßen.

Was ISO 27001 für KI-Agenten bedeutet:

✅ Positive Signale:

- Dokumentierte Sicherheitsmaßnahmen (Verschlüsselung, Backups, Zugriffskontrollen)

- Regelmäßige Audits durch unabhängige Prüfer

- Incident-Response-Pläne bei Datenpannen

⚠️ Was fehlt:

- Keine Aussage über Datenhoheit (Server-Standort, Subauftragsverarbeiter)

- Keine Garantie für DSGVO-Konformität (z. B. Drittlandtransfers)

- Keine Prüfung der AVV-Qualität

Welche Zertifikate sind DSGVO-relevanter?

| Zertifikat | Relevanz für KI-Agenten |

|---|---|

| ISO 27001 | ✅ Gute Basis (technische Sicherheit) |

| ISO 27701 | ✅✅ Datenschutz-Erweiterung von 27001 (Privacy Information Management) |

| BSI C5 | ✅✅ Deutscher Cloud-Standard (sehr streng, öffentlicher Sektor) |

| SOC 2 Type II | ⚠️ US-Standard (schwächer als ISO, aber oft verwendet) |

| CSA STAR | ⚠️ Cloud-spezifisch, aber nicht DSGVO-fokussiert |

Empfehlung: Achten Sie auf ISO 27701 oder BSI C5 – diese gehen deutlich über ISO 27001 hinaus und adressieren Datenschutz explizit.

5. Checkliste: 10 Fragen an jeden KI-Anbieter

Bevor Sie einen KI-Agenten produktiv einsetzen, sollten Sie diese Fragen klären:

- Wo werden die Daten physisch gespeichert und verarbeitet?

EU/EWR? Drittland? Mehrere Standorte? Gibt es Datentreuhänderschaft? - Werden meine Daten für Modelltraining verwendet?

Opt-out möglich? Wie lange werden Prompts/Logs gespeichert? - Welche Subauftragsverarbeiter nutzen Sie?

Liste abrufbar? Werden diese regelmäßig überprüft? Liegen diese in Drittländern? - Wie ist die Verschlüsselung geregelt?

Transport (TLS 1.3)? Speicherung (AES-256)? Ende-zu-Ende-Verschlüsselung möglich? - Gibt es einen AVV nach Art. 28 DSGVO?

In deutscher Sprache? Regelungen zu Subprozessoren? Haftungsklauseln? - Welche Zertifizierungen haben Sie?

ISO 27001? ISO 27701? BSI C5? SOC 2? Wann wurde zuletzt auditiert? - Wie werden Betroffenenrechte umgesetzt?

Löschung (Art. 17 DSGVO)? Auskunft (Art. 15 DSGVO)? Datenübertragbarkeit (Art. 20 DSGVO)? - Was passiert bei einem Datenschutzvorfall?

Meldung innerhalb 72 Stunden (Art. 33 DSGVO)? Incident-Response-Plan vorhanden? - Kann ich eine Datenschutz-Folgenabschätzung (DSFA) durchführen?

Unterstützt der Anbieter bei DSFA? Gibt es vorgefertigte Templates? - Wie sieht die Exit-Strategie aus?

Datenrückgabe bei Vertragsende? Formatierung (JSON, CSV, Datenbank-Dump)? Löschbestätigung?

Fazit: KI-Agenten DSGVO-Konformität ist kein Hindernis – sondern ein Wettbewerbsvorteil

KI-Agenten sind keine rechtliche Grauzone mehr. Die DSGVO gibt klare Rahmenbedingungen vor – und wer diese ernst nimmt, schafft Vertrauen bei Kunden, Partnern und Aufsichtsbehörden.

Die wichtigsten Erkenntnisse:

- Cloud-KI ist nicht per se illegal – aber Sie müssen AVV, Drittlandtransfer und Zweckbindung sauber dokumentieren.

- „Hosting in Deutschland“ allein reicht nicht – entscheidend ist die Datenhoheit und die Kontrolle über Subauftragsverarbeiter.

- Lokale Modelle sind kein Selbstzweck – der Hybrid-Ansatz (Anonymisierung + Cloud) ist oft praktikabler.

- ISO 27001 ist gut, ISO 27701 ist besser – achten Sie auf datenschutzspezifische Zertifizierungen.

- Stellen Sie die richtigen Fragen – unsere 10-Punkte-Checkliste hilft Ihnen, KI-Anbieter zu bewerten.

Jetzt handeln: Biteno IT-Sicherheitscheck für Ihre KI-Strategie

Sie planen den Einsatz von KI-Agenten in Ihrem Unternehmen – und wollen sicherstellen, dass Datenschutz und Compliance von Anfang an stimmen?

Unser IT-Sicherheitscheck umfasst:

- ✅ DSGVO-Risikoanalyse für Ihre geplante KI-Lösung

- ✅ Bewertung von Cloud- vs. On-Premise-Szenarien

- ✅ Prüfung von AVV, Zertifikaten und Datenschutz-Folgenabschätzung

- ✅ Konkrete Handlungsempfehlungen (technisch + rechtlich)

Kontaktieren Sie uns für ein unverbindliches Erstgespräch:

📧 kontakt@biteno.com

📞 +49 (0)123 456789

Mehr über unsere Leistungen: Biteno IT-Sicherheitsberatung

Quellen & Trust-Links:

- Bundesamt für Sicherheit in der Informationstechnik (BSI): IT-Grundschutz für Cloud-Dienste

- Bundesbeauftragter für Datenschutz und Informationsfreiheit (BfDI): Orientierungshilfe Künstliche Intelligenz und Datenschutz