Google hat am 7. April 2026 mit Gemma 4 den nächsten Evolutionsschritt seiner Open-Source-KI-Modellfamilie vollzogen. Das Release markiert einen Wendepunkt für Entwickler und Unternehmen, die leistungsstarke Künstliche Intelligenz direkt auf ihren Geräten nutzen möchten – ohne Abhängigkeit von Cloud-Infrastrukturen oder teuren Server-Farmen.

Die neue Generation überzeugt nicht nur durch beeindruckende Benchmark-Ergebnisse, sondern setzt vor allem auf Zugänglichkeit und Effizienz. Mit vier spezialisierten Modellvarianten deckt Gemma 4 Anwendungsfälle von Smartphones bis hin zu High-Performance-Servern ab. Wir analysieren, was das neue Modell leistet, für wen es besonders interessant ist und wie es sich gegen die Konkurrenz behauptet.

Die strategische Bedeutung: Warum Open Source 2026 gewinnt

Lange Zeit galt das Paradigma: „Closed AI“ für Qualität, „Open AI“ für Experimente. Mit Gemma 4 bricht Google dieses Dogma endgültig. Die Entscheidung, diese Modelle unter der Apache 2.0-Lizenz zu veröffentlichen, ist kein Akt der Nächstenliebe, sondern eine kühle strategische Kalkulation.

Die Befreiung von der API-Abhängigkeit

Unternehmen haben in den vergangenen zwei Jahren schmerzhaft gelernt, dass eine vollständige Abhängigkeit von proprietären APIs (wie denen von OpenAI oder Anthropic) Risiken birgt. Preisänderungen, Ausfallzeiten oder Änderungen in der Zensur-Logik können Geschäftsmodelle über Nacht gefährden.

Gemma 4 bietet hier den Ausweg:

-

Vollständige Kontrolle: Sie besitzen das Modell. Sie entscheiden, wann und wie Sie es updaten.

-

Kostenkontrolle: Statt „Pay-per-Token“ treten fixe Infrastrukturkosten. Bei hohen Volumina amortisiert sich die eigene Hardware innerhalb weniger Monate.

-

Datenschutz-Compliance: Da keine Daten das interne Netzwerk verlassen, werden die strengen Anforderungen des EU AI Acts und der DSGVO nativ erfüllt.

Was ist Gemma 4? Die grundlegende Architektur

Gemma 4 ist eine Familie von Open-Source-Sprachmodellen, die Google unter der Apache 2.0-Lizenz veröffentlicht hat. Diese Lizenzwahl ist strategisch bedeutsam: Sie ermöglicht Unternehmen und Entwicklern die kommerzielle Nutzung, Modifikation und Verteilung der Modelle ohne die restriktiven Auflagen anderer Lizenzen.

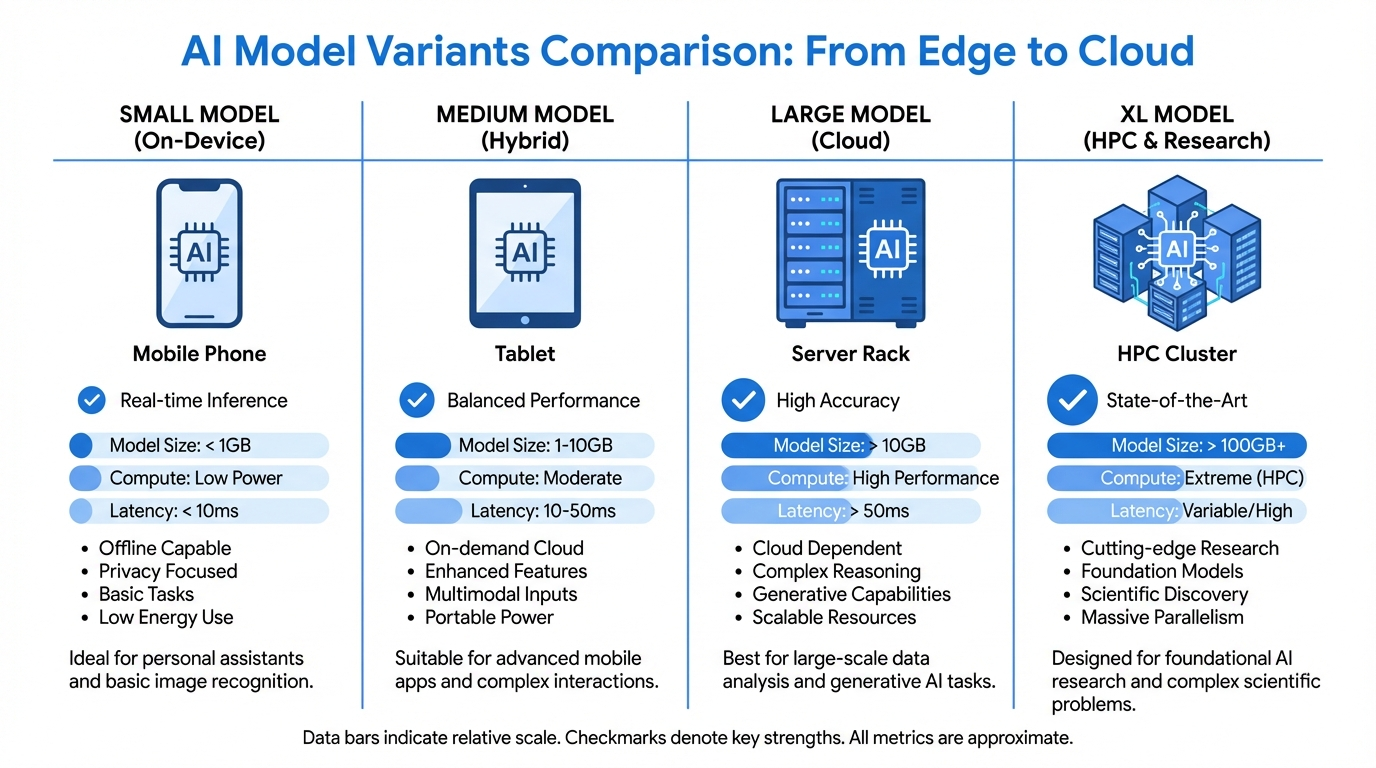

Die vier Modellvarianten im Überblick

Google positioniert Gemma 4 als vielseitige Werkzeugkiste mit vier spezialisierten Varianten:

| Modell | Parameter | Kontextfenster | Primärer Einsatzzweck |

|---|---|---|---|

| E2B (Effective 2B) | 2 Milliarden | 128K Tokens | Mobile Geräte, IoT, Edge-Computing |

| E4B (Effective 4B) | 4 Milliarden | 128K Tokens | Smartphones, Tablets, lokale Assistenz |

| 26B MoE | 26 Milliarden (3.8B aktiv) | 256K Tokens | Enterprise-Anwendungen, Agenten-Workflows |

| 31B Dense | 31 Milliarden | 256K Tokens | Hochleistungs-Anwendungen, komplexes Reasoning |

Die Revolution der „Effective“-Serie (E2B & E4B)

Früher waren 2-Milliarden-Parameter-Modelle kaum mehr als glorifizierte Autovervollständigungen. Gemma 4 E2B nutzt jedoch eine neue Form der iterativen Destillation. Dabei lernt das kleine Modell direkt von den „Gedankengängen“ (Chain-of-Thought) der größten Gemini-Modelle.

Das Ergebnis ist verblüffend: Ein E2B-Modell erzielt heute Ergebnisse in Logik-Tests, für die man 2024 noch ein Modell mit 70 Milliarden Parametern benötigt hätte. Die Integration in die AICore-Schnittstelle von Android 16 und modernen Linux-Kerneln ermöglicht eine Hardware-Beschleunigung, die die Latenz unter die menschliche Wahrnehmungsschwelle drückt.

Das 26B MoE: Effizienz durch Spezialisierung

Das Mixture of Experts (MoE)-Prinzip ist vergleichbar mit einem Team aus Spezialisten. Anstatt dass ein einzelner Generalist jede Frage beantwortet, verfügt das Modell über acht „Experten-Netzwerke“. Pro Anfrage werden nur die zwei relevantesten aktiviert. Dies führt dazu, dass das Modell zwar das Wissen von 26 Milliarden Parametern besitzt, aber nur die Rechenkraft (und damit den Stromverbrauch) eines 3,8-Milliarden-Modells beansprucht. Dies ist der „Sweet Spot“ für Enterprise-Anwendungen.

Technologische Durchbrüche: Was Gemma 4 besonders macht

Ein entscheidender Unterschied zu den Vorgängern ist, dass Gemma 4 nicht „blind“ ist. Multimodalität wurde nicht nachträglich hinzugefügt (Plug-in-Ansatz), sondern ist Teil der DNA des Modells.

Visuelle Intelligenz auf dem Gerät

Die Modelle können Bilder und Videos in variablen Auflösungen verarbeiten. Dies ist besonders wichtig für:

-

Industrielle Inspektion: Eine Drohne kann mit Gemma 4 E4B ausgestattet werden, um Risse in Brückenpfeilern in Echtzeit zu identifizieren – ohne Funkverbindung.

-

Barrierefreiheit: Blinde Menschen können sich ihre Umgebung via Smartphone-Kamera in natürlicher Sprache beschreiben lassen, inklusive der Analyse komplexer Emotionen in Gesichtern oder der Lesung von Speisekarten.

-

UI-Agenten: Die KI kann verstehen, was auf einem Bildschirm passiert. Sie kann Formulare ausfüllen, Software-Bugs finden oder komplexe Workflows in ERP-Systemen automatisieren, indem sie die grafische Benutzeroberfläche wie ein Mensch „sieht“.

Audio-Native Verarbeitung (E-Serie)

Die kleinsten Varianten von Gemma 4 verfügen über einen dedizierten Audio-Encoder. Sie verstehen nicht nur die Wörter (Transkription), sondern auch den Tonfall, Pausen und Emotionen. Ein Sprachassistent auf Basis von Gemma 4 erkennt, ob ein Nutzer gestresst, glücklich oder sarkastisch ist, und passt seine Antwort entsprechend an.

Advanced Reasoning und Agentic Workflows

Einer der größten Kritikpunkte an Open-Source-Modellen war lange Zeit ihre Schwäche bei komplexen logischen Schlussfolgerungen. Gemma 4 adressiert dies durch zwei innovative Ansätze:

Eingebautes Chain-of-Thought (CoT)

Gemma 4 wurde darauf trainiert, Probleme systematisch anzugehen. Wenn Sie das Modell fragen: „Wie wirkt sich eine Zinserhöhung um 0,5 % auf unsere Immobilien-Leasingverträge in Südspanien aus?“, plappert das Modell nicht einfach los. Es aktiviert intern einen Denkmodus, prüft die Zusammenhänge und liefert eine strukturierte Analyse.

Agentic Workflows & Function Calling

Gemma 4 ist darauf ausgelegt, ein Handelnder zu sein, nicht nur ein Sprecher. Dank des optimierten Native Function Calling kann das Modell sicher mit externen Programmen interagieren.

-

Beispiel: Ein Nutzer sagt: „Erstelle eine Zusammenfassung der letzten drei Kundenreklamationen und schicke sie als Slack-Nachricht an das Support-Team.“

-

Gemma 4 versteht die Absicht, ruft die Datenbank auf, filtert die Reklamationen, verfasst die Zusammenfassung und triggert die Slack-API – alles lokal und sicher.

Gemma 4 ist von Grundauf für Reasoning-AI und agentische Workflows konzipiert. Die Modelle unterstützen kognitive KI-Prozesse mit eingebauten Chain-of-Thought-Fähigkeiten und konfigurierbaren Denkmodi.

Die größeren Varianten (26B und 31B) erzielen herausragende Platzierungen auf dem Arena AI Text Leaderboard: Das 31B-Modell rangiert aktuell auf Platz 3 unter den Open-Source-Modellen, das 26B-Modell auf Platz 6. Besonders beeindruckend: Gemma 4 übertrifft in einigen Disziplinen Modelle, die 20-mal so groß sind.

Multimodale Intelligenz: Text, Bild, Video und Audio

Ein herausragendes Merkmal der Gemma-4-Familie ist die native Multimodalität. Alle Modelle verarbeiten Bilder und Video in variablen Seitenverhältnissen und Auflösungen. Die Fähigkeiten umfassen:

- Objekterkennung und -lokalisierung

- Dokumentenanalyse und OCR

- Handschrifterkennung

- Diagramm- und Chart-Verständnis

- Screen-Understanding für UI-Automation

Die E2B- und E4B-Modelle gehen einen Schritt weiter und unterstützen zusätzlich Audio-Input für Spracherkennung und -verarbeitung. Das macht sie ideal für Sprachassistenten und Echtzeit-Übersetzungsanwendungen auf mobilen Endgeräten.

Erweiterte Kontextfenster für komplexe Aufgaben

Die Kontextfenster von Gemma 4 haben sich deutlich vergrößert:

- E2B & E4B: 128K Tokens – ausreichend für lange Dokumente und Konversationen

- 26B & 31B: 256K Tokens – ermöglicht die Verarbeitung ganzer Codebases, umfangreicher Rechtsdokumente oder wissenschaftlicher Arbeiten in einem einzigen Prompt

Diese erweiterte Kontextkapazität ist entscheidend für Enterprise-Anwendungen, bei denen das Modell umfangreiche Unternehmensdokumentationen oder komplexe Projekthistorien berücksichtigen muss.

Entwicklerfreundliche Features

Google hat Gemma 4 mit Fokus auf praktische Entwickleranforderungen gestaltet:

- Native Function Calling: Direkte Integration mit APIs und externen Tools

- Strukturierter JSON-Output: Zuverlässige Datenextraktion und -verarbeitung

- System Instructions: Präzise Steuerung des Modellverhaltens für spezifische Anwendungsfälle

Diese Features machen Gemma 4 besonders attraktiv für den Aufbau von Software-Agenten und automatisierten Workflow-Systemen.

Benchmarks: Die harte Prüfung

Die Leistungsfähigkeit von KI-Modellen zeigt sich in standardisierten Benchmarks. Gemma 4 liefert hier ein gemischtes, aber insgesamt starkes Bild:

Stärken von Gemma 4

| Benchmark | Gemma 4 Ergebnis | Bewertung |

|---|---|---|

| IFEval | 90,2% | Hervorragendes Sprachverständnis |

| GSM8k | 89,2% | Starke Mathematik-Fähigkeiten |

| MMLU | 82% | Solides Allgemeinwissen |

Besonders bei der Instruktionsbefolgung (IFEval) glänzt Gemma 4 mit 90,2%. Das zeigt, wie präzise das Modell komplexe Anweisungen umsetzen kann – eine kritische Fähigkeit für produktive Enterprise-Anwendungen.

Vergleich mit der Konkurrenz

Im direkten Benchmark-Vergleich mit Mistral Large 2026 zeigt sich ein klares Bild:

| Benchmark | Gemma 4 | Mistral Large 2026 |

|---|---|---|

| MATH | 75,6% | 90,4% |

| MMLU | 82% | 82% |

| GPQA | 65% | 85% |

| LiveCodeBench | 70% | 88% |

Benchmark-Vergleich: Gemma 4 vs. Mitbewerber

Mistral Large 2026 dominiert bei komplexen Reasoning-Aufgaben und Coding – nicht zuletzt dank seiner massiven 675-Milliarden-Parameter-Architektur (davon 41B aktiv). Allerdings kommt diese Leistung mit deutlich höheren Rechenanforderungen.

Das Fazit: Gemma 4 priorisiert Effizienz und Zugänglichkeit gegenüber maximalem Reasoning-Potenzial. Für den Einsatz auf Edge-Geräten oder in ressourcenbeschränkten Umgebungen ist es die überlegene Wahl.

Edge-Optimierung: KI überall und jederzeit

Der vielleicht revolutionärste Aspekt von Gemma 4 ist seine Edge-Optimierung. Die E2B- und E4B-Modelle bringen echte KI-Intelligenz direkt auf Endgeräte:

Praxisbeispiele für On-Device-KI

- Smartphone-Assistenz: Vollständig offline funktionierende Sprachassistenten ohne Cloud-Abhängigkeit

- IoT-Integration: Intelligente Sensoren, die lokal entscheiden können

- Industrielle Automatisierung: Echtzeit-Qualitätskontrolle an Produktionslinien

- Medizinische Diagnostik: Lokale Bildanalyse für Datenschutz-sensible Anwendungen

Die Latenz liegt bei unter 50 Millisekunden auf modernen Smartphones – für den Nutzer fühlt sich die Interaktion instantan an.

Sprachunterstützung

Mit Training auf über 140 Sprachen ist Gemma 4 truly multilingual. Das unterscheidet es von vielen Modellen, die primär auf Englisch optimiert sind. Für globale Unternehmen ist dies ein entscheidender Vorteil.

Das Kontextfenster: Ein Gedächtnis wie ein Elefant

Die Erweiterung des Kontextfensters auf bis zu 256.000 Tokens (ca. 500 DIN-A4-Seiten) verändert die Art und Weise, wie wir mit Dokumenten arbeiten.

„Das Kontextfenster ist der Arbeitsspeicher der KI. Ein größeres Fenster bedeutet, dass die KI nicht nur die letzte Seite versteht, sondern das gesamte Buch.“

Anwendungsfälle für Long-Context

-

Juristische Analysen: Laden Sie einen kompletten Satz an Prozessakten hoch. Gemma 4 findet Widersprüche in Zeugenaussagen, die Monate auseinanderliegen.

-

Software-Engineering: Ein Entwickler kann eine komplette Codebase in das Modell laden. Gemma 4 versteht die Abhängigkeiten zwischen verschiedenen Modulen und schlägt Refactorings vor, die das gesamte System berücksichtigen, nicht nur eine einzelne Funktion.

-

Wissenschaftliche Forschung: Die KI kann hunderte von Paper-Abstracts gleichzeitig analysieren, um Korrelationen zwischen verschiedenen Studien zu finden.

Praktische Anwendungsfälle für Unternehmen

Gemma 4 ist die Antwort auf die Frage: „Wie hole ich die KI aus der Cloud in mein Unternehmen?“ Es ist ein robustes, effizientes und hochgradig anpassbares Werkzeugset.

Für wen ist Gemma 4 der Gamechanger?

-

CIOs, die ihre IT-Kosten skalierbar halten müssen.

-

Produktentwickler, die intelligente Funktionen in Hardware integrieren wollen.

-

Datenschutzbeauftragte, die keine Kompromisse bei der Sicherheit eingehen können.

-

Startups, die auf Basis von State-of-the-Art-Technologie innovieren wollen, ohne durch Lizenzkosten erdrückt zu werden.

Die Demokratisierung der KI ist kein Schlagwort mehr – sie findet auf den Prozessoren weltweit statt. Mit Gemma 4 hat Google die Einstiegshürden für die nächste industrielle Revolution massiv gesenkt.

Wie können Organisationen Gemma 4 konkret nutzen? Hier sind die vielversprechendsten Einsatzszenarien:

1. Automatisierung von Dokumenten-Workflows

Die Kombination aus OCR, Dokumentenverständnis und strukturiertem JSON-Output macht Gemma 4 ideal für:

- Automatische Rechnungsverarbeitung

- Vertragschecks und Compliance-Prüfungen

- Wissensmanagement-Systeme

2. Kundenservice-Automatisierung

Mit Multimodalität und Function Calling lassen sich intelligente Chatbots bauen, die:

- Screenshots von Fehlermeldungen verstehen

- Direkt im CRM-System Aktionen ausführen

- Komplexe Probleme in mehrstufigen Dialogen lösen

3. Software-Entwicklung

Die starken Coding-Benchmarks (LiveCodeBench) und das riesige Kontextfenster unterstützen:

- Code-Review und Refactoring

- Dokumentationsgenerierung

- Debugging-Assistenz über ganze Codebases

4. Qualitätssicherung

In Verbindung mit Vision-Fähigkeiten:

- Automatisierte visuelle Inspektion

- Fehlererkennung in Produktionsprozessen

- Brand-Compliance-Checks für Marketing-Materialien

Fazit: Für wen lohnt sich Gemma 4?

Gemma 4 ist kein Universal-Werkzeug, sondern eine gezielte Lösung für spezifische Anforderungen. Das Modell ist die richtige Wahl, wenn:

- Datenschutz priorisiert wird – lokale Verarbeitung ohne Cloud-Transfer

- Latenz kritisch ist – Echtzeit-Anwendungen ohne Netzwerk-Roundtrips

- Kosten reduziert werden sollen – keine Inference-Kosten pro Token

- Offline-Funktionalität benötigt wird – Remote-Standorte, mobile Anwendungen

- Ressourcen begrenzt sind – Edge-Geräte, IoT, mobile Plattformen

Für reines High-End-Reasoning bei maximaler Rechenpower bleiben größere Modelle wie Mistral Large oder proprietäre Lösungen von Vorteil. Aber für den breiten Einsatz von KI in der Praxis – von der Smartphone-App bis zum Industrie-Roboter – eröffnet Gemma 4 neue Möglichkeiten.

Die Verfügbarkeit auf Hugging Face und die umfassende Dokumentation bei Google AI machen den Einstieg erfreulich einfach. Wer heute mit der Entwicklung beginnt, baut auf einer Technologie, die das Potenzial hat, KI-Integration im Enterprise-Umfeld zu demokratisieren.