Warum immer mehr Unternehmen KI selbst hosten

Der Trend ist unübersehbar: Im Jahr 2026 entscheiden sich immer mehr Unternehmen dafür, KI selbst hosten zu wollen. Die Gründe sind vielfältig, aber sie haben alle einen gemeinsamen Nenner – Kontrolle. Kontrolle über Daten, Kosten und Technologie. In einer Zeit, in der Daten als wichtigste Ressource gelten und Datenschutz regulatorisch immer strenger wird, ist diese Kontrolle strategisch unverzichtbar geworden.

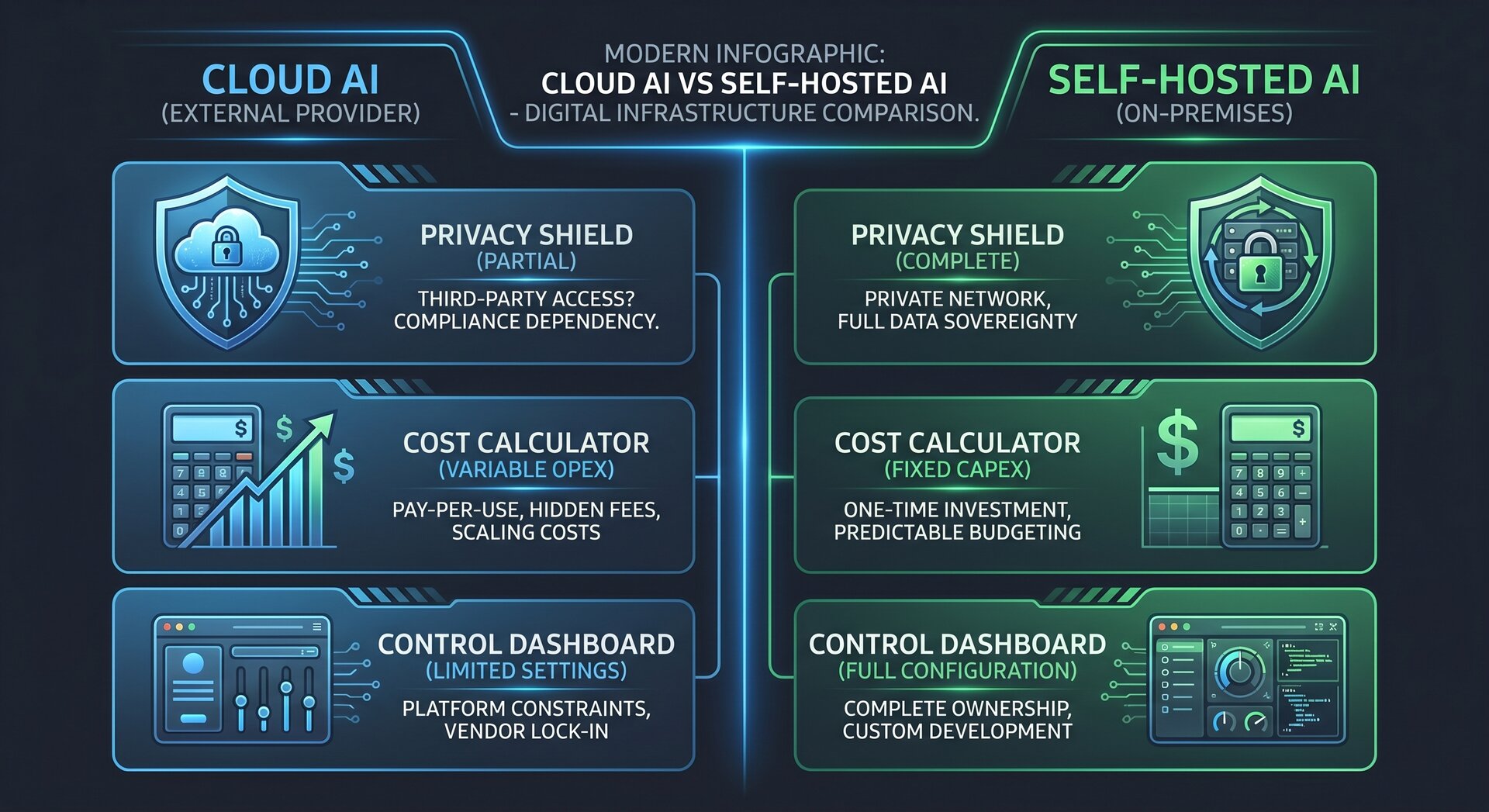

Wenn Sie KI-Anwendungen in Ihrem Unternehmen einführen möchten, stehen Sie vor einer fundamentalen Entscheidung: Cloud-APIs von Anbietern wie OpenAI oder Google nutzen – oder die Infrastruktur selbst betreiben. Dieser Artikel zeigt Ihnen, was KI selbst hosten bedeutet, welche Vorteile es bietet und was Sie dafür benötigen.

Was bedeutet „KI selbst hosten“?

KI selbst hosten bedeutet, Large Language Models (LLMs) und andere KI-Modelle auf eigener Hardware oder gemieteten Servern zu betreiben – statt über Cloud-APIs auf fremde Infrastruktur zuzugreifen. Die Modelle werden lokal ausgeführt, die Datenverarbeitung findet in Ihrer kontrollierten Umgebung statt.

Es gibt dabei zwei grundlegende Varianten:

On-Premise: Die Hardware steht physisch in Ihrem Unternehmen oder einem von Ihnen kontrollierten Rechenzentrum. Das bietet maximale Kontrolle und maximale Datensicherheit. Sie haben physischen Zugriff auf die Server und volle Autonomie über die Infrastruktur.

Dedicated Cloud: Sie mieten dedizierte GPU-Server bei einem deutschen oder europäischen Provider, haben aber volle administrative Kontrolle. Das ist ein Kompromiss zwischen Kontrolle und Flexibilität, der den Betrieb ohne eigene Server-Räume ermöglicht.

Beide Varianten haben gemeinsam: Ihre Daten verlassen niemals Ihre kontrollierte Umgebung. Keine Übertragung zu OpenAI, Google, Anthropic oder anderen Anbietern. Das ist der entscheidende Unterschied zum API-basierten Ansatz.

Warum KI selbst hosten? Die 5 Hauptgründe

1. Datenschutz und DSGVO: Daten verlassen nie das Haus

Das ist der mit Abstand wichtigste Grund für den Einsatz von selbst gehosteter KI. Wenn Sie KI selbst hosten, bleiben Ihre Unternehmensdaten unter Ihrer Kontrolle. Keine Datenübertragung in die USA, keine unsicheren Datenschutzvereinbarungen, keine Abhängigkeit von den Privacy Policies externer Anbieter.

Für Unternehmen in regulierten Branchen – Gesundheitswesen, Finanzdienstleistungen, öffentlicher Sektor, Rechtsberatung – ist das oft die einzige akzeptable Lösung. Patientendaten, Finanzinformationen, personenbezogene Daten – all das kann verarbeitet werden, ohne regulatorische Bedenken. Die DSGVO-Konformität ist bei selbst gehosteter KI deutlich einfacher zu gewährleisten.

2. Keine laufenden API-Kosten

Cloud-KI-APIs kosten pro Token. Bei hohem Nutzungsvolumen werden diese Kosten schnell signifikant. Wenn Sie KI selbst hosten, haben Sie nach der initialen Investition in Hardware keine laufenden Nutzungsgebühren mehr.

Bei einer Nutzung von beispielsweise 10 Millionen Token pro Monat amortisiert sich eine eigene GPU-Infrastruktur typischerweise innerhalb von 12-18 Monaten. Danach profitieren Sie von deutlich niedrigeren Betriebskosten. Das macht selbst gehostete KI besonders attraktiv für Unternehmen mit hohem und vorhersagbarem Nutzungsvolumen.

3. Volle Kontrolle über Modell-Updates

Cloud-Anbieter aktualisieren ihre Modelle nach eigenem Ermessen – manchmal mit verändertem Verhalten. Wenn Sie KI selbst hosten, entscheiden Sie selbst, wann und ob Sie ein Update einspielen.

Das ist besonders wichtig für produktive Systeme, bei denen konsistentes Verhalten essentiell ist. Sie können neue Versionen zuerst in einer Testumgebung evaluieren, bevor Sie sie produktiv schalten. Keine Überraschungen durch plötzlich geänderte Modellantworten.

4. Offline-Fähigkeit und Air-Gap-Umgebungen

In manchen Szenarien ist eine Internetverbindung unerwünscht oder unmöglich. Selbst gehostete KI funktioniert vollständig offline – in abgeschirmten Netzwerken, auf Schiffen, in Produktionsumgebungen ohne externe Konnektivität, in Forschungseinrichtungen mit strikten Sicherheitsanforderungen.

5. Anpassbarkeit: Fine-Tuning und individuelle Prompts

Sie können die Modelle mit Ihren eigenen Daten weitertrainieren (Fine-Tuning), eigene System-Prompts definieren und die gesamte Verarbeitungspipeline nach Ihren Anforderungen anpassen. Die KI wird wirklich „Ihre“ KI – trainiert auf Ihren Daten, optimiert für Ihre Anwendungsfälle, angepasst an Ihre Unternehmenskommunikation.

Was brauche ich? Hardware-Anforderungen

Das wichtigste Element für KI selbst hosten sind leistungsfähige GPUs. Die Anforderungen hängen davon ab, welche Modellgröße Sie betreiben möchten:

| Modellgröße | GPU-Anforderungen | Anwendungsfall |

|---|---|---|

| 7B Parameter | 1× RTX 4070 (12 GB VRAM) | Einfache Textgenerierung, Prototyping |

| 13B Parameter | 1× RTX 4090 (24 GB VRAM) | Bessere Qualität, deutschsprachige Anwendungen |

| 30B Parameter | 2× RTX 4000 Blackwell (48 GB VRAM) | Professioneller Einsatz, komplexe Aufgaben |

| 70B Parameter | 4× A100 40GB oder 2× H100 | Enterprise-Grade, höchste Qualität |

Zusätzliche Anforderungen:

- CPU: Moderne Multi-Core CPU (AMD Ryzen oder Intel Xeon)

- RAM: Mindestens 32 GB, besser 64-128 GB für größere Modelle

- Storage: Schnelle NVMe-SSDs (500 GB – 2 TB je nach Modellanzahl)

- Netzwerk: Gigabit-Ethernet für interne Kommunikation

- Kühlung: Ausreichende Belüftung für GPU-Lastbetrieb

- Stromversorgung: Hochwertiges Netzteil (mindestens 850W für RTX 4090)

Der Software-Stack für den Einstieg

Die richtige Software macht den Unterschied zwischen einem funktionierenden Prototypen und einer produktiven Unternehmenslösung. Hier sind die empfohlenen Stacks für verschiedene Reifegrade:

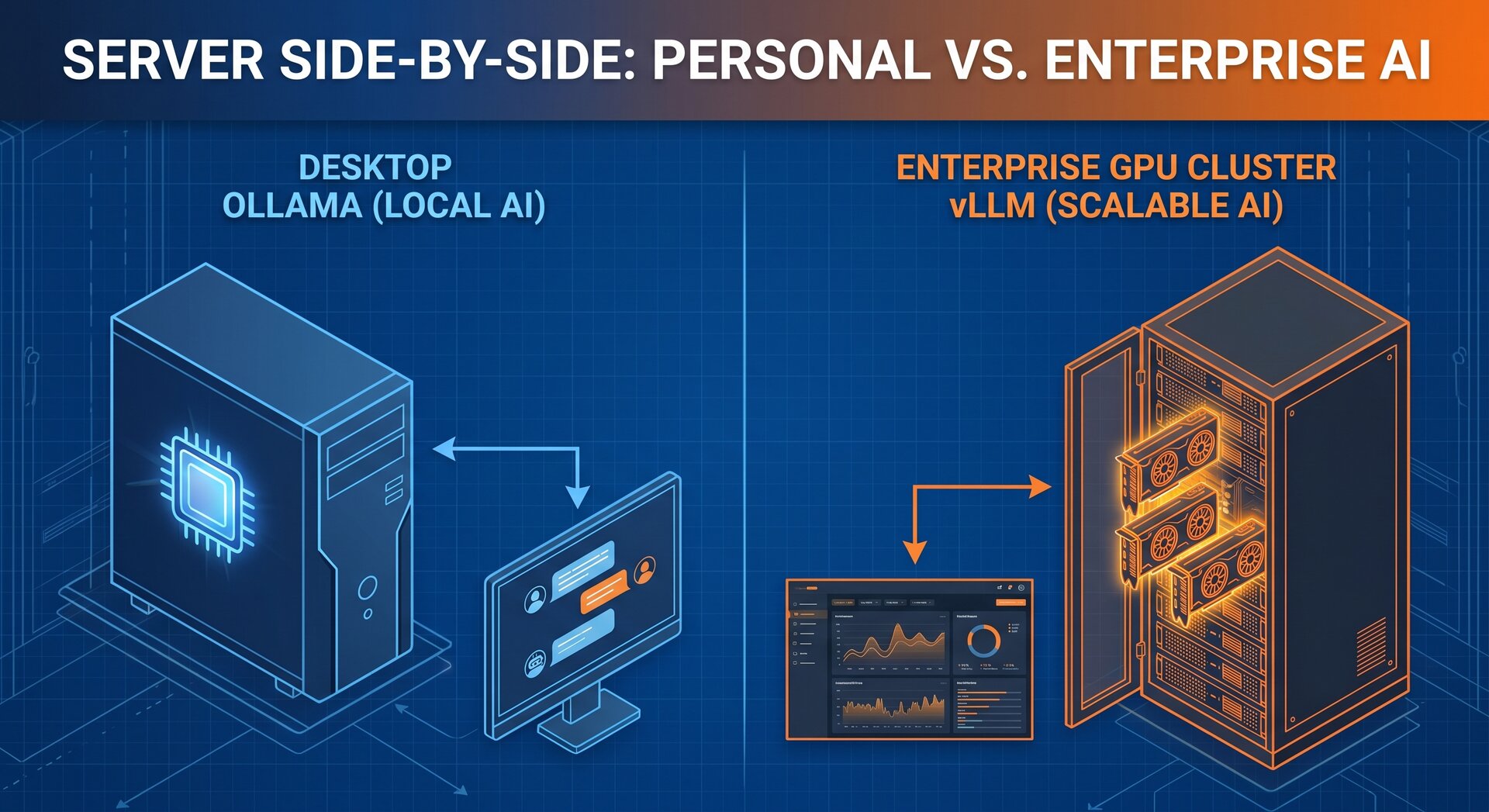

Einfach: Ollama + Open WebUI

Der schnellste Weg, um KI selbst hosten zu testen. Ollama verwaltet Modelle und deren Abhängigkeiten, Open WebUI bietet eine benutzerfreundliche Weboberfläche. Installation in wenigen Minuten, erste Ergebnisse sofort.

Ideal für: Erste Experimente, kleine Teams, interne Prototypen, Proof-of-Concepts

Setup-Zeit: Unter 30 Minuten

Produktion: vLLM + Open WebUI

Wenn Sie ernsthaft KI selbst hosten möchten, ist vLLM die beste Wahl für die Modelldienste. Die optimierte Inference-Engine bietet deutlich höheren Durchsatz und niedrigere Latenz als Ollama. Mehr über vLLM

Ideal für: Produktiver Betrieb, mehrere gleichzeitige Nutzer, API-Integration, Kundenservice-Chatbots

Setup-Zeit: 2-4 Stunden

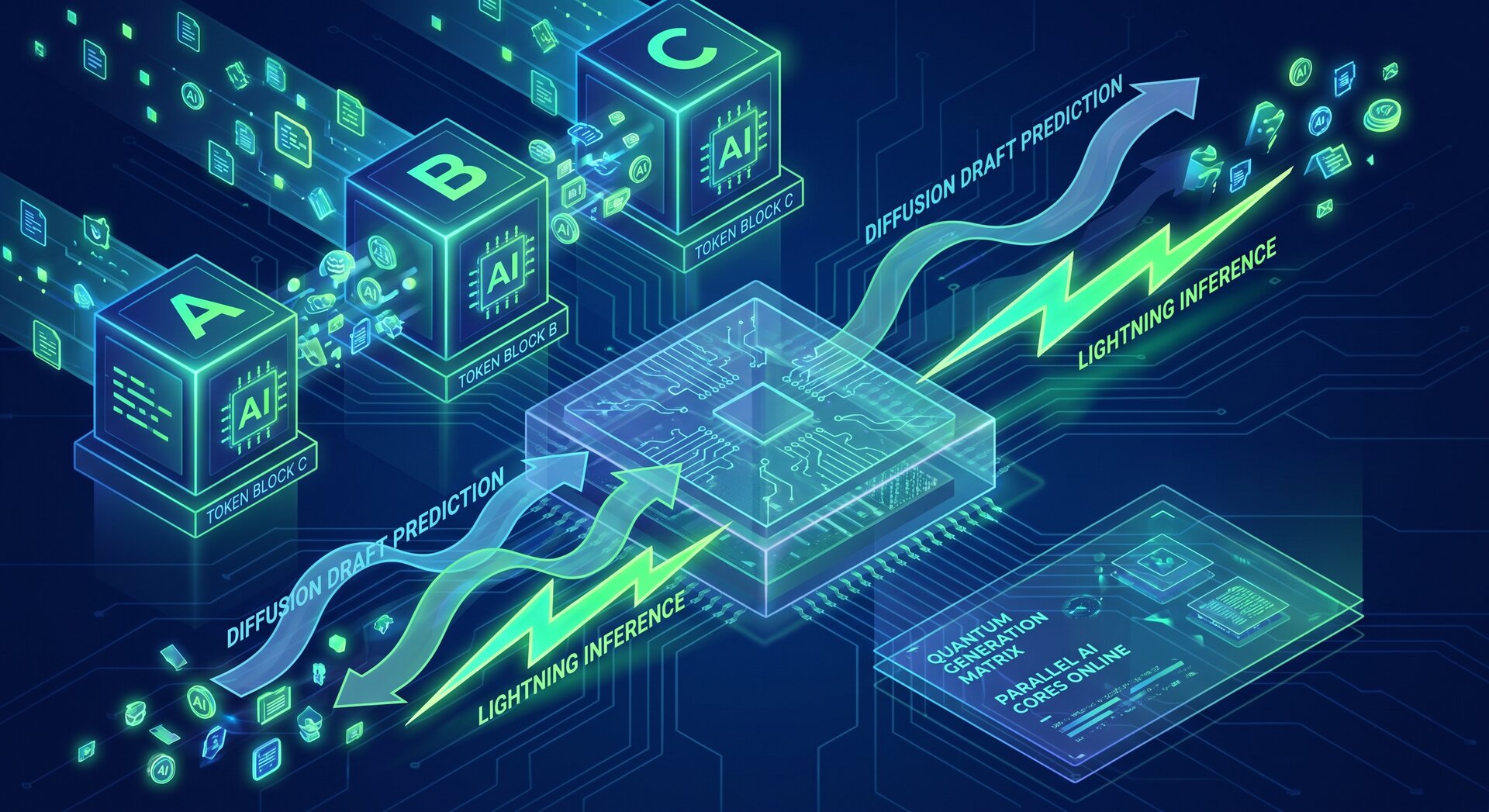

Enterprise: Nvidia Dynamo + vLLM/SGLang + LiteLLM

Für maximale Skalierbarkeit und Enterprise-Anforderungen. Nvidia Dynamo als Orchestrierungsebene, vLLM oder SGLang als Inference-Engine, LiteLLM als einheitliche API-Schicht. Dieser Stack ermöglicht das Hosting mehrerer Modelle mit automatischem Load-Balancing und Monitoring.

Ideal für: Große Unternehmen, Multi-Modell-Setups, hohe Verfügbarkeitsanforderungen, Tausende gleichzeitige Nutzer

Setup-Zeit: 1-2 Tage

Herausforderungen: Ehrlich über die Nachteile

Wir glauben an transparente Beratung. Deshalb hier die ehrlichen Herausforderungen beim KI selbst hosten:

Infrastruktur-Aufwand: Sie sind für Betrieb, Wartung und Updates verantwortlich. Das erfordert entweder internes Know-how oder einen zuverlässigen Partner. Container-Updates, Sicherheitspatches, Modell-Updates – all das muss gemanagt werden.

GPU-Kosten: Die Anschaffung leistungsfähiger GPUs ist eine Investition im fünfstelligen Euro-Bereich. Bei unsicherer Nutzung ist das ein Risiko. Allerdings gibt es auch Mietmodelle, die das Risiko minimieren.

Update-Zyklen: Neue Modellversionen erscheinen monatlich. Die Evaluierung und Integration erfordert kontinuierliche Aufmerksamkeit. Sie müssen entscheiden, wann ein neues Modell „gut genug“ ist für den Produktivbetrieb.

Technisches Know-how: Troubleshooting bei Problemen erfordert Verständnis für Linux, Container, GPU-Treiber und Netzwerke. Nicht jedes Unternehmen hat diese Expertise intern verfügbar.

Make-or-Buy: Selbst aufbauen vs. Managed Service

Die Entscheidung, ob Sie KI selbst hosten komplett selbst umsetzen oder einen Dienstleister beauftragen, hängt von mehreren Faktoren ab:

| Aspekt | Selbst hosten | Managed Service |

|---|---|---|

| Kontrolle | Maximal | Hoch (dedizierte Ressourcen) |

| Aufwand | Hoch | Niedrig |

| Kosten | Investition + Betrieb | Monatliche Gebühr |

| Time-to-Value | Wochen | Tage |

| Flexibilität | Maximal | Hoch |

Für die meisten Unternehmen ist ein Managed Service der pragmatischere Weg, um KI selbst hosten zu können – ohne dafür ein eigenes DevOps-Team aufbauen zu müssen. Sie behalten die Vorteile der Datenkontrolle und DSGVO-Konformität, übergeben aber den operativen Aufwand an Experten.

Biteno als Partner für selbst gehostete KI

Wir bei Biteno haben uns auf den Aufbau und Betrieb von KI-Infrastruktur spezialisiert. Unser Service umfasst die gesamte Wertschöpfungskette:

- Beratung: Wir analysieren Ihre Anforderungen und empfehlen die passende Infrastruktur

- Planung: Konzeption der Hardware- und Software-Architektur

- Aufbau: Installation und Konfiguration vor Ort oder in Ihrem Rechenzentrum

- Betrieb: 24/7-Monitoring, Updates, Troubleshooting, Performance-Optimierung

- Support: Schulung Ihrer Mitarbeiter, technische Unterstützung, Best Practices

Unsere Kunden profitieren von der Sicherheit selbst gehosteter KI – ohne den operativen Aufwand eines komplett eigenen Betriebs. Mehr über Open Source KI erfahren Sie in unserem ausführlichen Guide zu den verfügbaren Modellen.

Wann lohnt sich der Umstieg?

Der Umstieg auf selbst gehostete KI lohnt sich typischerweise, wenn Ihr Unternehmen bestimmte Schwellenwerte erreicht hat. Ein regelmäßiges monatliches Volumen von mehr als 5 Millionen Tokens ist ein guter Indikator. Ebenso, wenn Sie sensible Daten verarbeiten, bei denen auch das geringste Restrisiko einer Datenübertragung in Drittstaaten nicht akzeptabel ist.

Unternehmen mit spezifischen Compliance-Anforderungen – sei es durch ISO-Zertifizierungen, branchenspezifische Regulierungen oder interne Governance-Richtlinien – profitieren besonders von der vollständigen Kontrolle, die selbst gehostete KI bietet. Sie dokumentieren und audieren den gesamten Datenfluss nachweisbar selbst.

Auch die strategische Unabhängigkeit spielt eine zunehmende Rolle. In einer Zeit geopolitischer Spannungen und sich wandelnder Handelsbeziehungen bietet Unabhängigkeit von ausländischen Cloud-Anbietern eine gewisse strategische Resilienz. Sie sind nicht von den Geschäftsentscheidungen oder politischen Entwicklungen in anderen Ländern abhängig.

Fazit: Ist KI selbst hosten die richtige Wahl?

KI selbst hosten ist die richtige Entscheidung, wenn Datenschutz, Kontrolle und langfristige Kostenoptimierung für Sie Priorität haben. Die technischen Hürden sind heute mit Tools wie Ollama, vLLM und Open WebUI deutlich niedriger als noch vor zwei Jahren.

Die Investition in eigene Infrastruktur lohnt sich besonders dann, wenn:

- Sie regulierte Daten verarbeiten (DSGVO, Branchenstandards, interne Compliance)

- Ihr monatliches API-Volumen über 5 Millionen Token liegt

- Sie strategische Unabhängigkeit von US-Anbietern suchen

- Sie spezifische Anforderungen an Modell-Anpassungen haben (Fine-Tuning)

- Sie Offline-Fähigkeit benötigen

Möchten Sie herausfinden, ob KI selbst hosten für Ihr Unternehmen sinnvoll ist? Vereinbaren Sie ein unverbindliches Erstgespräch. Wir analysieren Ihre Situation und zeigen Ihnen die möglichen Wege auf – ob eigenständiger Betrieb oder Managed Service. Gemeinsam finden wir die optimale Lösung für Ihre Anforderungen.