Ob im Kundensupport, in der Code-Erstellung, im Marketing oder in der internen Wissensarbeit: Künstliche Intelligenz ist längst im Unternehmensalltag angekommen. Tools wie ChatGPT, Claude oder Microsoft Copilot können Prozesse beschleunigen, während KI-Agenten Aufgaben zunehmend eigenständig ausführen und Open-Source-Modelle neue Möglichkeiten für lokale, souveräne KI-Nutzung eröffnen. Gleichzeitig steigen die Anforderungen an Datenschutz, IT-Sicherheit, Governance und Recht.

Mit der zunehmenden Verbreitung von KI wachsen auch die Risiken: unkontrollierte Dateneingaben, Schatten-KI, fehlerhafte Ausgaben und unklare Verantwortlichkeiten. Unternehmen brauchen deshalb nicht nur ein Tool, sondern ein belastbares Regelwerk für Freigabe, Nutzung und Überwachung.

Chancen und Risiken

KI wird in vielen Unternehmen bereits genutzt, häufig auch ohne offizielle Freigabe. Das Problem liegt dabei weniger in der Technologie selbst als in der fehlenden Steuerung: Wer sensible Inhalte in ungeeignete Tools eingibt, riskiert Datenschutzverstöße, Vertraulichkeitsprobleme und Reputationsschäden.

Typische Risiken sind:

| Risiko-Kategorie | Beschreibung |

| Datenschutz | Personenbezogene Daten können an externe Dienste übermittelt werden; je nach Anbieter, Region und Konfiguration sind zusätzliche Schutzmaßnahmen nötig. |

| IP- und Geschäftsgeheimnisschutz | Vertrauliche Informationen können unbeabsichtigt in Workflows, Logs oder Drittanbieter-Integrationen landen. |

| Halluzinationen | KI kann plausibel klingende, aber falsche Inhalte erzeugen, was zu Fehlentscheidungen führen kann. |

| Schatten-KI | Mitarbeitende verwenden private Accounts oder nicht freigegebene Dienste für dienstliche Aufgaben. |

| KI-Agenten-Risiko | Systeme mit Tool-Zugriff können eigenständig Aktionen auslösen, Daten verändern oder Informationen weitergeben, wenn Berechtigungen und Kontrollen fehlen. |

| Open-Source-Risiko | Bei selbst betriebenen Modellen liegen Betrieb, Updates, Zugriffsschutz und Absicherung vollständig beim Unternehmen. |

Rechtlicher Rahmen

Vor dem produktiven Einsatz von KI sollten Unternehmen ihre rechtlichen Leitplanken definieren. Besonders wichtig sind Datenschutz, Vertraulichkeit, Urheberrecht, Persönlichkeitsrechte und seit 2025/2026 vor allem der EU AI Act.

Der EU AI Act ist die erste umfassende KI-Regulierung der EU und verfolgt einen risikobasierten Ansatz. Er unterscheidet unter anderem zwischen verbotenen Praktiken, Hochrisiko-Systemen, Transparenzpflichten und Regeln für General-Purpose-AI-Modelle; Teile der Verordnung sind bereits in Kraft, weitere Pflichten greifen ab August 2026 und für bestimmte Hochrisiko-Systeme ab August 2027.

Ein fundierter Einstieg in diese Thematik ist unerlässlich. Für eine tiefergehende Analyse im Hinblick auf Urheber- und Persönlichkeitsrechte im Umgang mit KI-Tools empfehlen wir den Fachbeitrag von Lexware, der wertvolle Einblicke in die rechtssichere Gestaltung der Arbeit mit KI bietet.

Die Sicherheits-Checkliste für IT-Entscheider

Um KI-Tools sicher zu implementieren, sollten Unternehmen die folgenden Punkte abarbeiten:

- Account-Management und Zugriffskontrolle

- Werden Enterprise- oder Business-Versionen genutzt, bei denen Daten standardmäßig nicht zum Training verwendet werden? Bei OpenAI gilt das für Business-, Enterprise- und API-Angebote standardmäßig, solange kein Opt-in vorliegt.

- Ist Single Sign-on aktiviert, damit Zugänge beim Austritt von Mitarbeitenden sofort entzogen werden können?

- Gibt es eine klare Regelung für private Accounts und nicht freigegebene KI-Tools?

- Werden auch KI-Agenten, Bots und andere nicht-menschliche Zugänge als eigene Identitäten verwaltet?

- Datenschutz (DSGVO-Compliance)

- Liegt für die Nutzung des Anbieters ein Auftragsverarbeitungsvertrag oder eine vergleichbare vertragliche Grundlage vor?

- Wurde geprüft, welche Daten wohin übertragen und wie lange sie gespeichert werden?

- Sind Mitarbeitende geschult, keine Klardaten, Gesundheitsdaten, Bankdaten oder vertrauliche Geschäftsinformationen unkontrolliert einzugeben?

- Ist klar geregelt, welche Daten in Open-Source- oder lokal gehostete Systeme dürfen und welche nicht?

- Technische Absicherung

- Sind Data-Loss-Prevention- und CASB-Maßnahmen vorhanden, um das Einfügen sensibler Daten in nicht freigegebene KI-Websites zu verhindern? Tools wie Zscaler oder Netskope können das Kopieren von sensiblen Daten in KI-Websites verhindern.

- Werden API-Keys sicher verwaltet, zum Beispiel in Vaults, mit Rotation und minimalen Berechtigungen?

- Ist Logging aktiviert, damit Nutzung, Risiken und Vorfälle nachvollziehbar bleiben?

- Gibt es für KI-Agenten ein Rollen- und Berechtigungskonzept, Freigabeschritte für riskante Aktionen und einen Kill Switch?

- Sind lokale oder Open-Source-Modelle so abgesichert, dass Updates, Patches und Drittkomponenten kontrolliert werden?

- Governance und Freigabe

- Gibt es ein zentrales KI-Register mit freigegebenen Tools, Use Cases und Verantwortlichkeiten?

- Werden neue KI-Anwendungen vorab hinsichtlich Datenschutz, IT-Sicherheit und Compliance bewertet?

- Ist dokumentiert, welche Systeme unter den EU AI Act fallen könnten, insbesondere bei Recruiting, Scoring, biometrischen Anwendungsfällen oder anderen Hochrisiko-Use-Cases?

- Gibt es für Open-Source-Modelle eine dokumentierte Entscheidung, warum sie eingesetzt werden und wer den Betrieb verantwortet?

Praxis-Tipp: Transparenz statt Verbote

Pauschale Verbote führen oft nur dazu, dass Mitarbeitende auf Schatten-KI ausweichen. Besser ist ein klarer, freigegebener Rahmen mit sicheren Alternativen, definierten Use Cases und verständlichen Regeln.

Ein KI-Register ist dafür ein sehr guter Ansatz: Darin sollten zugelassene Tools, erlaubte Einsatzszenarien, Datentypen, Ansprechpartner und Freigabestatus dokumentiert sein. Gerade bei KI-Agenten und Open-Source-KI hilft das Register, Verantwortlichkeiten sauber zuzuordnen.

KI-Agenten als neues Thema

Bild: magnific.com/Evgenymedia

KI-Agenten unterscheiden sich von klassischen Chatbots dadurch, dass sie Aufgaben nicht nur beantworten, sondern selbstständig ausführen können. Das macht sie besonders wertvoll für Automatisierung, erhöht aber auch die Anforderungen an Berechtigungen, Monitoring und Freigaben.

Für Unternehmen gilt daher: Jeder KI-Agent braucht einen klar definierten Zweck, begrenzte Rechte, protokollierte Aktionen und eine menschliche Kontrollinstanz für sensible Schritte. Wer Agenten produktiv einsetzt, sollte sie wie andere kritische Systeme behandeln und in IAM, Logging und Incident-Response einbinden.

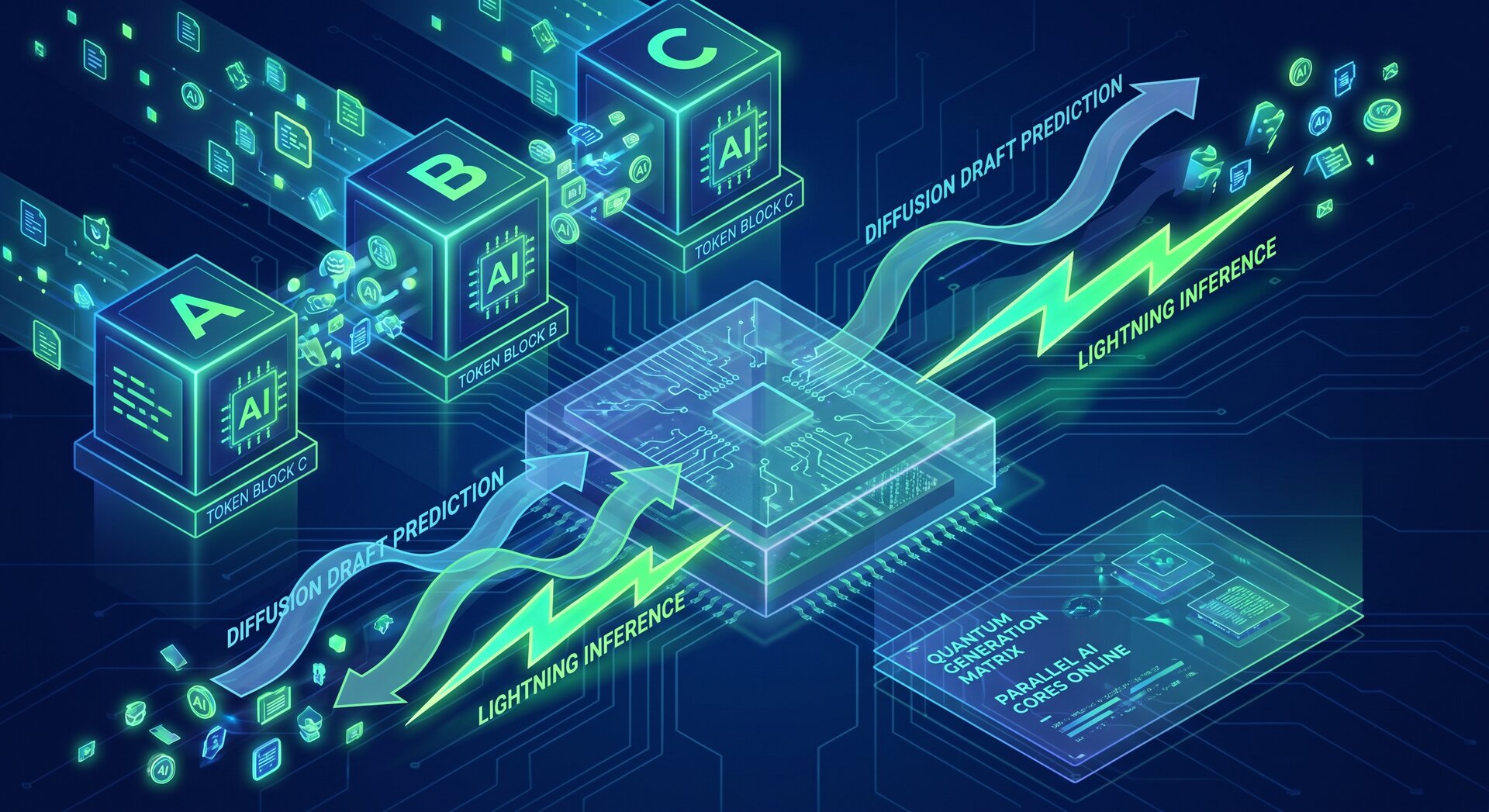

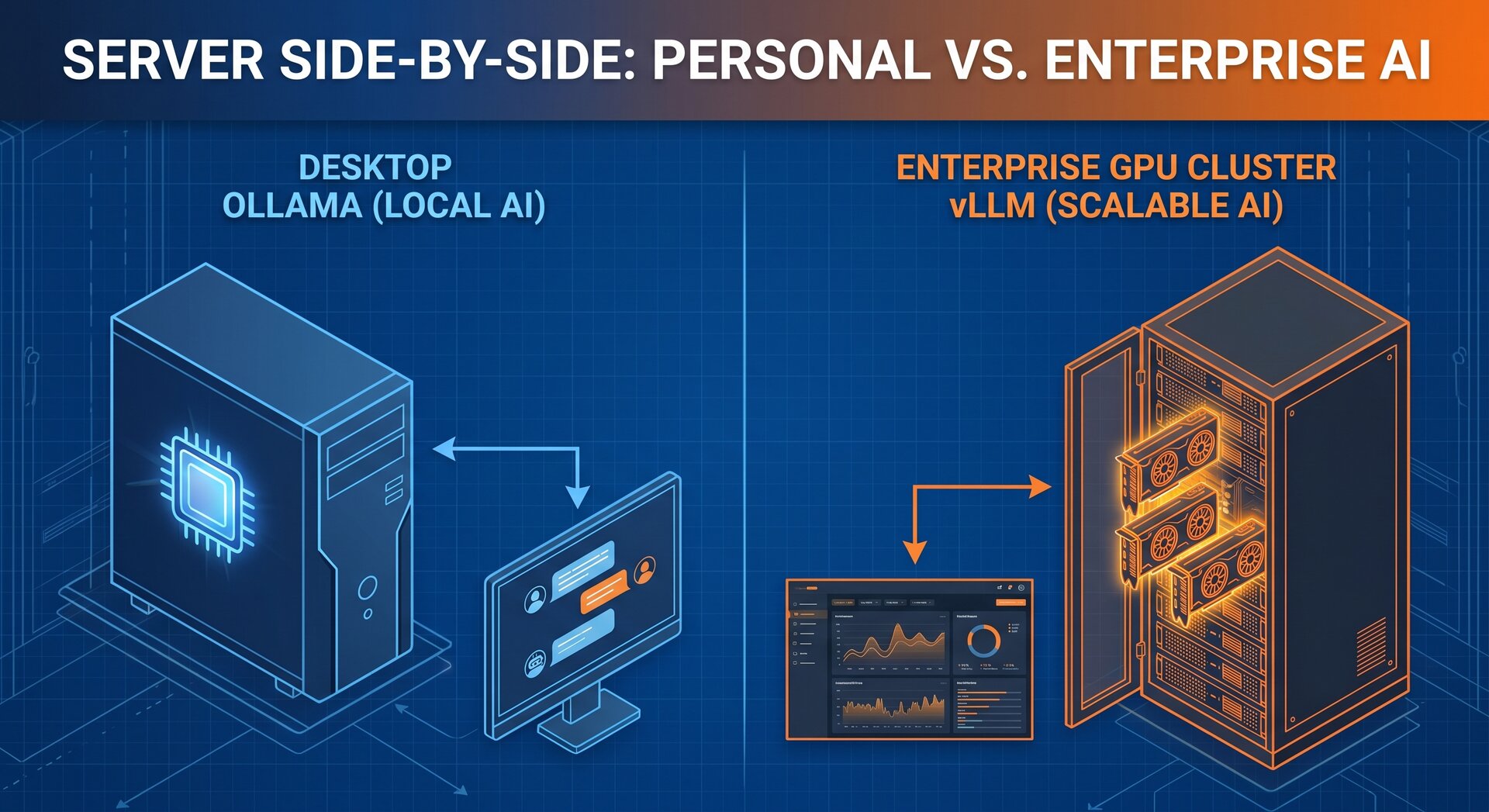

Open-Source-KI als Alternative

Open-Source-Modelle und lokal betriebene KI-Lösungen bieten Unternehmen mehr Kontrolle über Daten, Infrastruktur und Anpassungen. Das ist besonders für Organisationen mit hohen Datenschutz-, Souveränitäts- oder Integrationsanforderungen attraktiv.

Der Vorteil hat aber einen Preis: Unternehmen übernehmen selbst Verantwortung für Modellwahl, Hosting, Updates, Zugriffsschutz, Logging und die Prüfung von Lizenzen und Abhängigkeiten. Open Source ist deshalb nicht automatisch sicherer, sondern vor allem anders zu betreiben.

Urheberrecht und Inhalte

Bild: magnific.com/mohammadhridoy12

Für KI-generierte Inhalte gilt in Deutschland weiterhin: Urheberrechtsschutz setzt grundsätzlich eine persönliche geistige Schöpfung voraus. Rein KI-generierte Ergebnisse ohne ausreichende menschliche Gestaltung genießen daher in der Regel keinen Urheberrechtsschutz; das wurde auch 2026 von Gerichten in Deutschland erneut bestätigt.

Wichtig ist aber die Feinheit: Sobald Menschen die kreative Hauptleistung tragen und KI nur als Werkzeug einsetzen, kann im Einzelfall Schutz möglich sein. Die Grenze liegt nicht bei der Länge des Prompts, sondern bei der tatsächlichen menschlichen Kreativleistung.

Meeting-Protokolle

KI kann für Meeting-Zusammenfassungen genutzt werden, aber nur mit sauberer Rechtsgrundlage, klaren internen Regeln und einem geeigneten Tool-Setup. Bei personenbezogenen Daten genügt nicht automatisch eine einfache Zusage; entscheidend sind die konkrete Nutzung, die Informationspflichten und die datenschutzrechtliche Grundlage.

Wenn das System nicht zum Training verwendet und vertraglich abgesichert ist, reduziert das das Risiko erheblich. Dennoch sollten sensible Inhalte nur dann verarbeitet werden, wenn dies wirklich nötig ist und die zuständigen Personen informiert sind.

Mit Strategie statt Panik

ChatGPT und Co. sind kein Sicherheitsrisiko per se, sondern ein Governance- und Konfigurationsproblem. Unternehmen, die auf freigegebene Enterprise- oder Business-Lösungen, Schulungen, technische Schutzmaßnahmen und eine saubere AI-Governance setzen, können die Produktivitätsvorteile nutzen, ohne die Kontrolle über Daten und Risiken zu verlieren.