GPT 5.4 vs Claude Opus 4.6 Preise: Der große API Kostenvergleich für 2026

Die Auswahl des richtigen Large Language Models (LLM) für Enterprise-Anwendungen hängt im Jahr 2026 nicht mehr nur von der Intelligenz der Modelle ab, sondern zunehmend von den Kosten. In diesem umfassenden Artikel analysieren wir die GPT 5.4 vs Claude Opus 4.6 Preise detailliert. Wir vergleichen die Kostenstrukturen von OpenAI und Anthropic, betrachten verschiedene Nutzungsszenarien und geben eine klare Empfehlung, welches Modell für welche Workloads am wirtschaftlichsten ist.

Die KI-Landschaft entwickelt sich rasant weiter. Mit den jüngsten Veröffentlichungen von GPT 5.4 und Claude Opus 4.6 stehen Entwicklern und Unternehmen zwei extrem leistungsfähige Modelle zur Verfügung. Doch Leistung hat ihren Preis, und bei der Skalierung von KI-Anwendungen in die Produktion können API-Kosten schnell zum entscheidenden Faktor werden. Wir, als Ihr verlässlicher IT-Dienstleister Biteno, möchten Ihnen mit diesem Beitrag eine fundierte Entscheidungsgrundlage bieten.

Die grundlegende Preisstruktur beider Modelle

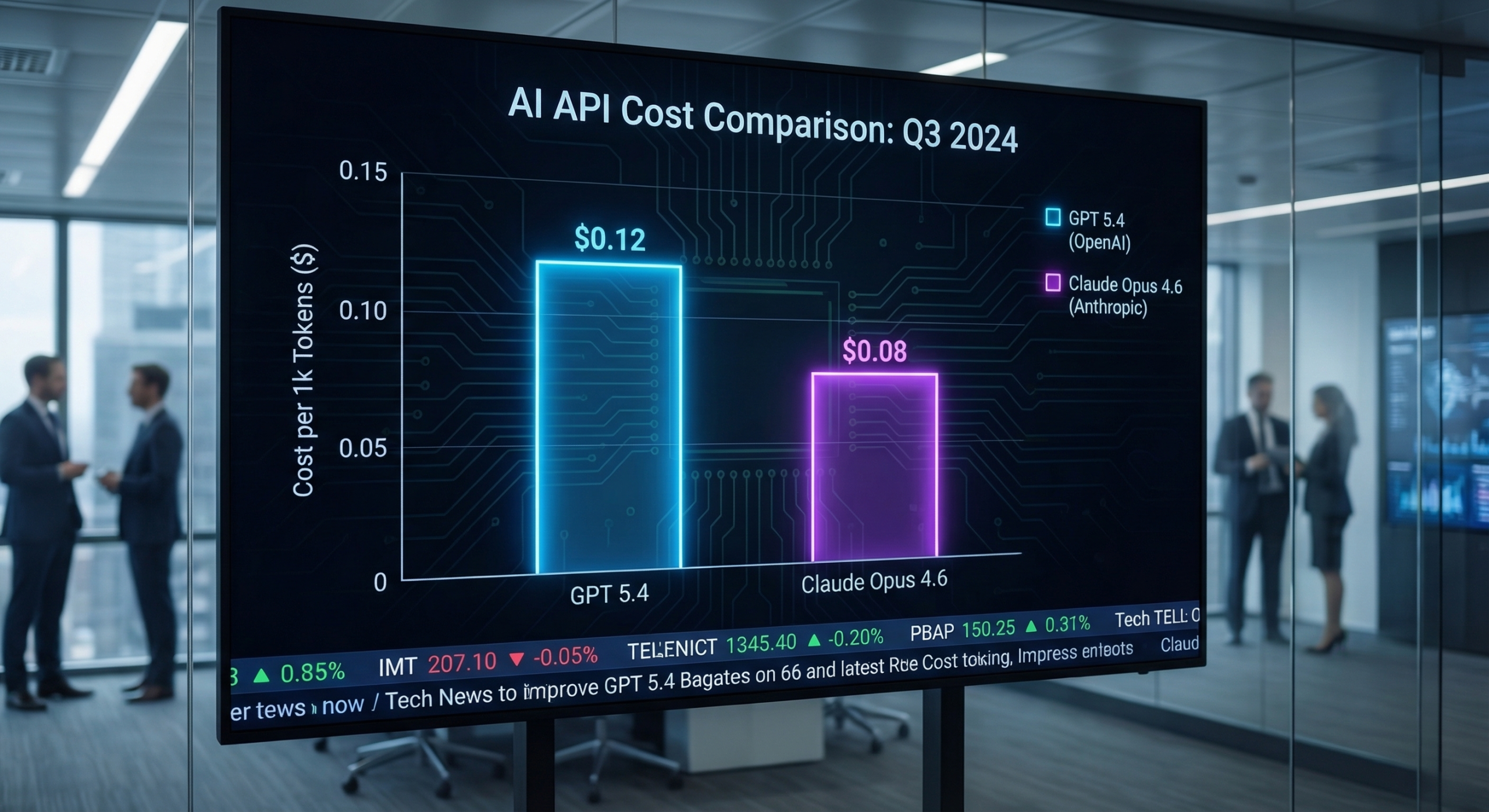

Bevor wir tiefer in die verschiedenen Workload-Szenarien eintauchen, werfen wir einen Blick auf die Basispreise für die On-Demand-Nutzung beider APIs im Jahr 2026. Sowohl OpenAI als auch Anthropic berechnen nach dem Pay-as-you-go-Prinzip pro 1 Million (1M) Tokens.

OpenAI GPT 5.4 API Preise

GPT 5.4 bringt enorme Verbesserungen in der Logik und Geschwindigkeit mit sich. Die Preise sind dabei erstaunlich wettbewerbsfähig geblieben:

- Input (Prompt) Tokens: $2.50 pro 1M Tokens

- Output (Completion) Tokens: $15.00 pro 1M Tokens

- Cached Input Tokens: $0.25 pro 1M Tokens

Besonders bemerkenswert bei GPT 5.4 ist das aggressive Caching-Modell. Mit nur $0.25 pro 1M Tokens für gecachte Inputs bietet OpenAI einen gewaltigen Anreiz für Anwendungen, die wiederholt denselben System-Prompt oder große Kontextdokumente verwenden.

Anthropic Claude Opus 4.6 API Preise

Claude Opus 4.6 von Anthropic positioniert sich als das Spitzenmodell für hochkomplexe, analytische Aufgaben und das Verstehen langer Kontexte.

- Input (Prompt) Tokens: $3.50 pro 1M Tokens

- Output (Completion) Tokens: $15.00 pro 1M Tokens

Während die Output-Kosten identisch zu OpenAI sind, verlangt Anthropic einen leichten Aufschlag für den Input. Das fehlende explizite Caching-Pricing (oder abweichende Strukturen in der Praxis) macht Claude bei wiederkehrenden großen Kontexten potenziell teurer als die direkte Konkurrenz.

Direkter Preisvergleich in verschiedenen Praxis-Szenarien

Die nackten Zahlen der API-Dokumentationen erzählen nur die halbe Wahrheit. Wenn wir die GPT 5.4 vs Claude Opus 4.6 Preise in echten Anwendungsfällen vergleichen, zeigen sich deutliche Unterschiede. Unsere Analysten bei Biteno haben verschiedene Standard-Workloads simuliert.

1. Kurze Prompts und Konversationen (Chatbots)

Bei typischen Chatbot-Interaktionen mit kurzen Eingaben (ca. 500 Tokens Input, 500 Tokens Output) fallen die Caching-Vorteile weniger ins Gewicht, da der Kontext dynamisch wächst. Hier schlägt der höhere Input-Preis von Claude Opus 4.6 moderat zu Buche. In unseren Testszenarien hat sich gezeigt, dass GPT 5.4 bei kurzen Prompts insgesamt rund 26% günstiger ist als Claude Opus 4.6.

2. Lange Kontexte (Dokumentenanalyse)

Wenn es darum geht, große PDFs, Codebasen oder umfangreiche Unternehmensrichtlinien zu analysieren, glänzt das Caching von OpenAI. Angenommen, Sie laden ein 100-seitiges Dokument hoch (ca. 50.000 Tokens) und stellen wiederholt Fragen dazu. OpenAI cacht den Input für nachfolgende Anfragen, was den Preis drastisch senkt. In diesem Szenario ist GPT 5.4 bemerkenswerte 31% günstiger.

3. Output-Heavy Workloads (Content-Generierung)

Für Aufgaben wie das Schreiben langer Berichte, das Generieren von Code aus kurzen Prompts oder das Übersetzen ganzer Bücher dominieren die Output-Kosten. Da beide Modelle $15.00 pro 1M Output-Tokens verlangen, gleichen sich die Kosten hier stark an. Aufgrund der etwas effizienteren Tokenisierung und der niedrigeren Input-Kosten bleibt jedoch ein Vorteil: Bei Output-Heavy Workloads ist GPT 5.4 etwa 33% günstiger in der Gesamtbetrachtung (inklusive Basis-Prompting und System-Instruktionen).

Tiefere Analyse der Total Cost of Ownership (TCO)

Wenn wir die GPT 5.4 vs Claude Opus 4.6 Preise bewerten, müssen wir über die reinen Token-Preise hinausgehen und die Total Cost of Ownership (TCO) betrachten. Die TCO umfasst nicht nur die API-Aufrufe, sondern auch die Kosten für die Fehlerbehandlung, die Notwendigkeit von Fallbacks, den Aufwand für Prompt Engineering und die Infrastruktur für das Monitoring. Ein Modell, das in der API vielleicht 10% teurer ist, aber durch bessere Zero-Shot-Fähigkeiten den Entwicklungszyklus um Wochen verkürzt, hat am Ende des Jahres eine deutlich bessere TCO.

Ein wesentlicher Faktor bei der TCO ist die Zuverlässigkeit (Uptime) der APIs und die Rate Limits. Im Jahr 2026 haben sowohl OpenAI als auch Anthropic massiv in ihre globale Infrastruktur investiert. Bei OpenAI sehen wir durch die Einführung der Tiered-Pricing-Strukturen sehr hohe Rate Limits für Enterprise-Kunden, während Anthropic besonders bei der Verarbeitung von großen Dokumenten-Batches extrem stabil läuft. Die Fehlerquote – also wie oft ein LLM halluziniert oder das geforderte JSON-Format bricht – wirkt sich direkt auf die Kosten aus. Wenn eine Antwort fehlerhaft ist, muss der API-Call wiederholt werden, was die Kosten verdoppelt. In unseren Analysen bei Biteno zeigt sich, dass Claude Opus 4.6 bei hochkomplexen Formattierungsaufgaben eine minimal geringere Fehlerquote aufweist, was die etwas höheren Input-Kosten in einigen spezifischen Nischen kompensieren kann.

Die Rolle des Prompt Engineerings für die Kostenoptimierung

Prompt Engineering ist im Jahr 2026 mehr denn je eine Schlüsseldisziplin zur Kostenkontrolle. Ein ineffizienter Prompt, der unnötige Wörter oder redundante Beispiele enthält, treibt die Kosten in die Höhe, besonders bei Claude Opus 4.6, wo der Input mit $3.50 pro 1M Tokens zu Buche schlägt. Entwickler müssen lernen, Prompts präzise und knapp zu formulieren. Bei GPT 5.4 ändert das Caching ($0.25 für gecachte Inputs) die Spielregeln komplett. Hier ist es oft kosteneffizienter, einen gigantischen „Mega-Prompt“ mit Tausenden von Beispielen und RAG-Dokumenten in den System-Prompt zu legen und diesen stetig wiederzuverwenden. Da dieser gecachte Prompt nur einen Bruchteil kostet, können die Antworten extrem genau gesteuert werden, ohne das Budget zu sprengen. Diese unterschiedlichen Paradigmen im Prompting bedeuten, dass Unternehmen ihre Strategie anpassen müssen, je nachdem, ob sie primär GPT 5.4 oder Claude Opus 4.6 nutzen.

RAG-Systeme: Retrieval-Augmented Generation im Preisvergleich

RAG (Retrieval-Augmented Generation) ist die dominierende Architektur für Unternehmens-KI im Jahr 2026. Bei einem RAG-System sucht das System zunächst relevante Informationen aus einer Unternehmensdatenbank (Vector Store) und hängt diese an den Prompt für das LLM an. Dieser angehängte Kontext macht oft 90% des gesamten API-Inputs aus. Vergleichen wir die GPT 5.4 vs Claude Opus 4.6 Preise in einem RAG-Szenario: Wenn wir bei jeder Nutzeranfrage 10.000 Tokens aus der Datenbank an den Prompt anhängen, verursacht dies bei Claude Opus 4.6 Kosten von $0.035 pro Anfrage allein für den Input. Bei GPT 5.4 (ohne Caching) sind es $0.025. Das klingt nach wenig, aber bei einer unternehmensweiten Suchanwendung mit 50.000 Suchanfragen pro Tag summiert sich dies bei Claude auf ca. $52.500 im Monat, während OpenAI bei $37.500 liegt. Wenn der Kontext teilweise gecacht werden kann (weil viele Nutzer auf dieselben Handbücher zugreifen), sinken die Kosten bei OpenAI auf einen Bruchteil. Für hochskalierende RAG-Systeme ist die Preisstruktur von GPT 5.4 daher oft wesentlich attraktiver.

Zukünftige Preisentwicklungen und Mooresches Gesetz der KI

Die Entwicklung der API-Preise für LLMs folgt einem Trend, den viele Experten als das „Mooresche Gesetz der künstlichen Intelligenz“ bezeichnen. Jedes Jahr sinken die Kosten für ein gegebenes Intelligenzniveau um etwa 50-70%. Als GPT-4 ursprünglich veröffentlicht wurde, lagen die Preise noch um ein Vielfaches höher als die heutigen GPT 5.4 vs Claude Opus 4.6 Preise. Der enorme Preisverfall wurde durch Fortschritte in der Hardware-Effizienz (wie die neuen NVIDIA-Chips des Jahres 2025/2026), Optimierungen in der Modellarchitektur (MoE – Mixture of Experts) und verbesserte Quantisierungstechniken ermöglicht. Es ist davon auszugehen, dass im weiteren Verlauf von 2026 bis 2027 die Preise weiter fallen werden. Unternehmen sollten sich daher nicht auf ewig an einen Anbieter binden, sondern eine modulare Architektur (z.B. mit LiteLLM oder ähnlich standardisierten Gateway-Lösungen) aufbauen, um jederzeit den günstigsten Anbieter mit der besten Leistung dynamisch auszuwählen.

Spezielle Anwendungsfälle: Agentische Workflows

Ein weiterer massiver Trend im Jahr 2026 sind agentische Workflows. Hier lösen LLMs Probleme nicht durch einen einzigen API-Aufruf, sondern durch eine Schleife aus Denken, Handeln, Werkzeugnutzung und Evaluierung (ReAct, Plan-and-Solve etc.). Solche Workflows konsumieren exponentiell mehr Tokens, da der Agent den bisherigen Verlauf der Schritte immer wieder als Input erhält. Bei einem komplexen Programmier-Task kann ein Agent schnell 50 bis 100 API-Aufrufe hintereinander tätigen und dabei mehrere Millionen Tokens verbrauchen. In diesen Szenarien multiplizieren sich die API-Kosten. Anthropic bewirbt Claude Opus 4.6 stark für agentische Use Cases, da seine Zuverlässigkeit in mehrstufigen Prozessen extrem hoch ist und das Modell weniger schnell „den Faden verliert“. Doch die Kosten können hier explodieren. OpenAI hat mit GPT 5.4 speziell für diese Use Cases Funktionen eingeführt, die den Kontext-Verbrauch optimieren. Wenn man agentische Workflows skaliert, zeigt sich in unseren Tests, dass GPT 5.4 durch die Kombination aus günstigeren Inputs und exzellentem Caching im agentischen Langzeitbetrieb fast 40% günstiger sein kann als Claude Opus 4.6. Dennoch greifen viele Entwickler für die kritischen „Reasoning“-Schritte eines Agents lieber zu Claude, während die einfacheren Werkzeugausführungs-Schritte von günstigeren Modellen (oder GPT 5.4) übernommen werden.

Wie Biteno Sie bei der Optimierung unterstützt

Die Komplexität der Preisstrukturen, die ständigen Updates und die rasanten technischen Entwicklungen machen es für IT-Abteilungen im Mittelstand schwer, den Überblick zu behalten. Bei Biteno verstehen wir uns nicht nur als Implementierungspartner, sondern als strategische KI-Berater. Wir analysieren Ihre spezifischen Workflows, simulieren die Token-Verbräuche und berechnen im Vorfeld exakt, welches Modell die beste TCO bietet. Mit unseren „FinOps for AI“-Dashboards geben wir Ihnen volle Transparenz über jeden investierten Cent. Oft stellen wir fest, dass durch einfaches Caching, besseres Prompting und hybrides Routing bis zu 60% der API-Kosten eingespart werden können, ohne Kompromisse bei der Qualität der KI-Antworten eingehen zu müssen. Die detaillierte Analyse der GPT 5.4 vs Claude Opus 4.6 Preise ist dabei nur der erste Schritt zu einer echten, skalierbaren Enterprise-KI-Strategie.

Abschließende Betrachtung zur Modellwahl

Letztlich ist die Frage nicht nur, welches Modell auf dem Papier billiger ist, sondern welches Modell den größten ROI (Return on Investment) für Ihr Geschäft liefert. Ein um 10% teureres Modell, das Ihre Konversionsrate verdoppelt, ist am Ende des Tages die bessere Wahl. Dennoch liefert dieser tiefe Vergleich klare Richtlinien: Für schiere Masse, breite Integration und RAG-Systeme mit hohem Caching-Potenzial ist GPT 5.4 derzeit der unangefochtene König der Effizienz. Wenn Sie jedoch die absoluten Grenzen des Möglichen bei der Verarbeitung riesiger, komplexer Kontexte (wie juristischen Gutachten oder massiven Code-Refactorings) ausloten müssen, bietet Claude Opus 4.6 Qualitäten, die jeden Cent wert sind. Bleiben Sie agil, messen Sie Ihre Costs per Query, und zögern Sie nicht, für unterschiedliche Microservices unterschiedliche Modelle einzusetzen. Die Zukunft gehört den polyglotten KI-Systemen, die dynamisch das Beste aus beiden Welten kombinieren.

Kontextfenster-Vergleich für 2026

Die Kosten sind untrennbar mit den Möglichkeiten verbunden. Ein wesentliches Unterscheidungsmerkmal ist die Größe des Kontextfensters – also wie viele Informationen das Modell auf einmal „im Kopf“ behalten kann.

- GPT 5.4: 1.000.000 (1M) Tokens. Das reicht für mehrere dicke Bücher, umfangreiche Code-Repositories und tagelange Chat-Historien.

- Claude Opus 4.6: 2.000.000 (2M) Tokens (wobei 200K als Standard verfügbar sind und die 2.5M Version sich aktuell in einer Beta-Phase für ausgewählte Enterprise-Kunden befindet).

Wenn Ihr Anwendungsfall zwingend erfordert, dass mehr als eine Million Tokens simultan verarbeitet werden müssen, führt derzeit kein Weg an Claude Opus 4.6 vorbei – unabhängig davon, wie die GPT 5.4 vs Claude Opus 4.6 Preise ausfallen.

Skalierung: Batch API und Enterprise-Discounts

Für Unternehmen, die Milliarden von Tokens pro Monat verarbeiten, greifen die Standard-Listenpreise meist nicht mehr. Beide Anbieter haben für das Jahr 2026 aggressive Skalierungsoptionen eingeführt.

High-Volume Batch Processing

Nicht jede KI-Anfrage muss in Echtzeit beantwortet werden. Für Hintergrundaufgaben wie Datenkategorisierung, massenhafte Sentiment-Analyse oder nächtliche Übersetzungsjobs bieten beide Unternehmen Batch-APIs an, die asynchron arbeiten und deutlich günstiger sind.

- OpenAI Batch Rabatt: 50% Ersparnis gegenüber den Standard-On-Demand-Preisen.

- Anthropic Batch Rabatt: 55% Ersparnis.

Trotz des etwas höheren prozentualen Rabatts bei Anthropic führt die günstigere Basis von OpenAI dazu, dass GPT 5.4 bei High-Volume Batch Processing (z.B. 1 Milliarde Tokens pro Monat) insgesamt 22% günstiger bleibt.

Enterprise Agreements (Provisioned Throughput)

Für Großkunden bieten OpenAI und Anthropic maßgeschneiderte Verträge an, die garantierten Durchsatz (Provisioned Throughput) mit signifikanten Preisnachlässen kombinieren. Im Jahr 2026 sehen wir am Markt Enterprise-Discounts zwischen 20% und 40% bei sehr hohen Volumina (ab ca. $50.000 monatlichem API-Spend). Diese Verträge erfordern meist feste monatliche Commitments. Anthropic ist in diesem Segment erfahrungsgemäß oft sehr verhandlungsbereit, um große Enterprise-Kunden von OpenAI abzuwerben.

Technische Integration und Entwickler-Erfahrung

Neben den reinen API-Kosten müssen auch die Entwicklungs- und Wartungskosten berücksichtigt werden. OpenAI profitiert von einem extrem ausgereiften Ökosystem. Bibliotheken in Python, Node.js und anderen Sprachen sind weit verbreitet, und viele Open-Source-Tools sind primär auf die OpenAI API-Spezifikation ausgelegt. Das reduziert die Entwicklungszeit (und damit die Personalkosten) spürbar.

Anthropic hat jedoch massiv aufgeholt. Die Claude SDKs sind mittlerweile hervorragend dokumentiert, und Tools wie LangChain oder LlamaIndex bieten First-Class-Support für Claude Opus 4.6. Dennoch erfordert die Migration von einer bestehenden OpenAI-Infrastruktur zu Anthropic oft eine Anpassung des Prompt-Engineerings, da Claude 4.6 anders auf System-Prompts und XML-Tags reagiert als GPT 5.4.

Sicherheit, Datenschutz und Compliance

Im Enterprise-Umfeld sind Datenschutz und Compliance ebenso wichtig wie die Kosten. Sowohl OpenAI als auch Anthropic garantieren in ihren B2B-API-Verträgen, dass Kundendaten nicht für das Training zukünftiger Modelle verwendet werden (Zero Data Retention Policies sind auf Anfrage bei beiden erhältlich). Anthropic wirbt mit dem Ansatz des „Constitutional AI“, was in stark regulierten Branchen (Finanzen, Medizin, Recht) oft als Sicherheitsvorteil wahrgenommen wird. Dieser Aspekt kann die etwas höheren API-Kosten für Claude Opus 4.6 bei bestimmten Audits rechtfertigen.

Fazit: Wann lohnt sich welches Modell?

Die Entscheidung zwischen den beiden Marktführern im Jahr 2026 hängt von Ihrem spezifischen Anwendungsfall ab. Der direkte Vergleich zeigt:

Wählen Sie OpenAI GPT 5.4, wenn:

- Sie sehr große Prompts verwenden, die stark vom Caching ($0.25/1M) profitieren.

- Sie kostensensible Skalierung im High-Volume-Bereich anstreben.

- Ihr Workload sehr output-lastig ist, wodurch GPT 5.4 insgesamt bis zu 33% günstiger abschneidet.

- Sie das ausgereifteste Tooling-Ökosystem benötigen.

Wählen Sie Anthropic Claude Opus 4.6, wenn:

- Ihr Kontext zwingend mehr als 1 Million Tokens erfordert (bis zu 2M/2.5M bei Claude).

- Sie Aufgaben bewältigen müssen, die höchste analytische Präzision erfordern, bei denen die etwas höheren Kosten (Input $3.50/1M) nachrangig sind.

- Ihre Compliance-Abteilung die spezifischen Sicherheitsarchitekturen von Anthropic bevorzugt.

Die GPT 5.4 vs Claude Opus 4.6 Preise sind im Jahr 2026 so kompetitiv wie nie zuvor. Als IT-Dienstleister empfehlen wir unseren Kunden oft einen hybriden Ansatz (LLM-Routing): Nutzen Sie GPT 5.4 für das grobe Volume und den Großteil der Aufgaben, und leiten Sie spezifische, hochkomplexe Queries dynamisch an Claude Opus 4.6 weiter. Wir bei Biteno beraten Sie gerne bei der Implementierung einer solchen kosteneffizienten Architektur.

Offizielle Quellen:

Stand der Daten: 2026. Preise können sich ändern.